Qwen3.6-27B 在小型模型中实现旗舰级编程能力

Simon Willison··作者 Simon Willison

关键信息

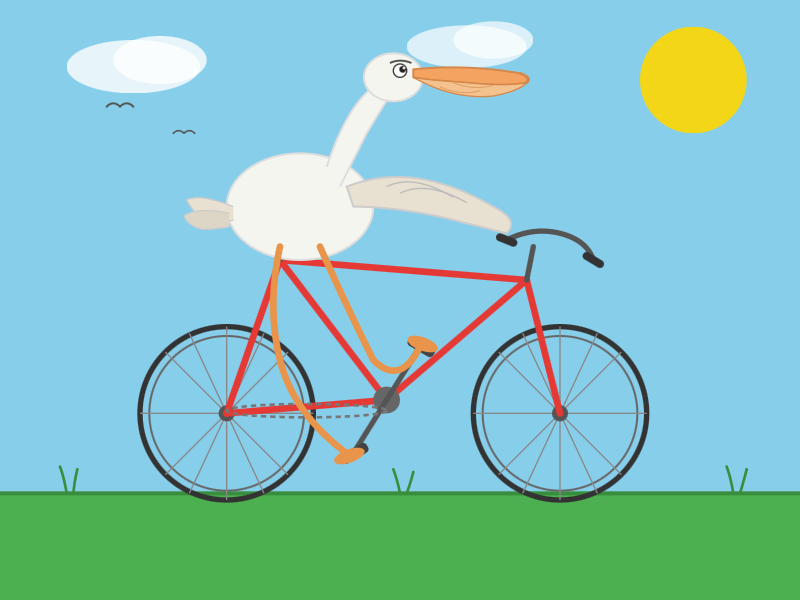

该模型在本地使用 llama.cpp 和 Q4_K_M 量化方式运行时,每秒可生成约 25–26 个 token,并能从文本提示生成高质量 SVG 图像,展示了强大的推理和创意生成能力。

资讯摘要

Qwen3.6-27B 是由 Qwen 开发的一个开源权重语言模型,声称在仅 270 亿参数下实现了旗舰级代理式编程性能——相比前代 3970 亿总参数的 MoE 模型(仅激活 170 亿)大幅减少。该模型提供 55.6GB 版本,并进一步压缩为适合本地推理的 16.8GB GGUF 量化版本。一位用户通过 llama-server 在配备 16GB 显存的设备上测试,成功生成了复杂 SVG 图像,如一只骑自行车的鹈鹕和一只乘坐电动滑板车的北美负鼠,图像细节丰富。

性能数据显示生成速度约为每秒 25 个 token,对如此紧凑的模型而言表现优异。这标志着高效大模型设计的重大进步。

资讯正文

Qwen3.6-27B:在270亿参数密集模型中实现旗舰级编程能力

Qwen对其最新开源权重模型提出了重磅声明:

Qwen3.6-27B实现了旗舰级别的代理编程性能,在所有主要编程基准测试中均超越了上一代开源旗舰模型Qwen3.5-397B-A17B(总参数3970亿,活跃MoE参数170亿)。

在Hugging Face上,Qwen3.5-397B-A17B模型大小为807GB,而这款新的Qwen3.6-27B模型仅为55.6GB。

我使用了16.8GB的Unsloth量化版本Qwen3.6-27B-GGUF(Q4_K_M),并按照Hacker News用户benob提供的配置方法,先通过brew install llama.cpp安装llama-server后运行如下命令:

llama-server \

-hf unsloth/Qwen3.6-27B-GGUF:Q4_K_M \

--no-mmproj \

--fit on \

-np 1 \

-c 65536 \

--cache-ram 4096 -ctxcp 2 \

--jinja \

--temp 0.6 \

--top-p 0.95 \

--top-k 20 \

--min-p 0.0 \

--presence-penalty 0.0 \

--repeat-penalty 1.0 \

--reasoning on \

--chat-template-kwargs '{"preserve_thinking": true}'

首次运行时,该模型约17GB被保存至~/.cache/huggingface/hub/models--unsloth--Qwen3.6-27B-GGUF目录。

以下是生成“一只鹈鹕骑自行车”的SVG代码的完整对话记录。对于一个仅需16.8GB本地内存的模型而言,这一结果堪称卓越:

图片描述:自行车有辐条、链条和正确形状的车架。把手略显松脱。鹈鹕的翅膀搭在把手上,腿部异常弯曲且触碰到踏板,喙部形态良好。背景细节令人愉悦——半透明云朵、鸟类、草地和太阳。

llama-server报告的性能数据如下:

- 读取速度:20 tokens,耗时0.4秒,速率为54.32 tokens/s

- 生成速度:4,444 tokens,耗时2分53秒,速率为25.57 tokens/s

为了进一步验证,这里还展示了生成“一辆电动滑板车上的一只北弗吉尼亚负鼠”的SVG代码(此前曾用GLM-5.1模型完成过类似任务):

图片描述:一只灰色猫形生物戴着青色护目镜,骑着一辆发光的青色未来感摩托车穿越黑夜中的城市景观,长尾巴拖在身后,背景是黄色窗户亮灯的剪影建筑,右侧有一轮粉红色的月亮。

这次生成耗时6,575 tokens,共4分25秒,速率为24.74 tokens/s。

Qwen3.6-27B:在270亿参数密集模型中实现旗舰级编程能力

来源与参考

收录于 2026-04-23