谷歌发布两款面向智能体时代的新型TPU

Ars Technica AI··作者 Ryan Whitwam

关键信息

TPU8t每Pod提供高达121 FP4 EFlops的算力,可线性扩展至百万芯片;TPU8i将片上SRAM提升至384MB以优化上下文处理。两款芯片均采用谷歌自研的Axion ARM CPU主机,相比前代效率更高。

资讯摘要

谷歌发布了两款新TPU——TPU8t用于训练,TPU8i用于推理,以支持‘智能体时代’的到来,即AI系统能自主运行。TPU8t将大型模型的训练时间从数月缩短至数周,配备包含9600个芯片和2PB共享内存的大规模集群,且通过自动故障处理和实时遥测实现97%的高效算力利用率。

TPU8i则针对多智能体并发运行优化,片上SRAM增至384MB,单个集群可达1152个芯片。两款芯片均基于谷歌自研的Axion ARM CPU,形成软硬一体架构,相较Ironwood芯片性能功耗比提升一倍。

资讯正文

谷歌推出了两款专为“代理时代”设计的新TPU。

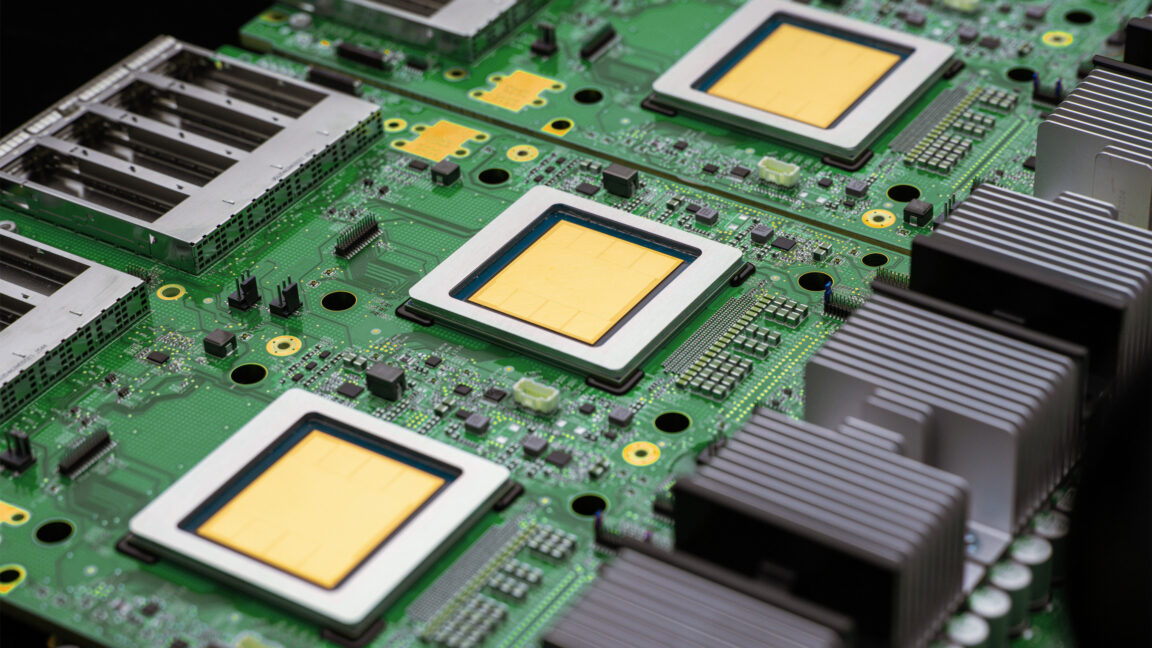

大多数已全力投入构建AI模型的公司都在大量采购英伟达的AI加速器,但谷歌采取了不同的路径。其云AI基础设施主要基于自家定制的张量处理单元(TPU)。在2025年宣布第七代Ironwood TPU后,谷歌已进入第八代版本,但这不仅仅是同一芯片的更快迭代。

新款TPU有两种类型,谷歌表示这为其客户和自身提供了一个更快、更高效的AI平台。谷歌强调,“代理时代”从根本上不同于以往的AI系统,因此需要全新的硬件方法。为此,工程师们设计了TPU8t(用于训练)和TPU8i(用于推理)。

在AI模型能被用来分析数据或生成搞笑表情包之前,必须先完成训练。TPU8t专门为此阶段设计,将前沿AI模型的训练时间从数月缩短至数周。

更新后的Tensor 8t服务器集群(谷歌称之为“Pod”)现在包含9600个芯片,共享两PB的高带宽内存。谷歌声称TPU8t甚至可以线性扩展,单个逻辑集群最多可达一百万个芯片。正是这些创新让超大规模AI模型的训练速度大幅提升,但也推高了其他人的内存价格。不过,如果你正在构建那些巨型AI模型,这种硬件节省了大量时间——每个Pod可提供121 FP4 EFlops的计算能力,几乎达到Ironwood训练算力上限的三倍。

因此,新芯片加快了训练速度,谷歌还称每输入一伏特电量,TPU8t都能获得更多的有用计算效率。该公司宣称其“良好计算率”(goodpute rate)高达97%,意味着等待和浪费的时间更少。通过更好地处理不规则内存访问、自动处理硬件故障以及实时监控所有连接芯片的遥测数据,TPU8t能更多时间专注于推进模型训练。

训练完成后,AI模型会以推理模式运行来生成token——这就是当你要求模型执行某项任务时背后发生的过程。这一过程对算力需求较低,因此用同样的硬件同时完成训练和推理效率不高。这也是为什么推理由TPU8i负责,它专为运行多个专业代理而优化,减少等待时间。TPU8i芯片的Pod规模也更大,达到1152个芯片,而上一代Ironwood推理集群仅为256个芯片。这相当于每个Pod提供11.6 EFlops的性能,远低于TPU8t Pod。

谷歌将每个TPU8i的片上SRAM容量提升至384MB,使其能在芯片上缓存更大的键值缓存,从而加快具有长上下文窗口模型的运行速度。第八代AI加速器也是谷歌首款完全依赖自研Axion ARM CPU主机的产品,每个TPU配有一个CPU(每两个TPU共用一个CPU),而Ironwood时代则是每个x86 CPU服务四个TPU芯片。谷歌表示,这种“全栈式”ARM架构方案带来了更高的效率。

效率的考量

谷歌新推出的TPU架构将效率作为核心要素,这并不令人意外。训练和运行前沿AI模型成本高昂,投资回报尚不明确。企业仍在为生成式AI烧钱,希望效率能最终带来转机。谷歌的新TPUs或许能推动这一目标实现,也可能不会,但该公司确实取得了显著改进。

生成式AI系统耗电量巨大,这也是人们不愿使用它们的主要原因之一。第八代TPU并非低功耗设计,但谷歌声称其每瓦性能是Ironwood芯片的两倍。此外,谷歌还提到数据中心也实现了改进,这些数据中心据称与TPUs‘共同设计’。例如,将网络功能集成到单个芯片上、优化计算单元布局等措施,使单位电力提供的算力提升了六倍。当然,这意味着数据中心并不会消耗更少的电力,而是用同样的电力获得了更强的计算能力。

冷却数据中心所需的用水量也是效率关注的重点。由于AI服务器密集运算产生的热量无法通过空气散热,液冷成为唯一选择。谷歌已将其第四代液冷系统适配到新款芯片上,利用主动控制阀门根据负载调整水流,从而提升效率。

TPU 8t和TPU 8i未来将用于驱动谷歌基于Gemini的智能体,但也专为第三方开发者设计。两款新TPU支持开发者常用的框架,包括JAX、MaxText、PyTorch、SGLang和vLLM。

在谷歌宣布消息后,英伟达股价一度下跌约1.5%,但随后恢复并再次超过每股200美元。过去一年里,AI加速器需求激增使英伟达市值翻了一番以上,而谷歌的增长甚至更为显著。这正是潜在AI泡沫的特征——受益公司并不认为这是泡沫,他们视其为智能体AI时代的开端。

来源与参考

收录于 2026-04-23