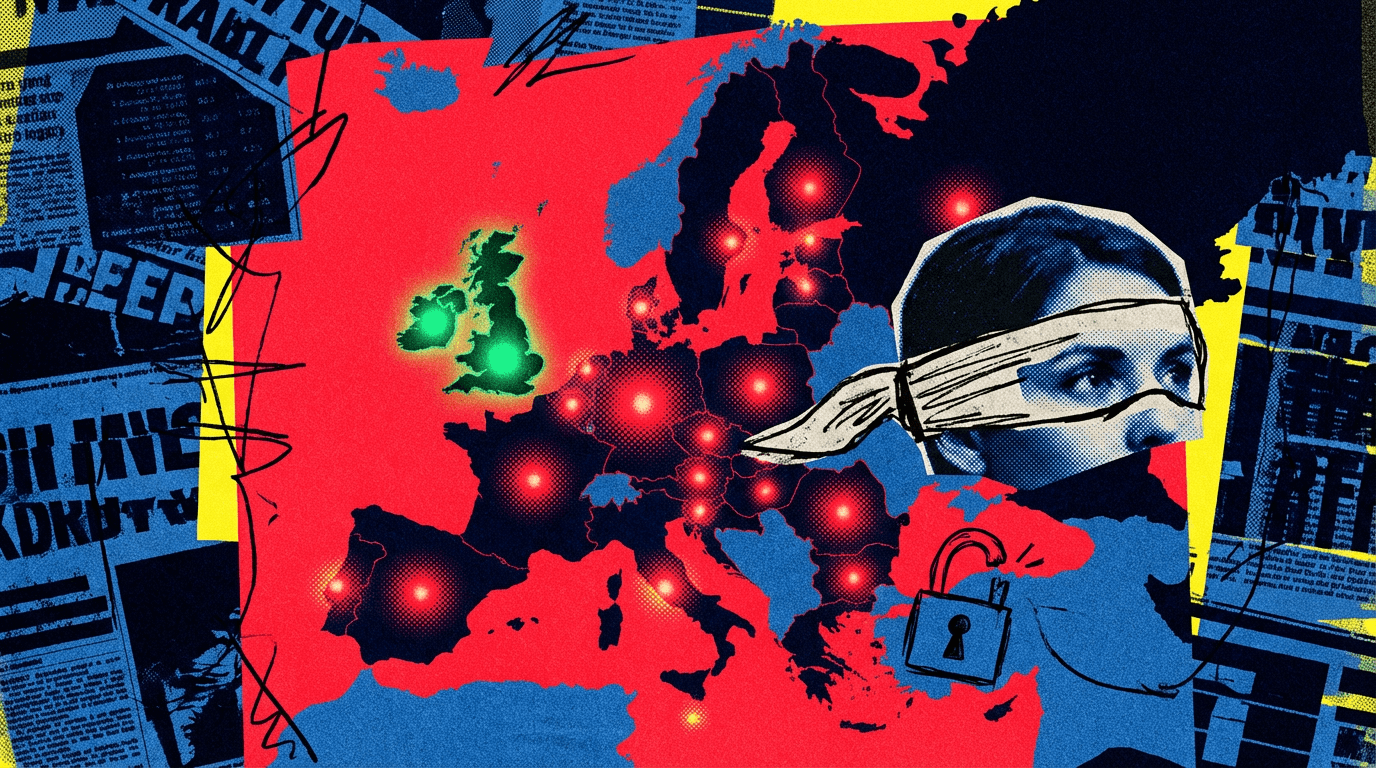

Claude Mythos暴露欧盟AI安全漏洞

The Decoder··作者 Maximilian Schreiner

关键信息

Anthropic的“玻璃翼计划”包括苹果、微软和亚马逊等12家美国科技巨头,但欧洲机构如ENISA和欧盟AI办公室尚未获得直接访问权限或关于该模型能力的明确信息。只有德国BSI启动了对话,但无法直接测试。

资讯摘要

Anthropic最近宣布仅向少数合作伙伴提供其新AI模型Claude Mythos Preview的访问权限,声称该模型能比大多数人类更有效地发现安全漏洞。该公司在“玻璃翼计划”下向包括苹果、微软和亚马逊在内的12家公司开放,但欧洲机构基本被排除在外——多数国家的网络安全机构接触极少,且无人能直接测试该模型。

相比之下,英国人工智能安全研究所已对该模型进行测试并发布报告,指出其相比以往模型有显著提升。专家警告,缺乏访问权限使欧洲难以准确评估风险,引发对主权、网络安全以及私营公司在管理前沿AI安全中角色的担忧。

资讯正文

Claude Mythos 是对欧洲人工智能安全机制的一次警醒

Anthropic 正在限制对 Claude Mythos 的访问,该公司表示,这款 AI 模型发现安全漏洞的能力优于大多数人类。欧洲当局几乎无法了解该系统的情况,而英国已经开展了自身的测试。这一局面暴露了更深层次的结构性问题。

Anthropic 上周宣布,将仅向少数技术合作伙伴开放其最新 AI 模型 Claude Mythos Preview 的访问权限。公司认为,新模型可能带来前所未有的网络安全隐患,并增加大规模人工智能驱动网络攻击的可能性。

在名为“Project Glasswing”的计划下,Anthropic 精心挑选了 12 家美国科技公司作为核心圈层,包括苹果、微软和亚马逊。另有 40 家组织也获得了访问权限,但 Anthropic 未公布这些机构的名称。

欧洲监管机构几乎完全被排除在外。

大多数欧洲网络安全机构与 Anthropic 接触甚少。

据《政客》(POLITICO)报道,记者联系了八个国家的欧洲网络安全机构官员。只有德国联邦信息安全局(BSI)确认已与 Anthropic 就 Mythos 展开对话,但尚未能直接测试该模型。其他欧洲政府机构显然仅能获得有限的信息。

BSI 主席克劳迪娅·普利特纳(Claudia Plattner)告诉《政客》,这类强大工具最终是否会进入公开市场是一个紧迫问题,这关乎国家安全和主权,影响深远。虽然 BSI 正在积极与 Anthropic 对话,但目前的交流仅提供了关于模型工作原理的有意义信息,而非直接测试权限。

欧盟网络安全机构 ENISA 拒绝就是否与 Anthropic 联系发表评论。欧盟委员会的人工智能办公室则表示,正在通过欧盟人工智能模型行为准则与 Anthropic 保持沟通。至于 Mythos 是否包含在相关讨论中,以及该办公室是否已获得访问权限,均未得到答复。

相比之下,英国处于完全不同境地。英国人工智能部长卡尼什卡·纳拉扬(Kanishka Narayan)证实,英国人工智能安全研究所(AISI)最近已对 Mythos 进行测试,并根据结果采取了行动。周一,该研究所发布了评估报告。结果显示,Mythos Preview 相较于此前前沿模型实现了显著进步,而当前网络安全能力本身已在快速演进。不过,AISI 也指出,无法确定 Mythos 是否能够成功攻击防御严密的系统。

没有访问权限,欧洲就无法评估风险。

欧洲无法接触 Mythos 不仅仅是个治理问题。缺乏扎实的技术细节,监管机构只能有限地评估风险并优先部署防护措施。

柏林人工智能非营利组织 KIRA 创始人丹尼尔·普里维特拉(Daniel Privitera)告诉《政客》,Mythos 提前展示了未来几年获取前沿人工智能能力的重要性。他表示,欧洲目前没有任何计划来确保这种访问权。

AI先驱约书亚·本吉奥(Yoshua Bengio)告诉《政客》(POLITICO),他非常担心科技公司而非监管机构正在决定如何应对这些风险。他表示,这凸显了创建政府或第三方审查技术路径的重要性。

曾担任欧洲议会议员的玛丽特杰·沙克(Marietje Schaake)曾在欧盟委员会担任顾问,协助制定欧盟AI开发者行为准则,她也表示,由私人公司控制具有广泛影响的模型令人担忧。她说,现在是时候就披露规则和监督机制达成一致了。

参与起草欧盟《人工智能法案》的独立AI研究员劳拉·卡罗利(Laura Caroli)告诉《政客》,欧盟目前被边缘化,是因为该模型尚未在市场上发布。如果它被投放市场,Anthropic公司将必须遵守欧盟法律的强制性义务。不过根据欧盟指南,即使只是内部使用AI模型,只要这种使用对在欧盟提供产品或服务至关重要,或者影响欧盟公民的权利,也被视为将该模型投入市场。

欧盟委员会数字事务发言人托马斯·雷格尼尔(Thomas Regnier)告诉《政客》,委员会目前正在评估该模型可能涉及的欧盟立法后果。根据《人工智能法案》,像Anthropic这样的提供商必须应对模型带来的网络风险;而《网络安全韧性法案》则为所有销往欧盟市场的含数字组件的产品设定了强制性网络安全要求。

为什么欧洲被排除在外——以及这意味着什么

欧洲无法接触Mythos是否反映了过度监管?现实要复杂得多。Anthropic与亚马逊、谷歌、IBM、微软和OpenAI一起签署了欧盟通用型AI模型行为准则。合作意愿不足并不是问题。

真正的问题在于欧洲缺乏能与之技术对等的对应机构。英国AI安全研究所(AI Security Institute)成立于2023年,最初名为前沿AI任务组,于2025年更名,拥有1亿英镑公共资金。在极短的时间内,它通过运行安全测试并聘请来自OpenAI和谷歌DeepMind的知名研究人员,获得了进入AI行业的通道。截至目前,该机构已测试至少16个模型,包括三个在公开发布前就进行了测试的前沿模型。凭借超过100名技术人员和良好的关系网络,它具备了获得最先进模型早期访问权限的可信度。

欧盟层面确实设有AI办公室,拥有125多名员工及自己的安全单元。但据Transformer News报道,就在去年秋天,该办公室仍面临严重的招聘困难,关键领导职位空缺。欧盟人事专家安德拉什·巴内思(Andras Baneth)指出,僵化的薪酬结构使得吸引私营部门人才的空间很小。由于内部官僚程序繁琐,招聘流程往往持续数月,导致候选人在此期间选择其他工作机会。相比之下,英国同类机构可以支付高于标准的薪资。

一些欧盟成员国已经自行建立了相关结构。法国于2025年初推出了INESIA(人工智能评估与安全研究所),西班牙则通过AESIA监控AI的安全部署。

因此,对 Mythos 的处理似乎更多反映了结构性的弱点,而非过度监管:欧洲在计算能力、增长资本、本土前沿实验室以及以安全为导向的评估方面仍落后于其他国家。所有这些因素都限制了开展此类工作所需的顶尖人才、计算资源和影响力。自 GPT-3 以来,欧洲已经经历过多次类似的警醒时刻。值得肯定的是,欧洲已不再处于全面否认的状态。但当下一个如此级别的模型并非来自 Anthropic,而是来自 DeepSeek 这样的公司时,这种觉醒是否足够,则完全是另一个问题了。

AI 新闻去 hype 化——由人类精选

订阅 THE DECODER,享受无广告阅读、每周 AI 简报、每年六次独家‘AI 雷达’前沿报告、完整档案访问权限及评论区权限。

来源与参考

收录于 2026-04-15