Anthropic 为 Claude 托管代理加入“梦境”功能

Ars Technica AI··作者 Samuel Axon

关键信息

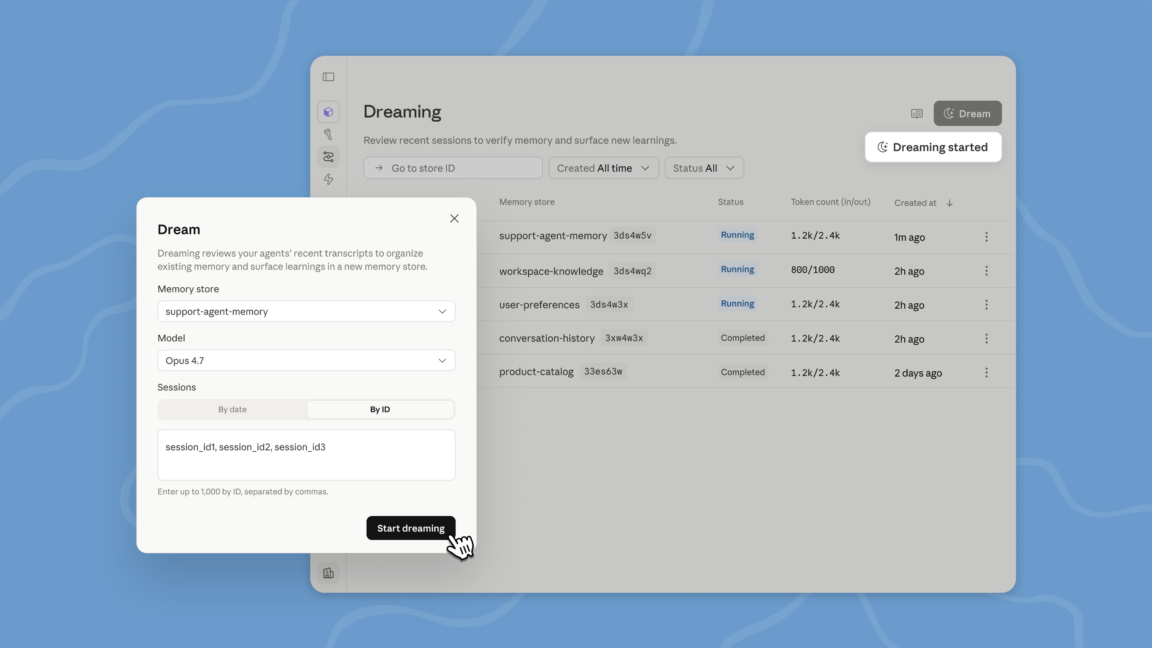

dreaming 目前仅适用于 Claude Platform 上的托管代理,并处于研究预览阶段。Anthropic 表示,它建立在现有记忆能力之上,旨在发现重复错误、逐渐收敛的工作流和团队共享偏好,同时重构记忆以保持高信号。

资讯摘要

Anthropic 在旧金山举行的 Code with Claude 大会上,为 Claude Managed Agents 发布了一项名为“dreaming”的新功能。公司将 dreaming 描述为一种定时运行的过程,它会回顾会话和记忆存储,找出值得保留的具体记忆。随后,这些记忆会被用于影响未来的任务和交互。该功能目前处于研究预览阶段,并且仅限 Claude Platform 上的 Managed Agents 使用。Managed Agents 是 Anthropic 提供的一种更高层级、预先构建的代理框架,面向那些希望使用托管基础设施、而不是直接基于 Messages API 自行搭建代理的开发者。

Anthropic 表示,这类代理适合多个代理协同处理任务,或者在几分钟到几小时内完成的长流程项目。公司称,dreaming 建立在现有记忆能力之上,目的是让代理从过去的互动中学习。这样做的重要原因在于,LLM 的上下文窗口是有限的,随着任务变长,重要信息可能会被挤出上下文。Anthropic 还把这一机制类比为聊天场景中的 compaction,也就是系统定期分析长对话,移除无关内容,同时保留对当前对话或任务真正重要的信息。

资讯正文

旧金山——在其 Code with Claude 开发者大会上,Anthropic 为 Claude Managed Agents 引入了它所称的“dreaming”。在这里,这一过程指的是回顾最近发生的事件,并识别出值得存储到“记忆”中的具体内容,以便为未来的任务和交互提供参考。

Dreaming 目前处于研究预览阶段,仅限于 Claude Platform 上的 Managed Agents 使用。Managed Agents 是一种更高层级的选择,用于替代直接基于 Messages API 构建;Anthropic 将其描述为“一个预先构建、可配置的 agent harness,运行在托管基础设施中”。它面向这样的场景:你希望多个 agent 在几分钟或几小时内协作处理某个任务或项目,直到达到某个结果。

Anthropic 将 dreaming 描述为一个定时执行的过程,在此过程中会审查会话和记忆存储,并整理出特定的记忆。这一点很重要,因为 LLM 的上下文窗口是有限的,而在较长的项目中,重要信息可能会丢失。就聊天场景而言,许多模型会使用一种名为 compaction 的过程,也就是定期分析冗长的对话,并尝试从上下文窗口中移除无关信息,同时保留对正在进行的对话、项目或任务真正重要的内容。

来源与参考

收录于 2026-05-07