Anthropic 与 Google Cloud、xAI 的算力大交易,标志着前沿 AI 进入基础设施军备竞赛

Anthropic 被报道承诺向 Google Cloud 支出 2000 亿美元,同时又接入 xAI 的 Colossus 1 算力;这些交易显示,AI 公司的竞争核心已经从模型发布转向算力获取与成本结构。(1553、1555、1561)

AI 日报

今天的主线很清晰:前沿 AI 不再只是模型之争,而是算力、网络、电力、芯片和政府监管的全面竞赛。与此同时,企业软件、广告、代理和本地端侧 AI 的商业化也在加速推进,显示行业正从“能不能做出来”转向“谁来买单、谁来负责、谁能规模化”。

Overview

从 71 条资讯中筛选出 37 条

今天的主线很清晰:前沿 AI 不再只是模型之争,而是算力、网络、电力、芯片和政府监管的全面竞赛。与此同时,企业软件、广告、代理和本地端侧 AI 的商业化也在加速推进,显示行业正从“能不能做出来”转向“谁来买单、谁来负责、谁能规模化”。

Anthropic 被报道承诺向 Google Cloud 支出 2000 亿美元,同时又接入 xAI 的 Colossus 1 算力;这些交易显示,AI 公司的竞争核心已经从模型发布转向算力获取与成本结构。(1553、1555、1561)

特朗普政府据称开始支持前沿模型安全测试,甚至可能推进部署前政府审查;与此同时,OpenAI 内部治理争议在法庭上继续发酵。(1554、1575、1562、1566、1582)

OpenAI、SAP、微软和 Match Group 的消息都指向同一趋势:AI 现在不只是工具,而是会改变招聘、工作流、平台边界和部门架构的成本项与增长项。(1559、1572、1579、1583、1587)

Gemma 4 的推测解码和 Chrome 的 4GB 本地模型文件形成鲜明对比:本地 AI 的体验更强,但存储、隐私与可见成本也更突出。(1565、1571、1588)

Google、Meta、Anthropic 和 Andon Labs 的故事共同表明,代理正在成为下一阶段产品竞争焦点,但它们在长期任务、现实运营和用户影响方面仍有明显短板。(1564、1568、1574)

三星市值突破万亿美元、台积电锁定海上风电、SpaceX 传出考虑巨型晶圆厂,说明 AI 的外溢效应已深入半导体制造和电力系统。(1556、1558、1578)

前沿 AI 正在进入“基础设施 + 治理 + 变现”三线并进阶段。头部实验室和云厂商围绕算力与网络展开超级交易,政府开始重新考虑模型发布前审查,而产品层面则出现更多面向企业、代理和广告的商业化尝试。

Anthropic、xAI、OpenAI、Google 和 SpaceX 相关故事共同指向一个事实:前沿模型的瓶颈不只是训练方法,而是算力、互联和供电。(1553、1555、1560、1561、1556、1578)OpenAI 发布 MRC 网络协议,试图减少大规模 GPU 集群中的通信瓶颈(1560);台积电则通过 30 年期海上风电协议锁定长期电力(1578)。

从米拉·穆拉蒂对奥尔特曼安全审查的宣誓证词(1562),到 Brockman 在庭审中回顾 OpenAI 早期治理冲突(1566、1582),再到白宫讨论前审查和安全测试(1554、1575),今天的报道都在强调:AI 公司内部治理与公共监管正在同步成为焦点。

SAP 押注结构化企业数据(1559)、OpenAI 强调 Codex 驱动的企业工作流(1579)、微软重组 Teams/Office/Copilot 体系(1587)、Google 和 Meta 追赶个人代理(1574),都说明 AI 竞争已从模型能力延伸到产品分发、工作流集成和组织架构。

Gemma 4 借助推测解码提升本地生成速度(1565、1571),但 Chrome 也因自动下载 4GB Gemini Nano 模型而引发关注(1588)。这提醒用户:更强的本地 AI 体验,往往伴随着更高的存储和系统资源成本。

今天的新闻共同说明:AI 产业的竞争重心正在从“谁有最强模型”转向“谁能掌控算力、网络、芯片、电力、监管和分发”。真正的赢家,可能不是单一模型最强的公司,而是能够把基础设施、产品和政策三者同时做成闭环的参与者。

Stories

The Decoder

据《The Information》报道,Anthropic 已承诺在未来五年内向 Google Cloud 支出约 2000 亿美元,以换取 5 吉瓦的服务器容量。该交易将于明年开始,而 Google 和 Anthropic 上个月宣布合作时并未披露具体金额。

这笔据报的承诺凸显了前沿 AI 对算力的需求已经大到什么程度,也显示未来云收入越来越依赖少数几家头部 AI 实验室。它还表明 Google Cloud 不只是承载 Anthropic 的工作负载,还可能通过自家的 TPU 芯片运行这些负载,从而提升利润率。

《The Information》报道称,Anthropic 已承诺在五年内向 Google Cloud 支出约 2000 亿美元。作为交换,Google 将提供 5 吉瓦的服务器容量,这项协议预计从明年开始执行。Google 和 Anthropic 之前公布合作时,并没有披露具体金额。报道指出,这一单安排就占到 Google 最近披露的收入积压订单的 40% 以上。Google 的合同化未来云收入积压在第一季度翻倍,超过 4600 亿美元,而云业务同期增长了 63%。

《The Information》认为,这一增长很大程度上来自 Anthropic 的 API 在 Google Cloud 上运行。文章还称,Anthropic 和 OpenAI 合计约占 Amazon、Microsoft、Google 和 Oracle 四家厂商 2 万亿美元云积压的一半。报道同时提醒,这些巨额承诺建立在激进的收入增长预期之上,但两家公司目前都仍在亏损。文章最后指出,云厂商如果还能顺带销售模型本身,将更能受益,而 Google 还有额外优势,因为 Anthropic 运行在 Google 自家的 TPU 芯片上,而不只是依赖 Nvidia 硬件。

《The Information》称,这一单交易就占到 Google 最近披露的收入积压订单的 40% 以上,而该积压在第一季度翻倍至超过 4600 亿美元。报道还指出,Anthropic 和 OpenAI 合计约占 Amazon、Microsoft、Google 和 Oracle 四家云厂商 2 万亿美元未来云收入承诺的一半。

Ars Technica AI

特朗普政府已与 Google DeepMind、Microsoft 和 xAI 签署自愿协议,对前沿 AI 模型在发布前后进行政府安全检查。白宫国家经济委员会主任 Kevin Hassett 还表示,特朗普可能很快发布一项行政命令,要求在部署前对先进 AI 系统进行政府测试。

这意味着特朗普对监管的早先立场出现了明显转向,也可能重塑美国对前沿模型的评估方式。如果进一步变成正式强制要求,它将影响主要 AI 实验室、模型发布时间表,以及围绕 AI 安全和国家安全风险的政府监管争论。

本周,特朗普政府态度突然转向,与 Google DeepMind、Microsoft 和 xAI 签署协议,允许政府在前沿 AI 模型发布前后进行安全检查。报道指出,这与特朗普此前的立场形成鲜明对比,因为他曾将拜登时期的自愿安全检查斥为阻碍创新的过度监管,并把美国 AI 安全研究机构更名为“Center for AI Standards and Innovation”,刻意去掉了“安全”一词。报道认为,这一变化与 Anthropic 决定暂不发布 Claude Mythos 有关,因为该模型强大的网络安全能力可能被恶意行为者滥用。白宫国家经济委员会主任 Kevin Hassett 透露,特朗普可能很快签署一项行政命令,要求在先进 AI 系统发布前进行政府测试。

CAISI 在新闻稿中表示,这些自愿协议是在“延续”拜登政府政策的基础上推进的,扩大与行业的合作将有助于其在公共利益关键时刻扩大工作规模。CAISI 主任 Chris Fall 表示,独立、严谨的测量科学对于理解前沿 AI 及其国家安全影响至关重要。CAISI 还称,迄今已完成约 40 次评估,其中包括尚未发布的模型,并且在测试中经常接触安全防护被削弱或移除的系统,以便更全面地评估国家安全相关能力和风险。批评者则担心,政府可能缺乏足够资金或专业知识来有效评估前沿模型,而且如果没有公开透明的标准,所谓“安全”可能会变得模糊,甚至受到政治化影响。

CAISI 表示,截至目前已完成约 40 次评估,其中包括尚未发布的前沿模型,而且它通常会接触到安全防护被削弱或移除的模型,以便更全面地评估安全风险。批评者认为该机构可能缺乏足够资金或专业能力,并警告如果没有明确测试标准,“安全”可能会变得没有定义,甚至被政治化。

TechCrunch AI

xAI 和 Anthropic 宣布达成一项意外合作,Anthropic 将使用 xAI 的 Colossus 1 数据中心全部算力容量,约 300MW。此举让 Anthropic 能立即提高使用上限,也让 xAI 的一项重要基础设施迅速变现。

这笔交易表明,xAI 可能不再只是训练 Grok 这类模型,而是在开始扮演其他前沿 AI 公司算力供应商的角色。这很重要,因为 AI 基础设施正迅速成为独立的大生意,影响收入、估值以及谁能掌控稀缺的 GPU 资源。

xAI 和 Anthropic 出人意料地宣布,Anthropic 将购买 xAI 的 Colossus 1 数据中心全部算力容量。文章称这一容量约为 300MW,并表示这笔合作让 Anthropic 可以立即提高自己的使用上限。TechCrunch 认为,这对 xAI 来说是一笔非常大的交易,价值很可能高达数十亿美元,也意味着 xAI 的一项重要资产被迅速转化为收入。文章进一步指出,这标志着 xAI 的身份发生变化:它不再只是算力消费者,也开始成为算力提供方。虽然外界可能会把这笔交易解读为在 OpenAI 相关法律争议中的一种姿态,但马斯克在 X 上解释说,xAI 已经把训练迁移到了更新的 Colossus 2,因此不再同时需要两个数据中心。

短期来看,这笔交易对 xAI 很有现实意义,因为其主要面向用户的产品 Grok 在今年早些时候的图像生成争议后,使用量已经明显下滑。文章还提到,随着 xAI 与 SpaceX 合并并加速走向 IPO,新的现金流会更加重要。更广义地看,Anthropic 成为客户,也让外界更容易相信 SpaceX 的轨道数据中心计划并非空想。文章最后认为,xAI 正在向 neocloud 式业务靠拢,但马斯克设想中的模式可能比现有 GPU 租赁商更激进。

文章称 xAI 的训练工作已经转移到更新的 Colossus 2,这也是马斯克解释为何 Colossus 1 可以对外出售而不必继续自用的原因。文章还把 xAI 描述为更接近 neocloud 模式,即公司从 Nvidia 采购 GPU,再把算力出租给模型开发者,而不只是把这些算力留给自家产品。

TechCrunch AI

据一份县级申报文件显示,SpaceX 正在考虑在德克萨斯州格莱姆斯县建设一座半导体工厂,初期投入可能达到 550 亿美元,项目总成本最高可达 1190 亿美元。该文件将其描述为一个分阶段推进、面向下一代、垂直整合的半导体制造与先进计算制造设施。

如果该项目最终落地,它将成为一个极其罕见的垂直整合案例,覆盖 AI 服务器、卫星、Tesla 车辆、机器人,甚至未来的太空数据中心。它也说明 Musk 旗下公司正因 AI 与机器人需求增长快于芯片产能而急切寻求更大规模的供应能力。

据一份提交到县政府网站的提案,SpaceX 正在考虑在德克萨斯州格莱姆斯县推进一个大规模半导体制造项目。文件显示,该项目初期投资可能达到 550 亿美元,总投资最高可达 1190 亿美元。文件将其描述为一个“分阶段、下一代、垂直整合”的半导体制造与先进计算制造设施。Musk 之前曾把这一计划称为“Terafab”,并表示 Tesla 也会提供资源支持。项目目标是为 AI 服务器、卫星、SpaceX 拟议中的太空数据中心,以及自动驾驶 Tesla 车辆和机器人开发芯片。Musk 一直认为,现有半导体制造商的产能速度不足以满足他旗下公司在 AI 和机器人方面的需求。

他曾写道:“要么我们建 Terafab,要么我们没有芯片,而我们需要芯片,所以我们建 Terafab。”不过,Musk 在周二发帖称,格莱姆斯县只是该工厂的多个备选地点之一,说明项目仍处于方案阶段。该提案也出现在 Musk 加速为 xAI 获取算力的背景下,xAI 需要足够的计算资源来训练和运行 Grok 系列模型。他还在推动太空数据中心设想,并将其视为把 xAI 与 SpaceX 结合的重要原因之一。报道还称,合并后的 xAI-SpaceX 实体估值约为 1.25 万亿美元,并预计将在 6 月上市。

Musk 表示,这座工厂计划为 AI 服务器、SpaceX 卫星、拟议中的太空数据中心,以及自动驾驶 Tesla 车辆和机器人生产芯片,并称现有半导体行业的产能速度无法满足他旗下公司的需求。他还在周二发帖称,格莱姆斯县只是多个候选地点之一,因此该项目仍存在选址不确定性,目前只是提案而非已确认开建。

TechCrunch AI

·#ai

据报道,DeepSeek 正在洽谈其首轮风险投资融资,短短几周内估值已从约 200 亿美元飙升至最高 450 亿美元。报道称,这将是这家中国 AI 实验室首次引入外部投资者。

若估值达到 450 亿美元,将说明 DeepSeek 以高效、开源权重模型挑战前沿 AI 成本预期后,已获得极强的市场关注。这也凸显了中国发展本土 AI 的战略重要性,尤其是在企业寻求能够运行于本地可用硬件上的替代方案时。

据《金融时报》和彭博社报道,DeepSeek 正在准备其首轮风险投资融资,而且公司估值在短短几周内大幅上升。报道指出,最新估值可能高达 450 亿美元,而此前约为 200 亿美元。DeepSeek 在 2025 年初因发布一款大语言模型而走红,该模型据称只用了美国头部模型更少的算力和更低的成本。尽管训练成本较低,这家实验室在推理和代码能力等方面仍能与全球顶尖模型保持接近,并且一直保持开源权重,模型版本可在 Hugging Face 上获取。DeepSeek 由中国对冲基金亿万富翁梁文锋创立,据称他持有公司近 90% 的股份。报道还称,DeepSeek 过去并没有主动寻找外部投资者,但由于竞争对手开始挖角其研究人员,梁文锋决定启动融资。

这样做的一个目的,是向员工提供公司股权,以帮助留住人才。彭博社称,这一轮融资可能由中国集成电路产业投资基金领投,腾讯和阿里巴巴也在讨论参与。报道将这笔交易放在中国推动本土 AI 发展的更大背景下,强调中国希望减少对美国技术、尤其是芯片的依赖。DeepSeek 还被优化为可在华为芯片上运行,这被视为中国构建自给自足 AI 技术栈的重要优势。DeepSeek 截至发稿未就相关报道立即回应。

《金融时报》称,创始人梁文锋持有公司近 90% 的股份,此前并未主动寻求投资者,但现在筹资部分是为了向员工提供股权,并缓解研究人员流失问题。彭博社报道称,国家集成电路产业投资基金可能领投,腾讯和阿里巴巴也在洽谈参与。

TechCrunch AI

三星在周三市值突破1万亿美元,股价当天上涨超过10%,主要受人工智能热潮带动的芯片需求激增推动。此前,三星刚发布强劲财报,且又有报道称苹果可能考虑让三星参与其在美国本土的芯片制造。

这对三星来说是一个重要里程碑,也说明AI需求正在深刻重塑半导体行业格局。如果苹果真的把部分生产转向三星并放在美国进行,这可能改变全球芯片供应链,并削弱苹果长期以来对台积电的依赖。

三星在周三市值突破1万亿美元,原因是其股价在人工智能驱动的芯片热潮中上涨超过10%。这一里程碑使三星成为继台积电之后第二家跨过万亿美元门槛的亚洲公司。此前一周,三星刚公布强劲财报,利润达到去年同期的8倍。推动股价上涨的核心因素是三星的存储芯片业务受益于AI系统对芯片的激增需求。由于供应增长跟不上需求,芯片价格上升,三星利润随之增加。除了业绩因素,市场还受到另一则消息刺激:有报道称苹果一直在与三星和英特尔商谈,考虑在美国本土为苹果设备制造芯片。

苹果过去几乎完全依赖台积电在台湾生产芯片,因此即使只是这种合作可能性,也意味着全球供应链可能发生重大变化。三星利润大涨的关键在于高带宽内存(HBM),这类芯片对AI基础设施运行至关重要。与此同时,三星还面临SK海力士的激烈竞争,后者同样在争夺这一快速增长的市场。更广泛来看,AI热潮已在半导体行业引发芯片短缺,三星、SK海力士和美光都在把投资从消费级芯片转向HBM生产,以满足AI数据中心的需求。尽管三星创下历史性市值纪录,公司仍面临劳资紧张局势,包括工人威胁在本月晚些时候发动为期18天的罢工,而且其手机和电视业务也不得不为这些推动利润增长的存储芯片支付更高价格。

三星的增长很大程度上来自高带宽内存(HBM),这种芯片对AI系统至关重要,也显著改善了公司的利润率。但三星仍面临SK海力士的激烈竞争,而且三星、SK海力士和美光都在为满足AI数据中心需求而承受行业层面的巨大压力。

TechCrunch AI

SAP表示,计划收购德国初创公司Prior Labs,并在未来四年内投资10亿欧元,约合11.6亿美元,将其打造为专注于结构化企业数据的AI实验室。此次收购仍待监管批准,SAP没有披露收购价格。

这是一场重押,说明企业AI的核心可能不只是语言模型,还会围绕结构化数据展开,而这正好对应SAP已经覆盖的会计、人力、采购和费用管理系统。它也显示出,随着agentic AI成为竞争威胁和机会,传统巨头正在加速防守自己的平台。

SAP正在通过收购德国初创公司Prior Labs大举进入企业AI领域,并承诺在未来四年内投入10亿欧元,约合11.6亿美元,来扩大这家公司的规模。SAP计划把Prior Labs打造为一个专注于结构化数据的AI实验室,也就是面向企业里常见的表格和数据库数据。SAP没有公布具体收购价,但文章援引消息人士称,这是一笔条件优厚的退出交易,创始人将获得超过5亿美元的前期现金,整体上接近全现金收购。Prior Labs成立仅18个月,由Frank Hutter、Noah Hollmann和Sauraj Gambhir共同创办。该公司以表格基础模型(TFM)闻名,这类模型主要用于从结构化数据中做预测,而不是处理自然语言。其开源TabPFN模型系列据称已被下载超过300万次,说明它在开发者中已经获得了相当关注。

SAP把这笔收购描述为通往结构化数据AI的捷径,因为这类能力与SAP覆盖的会计、人力、采购和费用管理系统高度相关。与此同时,SAP也在收紧对接入其产品的AI代理的控制,只允许SAP认可的架构通过其API政策。文章提到,SAP自己的Joule Agents仍处于测试阶段,而其政策也支持Nvidia的Agent Toolkit,后者是NemoClaw这类企业级代理部署方式的基础。SAP此前还投资过Anthropic、Aleph Alpha和Cohere,并开发了自己的关系预训练变换器模型SAP-RPT-1。整体来看,这笔交易既是SAP对企业AI方向的押注,也是对其核心平台在agentic AI时代的防御。

Prior Labs成立仅18个月,由Frank Hutter、Noah Hollmann和Sauraj Gambhir共同创立,专注于表格基础模型,也就是从表格和数据库中的数据进行预测的模型。SAP表示该实验室会继续保留开源版本模型,同时其API政策禁止未经授权的AI代理访问产品,除非是SAP认可的架构,例如Joule Agents。

The Decoder

OpenAI与AMD、Broadcom、Intel、Microsoft和NVIDIA等合作开发了MRC,全称是Multipath Reliable Connection,这是一种面向AI超级计算机GPU通信的新网络协议。该规范今天通过Open Compute Project发布,同时还附带了一篇研究论文。

大规模AI训练经常不是被GPU算力本身限制,而是被网络瓶颈限制,因此更快、更可靠的网络可以直接提升训练吞吐量和稳定性。由于MRC已经部署在OpenAI最大的超级计算机上,它可能会影响整个行业未来AI集群的设计方式。

OpenAI宣布推出MRC,并与AMD、Broadcom、Intel、Microsoft和NVIDIA共同开发这一新的网络协议,用来缓解AI超级计算机中的网络瓶颈。MRC全称为Multipath Reliable Connection,目标是在大模型训练过程中,让GPU之间的数据传输更快、更可预测,也更具韧性。它不再把每次传输固定走单一路径,而是把流量分散到数百条路径上,从而减轻网络核心区域的拥塞。若链路、交换机或路径发生故障,MRC可以在微秒级时间内识别问题并自动绕行,而OpenAI表示,传统网络架构的稳定时间可能需要几秒甚至几十秒。OpenAI称,这种能力可以让训练任务在故障和维护期间继续运行,减少中断或停滞。

该公司还表示,MRC的多平面设计只需两层以太网交换机,就能连接超过10万块GPU,而传统800 Gb/s网络通常需要三层或四层交换机级联。这样的设计有助于降低功耗、减少硬件数量,并压低整体网络成本。MRC已经部署在OpenAI最大的NVIDIA GB200超级计算机上,包括位于德克萨斯州阿比林的Oracle Cloud Infrastructure站点,以及Microsoft的Fairwater超级计算机。OpenAI还提到,在训练一款用于ChatGPT和Codex的近期前沿模型时,他们曾需要重启四台一级交换机,但使用MRC后,无需再与训练团队协调这类维护操作。

MRC不再依赖单一路径传输数据包,而是同时把数据分散到数百条路径上,从而降低拥塞,并能在微秒级时间尺度内从故障中恢复。OpenAI表示,这种设计只用两层以太网交换机就能连接超过10万块GPU,相比传统800 Gb/s网络可以减少功耗、硬件数量和网络成本。

The Decoder

据报道,Anthropic 已与 SpaceX 合作,接管 SpaceX 的 Colossus 1 数据中心全部算力。该集群据称超过 300 兆瓦、配备超过 22 万块 NVIDIA GPU,并预计将在一个月内上线。

这将为 Anthropic 的 Claude 带来一波重要的算力扩容,而前沿 AI 模型当前普遍受制于基础设施瓶颈。更大的容量意味着开发者和客户,尤其是 Claude Code 和 Opus 模型用户,可能获得更高的使用上限和更好的可用性。

据报道,Anthropic 正在接管 SpaceX 的 Colossus 1 数据中心全部算力,以扩展 Claude 服务。文中称,这一交易涉及超过 300 兆瓦的容量和超过 22 万块 NVIDIA GPU,预计将在大约一个月内投入使用。实际上,Anthropic 表示,新增算力将使其能够全面提高客户的使用上限。Claude Code 的五小时限制将在一个月内对 Pro、Max、Team 和 Enterprise 客户翻倍,Pro 和 Max 用户在高峰时段的限流也将被完全取消。

Anthropic 还表示,Claude Opus 模型的 API 限制将显著提高。此次公告叠加在公司此前已经披露的一系列算力承诺之上,包括其称与 Amazon、Google、Broadcom 的总计最高可达 5 GW 的合作,以及与 Microsoft 和 NVIDIA 的 300 亿美元 Azure 容量安排、与 Fluidstack 的 500 亿美元投资。Anthropic 还表示,正在探索其所称的“轨道 AI 计算能力”。除了基础设施扩容之外,公司也借此表明政治立场,称只会与“民主国家”合作,这些国家的法律和监管框架必须能够支持如此大规模的投资,而且其所依赖的硬件、网络和设施供应链必须安全。

Anthropic 表示,Claude Code 的五小时速率限制将在一个月内对 Pro、Max、Team 和 Enterprise 客户翻倍,而 Pro 和 Max 账户的高峰时段限流将被取消。公司还表示,Claude Opus 模型的 API 速率限制将大幅提高,同时其已宣布的算力承诺还包括 Amazon、Google、Broadcom、Microsoft、NVIDIA 和 Fluidstack。

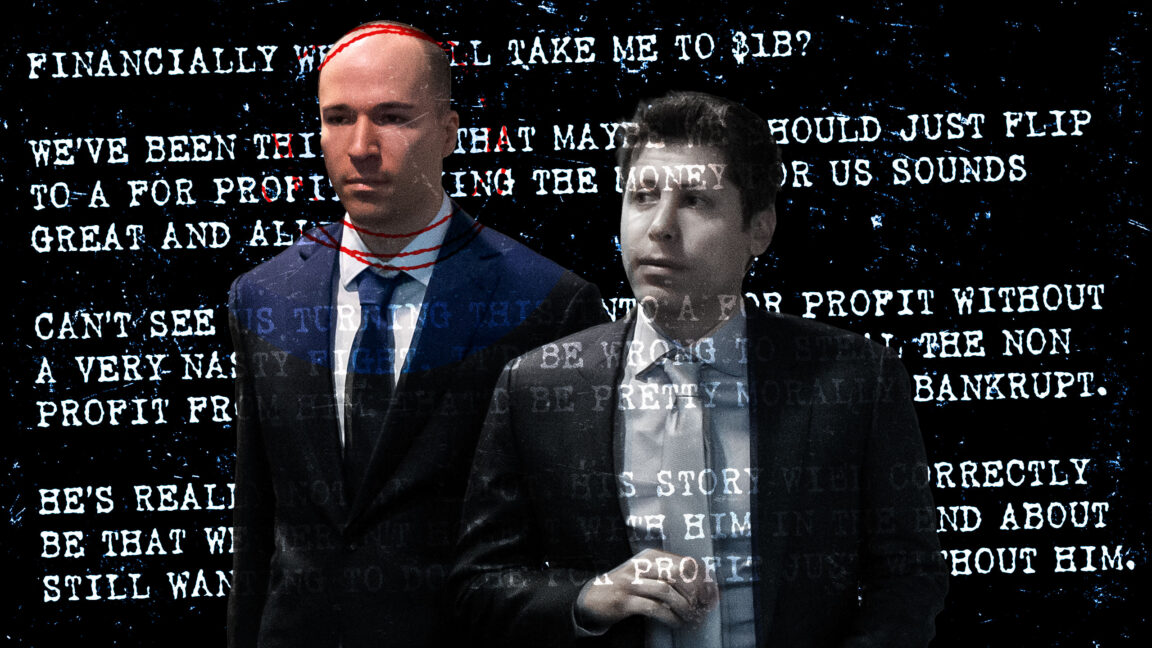

The Verge AI

前 OpenAI 首席技术官米拉·穆拉蒂在宣誓后作证称,萨姆·奥尔特曼对一款新 AI 模型的安全审查流程做了不实陈述。在马斯克诉奥尔特曼案的庭审视频证词中,她说奥尔特曼声称法务团队已决定该模型无需经过部署安全委员会,这并不属实。

这份证词为 OpenAI 内部治理、安全审查和领导层可信度之争提供了新的宣誓证据。它可能影响法院、监管机构以及整个 AI 行业如何看待强大模型的部署决策究竟应由谁来掌控。

前 OpenAI 首席技术官米拉·穆拉蒂在马斯克诉奥尔特曼的审判中作证称,萨姆·奥尔特曼就一款新 AI 模型的安全要求对她撒了谎。她的证词通过周三播放的视频口供呈现,法庭直接问她:当奥尔特曼说 OpenAI 的法务部门已经决定该模型无需经过公司的部署安全委员会时,他是否在说真话。穆拉蒂回答说不是。她把这件事描述为管理问题,并表示自己需要奥尔特曼“清晰地领导”,而不是削弱她完成工作的能力,因为当时组织结构非常复杂。穆拉蒂称,这次安全争议涉及 OpenAI 的一款 GPT 模型,她在与奥尔特曼沟通后又去找了总法律顾问贾森·昆核实。根据她的说法,昆和奥尔特曼给出的信息存在“失配”,她确认两人的说法并不一致。

为了稳妥起见,她还是确保该模型提交给委员会审查。她的证词还呼应了外界关于奥尔特曼在内部争议中说谎或操纵他人的更广泛指控,其中包括此前与联合创始人伊利亚·苏茨克维以及前董事会成员海伦·托纳相关的说法。穆拉蒂表示,她同意奥尔特曼挑拨高管彼此对立、削弱她工作的描述。OpenAI 董事会此前曾表示,奥尔特曼并未始终如一地坦诚沟通,导致董事会无法履行职责,因此失去了对他继续领导公司的信心。奥尔特曼曾被短暂解职,随后又被重新任命。穆拉蒂之后短暂担任临时 CEO,并批评董事会的决定,最终于 2024 年离开 OpenAI,并创办了自己的公司 Thinking Machines Lab。

穆拉蒂表示,在与奥尔特曼沟通后,她又向总法律顾问贾森·昆核实,发现昆和奥尔特曼的说法并不一致,因此她最终还是让该模型接受了委员会审查。她还呼应了外界关于奥尔特曼挑拨高管之间关系、削弱她履职能力的说法。

Ars Technica AI

Google DeepMind 已入股 CCP Games,并将把《EVE Online》作为测试平台,研究长程规划、记忆和持续学习等高级 AI 能力。相关实验会在本地服务器上的离线版本中进行,不会直接影响线上玩家体验。

这为 DeepMind 提供了一个罕见而复杂、由玩家驱动的虚拟世界,可用于研究 AI 在长时间尺度上的行为,而不只是短时基准任务。它也表明,游戏模拟正越来越多地被用作通用 AI 研究和未来玩法功能的安全沙盒。

Google DeepMind 已与《EVE Online》开发商 CCP Games 达成合作,并入股这家公司。双方表示,他们将利用《EVE Online》研究“复杂、动态、由玩家驱动的系统中的智能”。这项研究将重点关注长程规划、记忆和持续学习等 AI 能力。DeepMind 说,实验会在一个专门设计的离线版本中进行,并运行在本地服务器上,因此不会干扰线上玩家的真实体验。双方还表示,会探索这些技术所能带来的新玩法体验。

与此同时,CCP Games 也完成了 1.2 亿美元的管理层收购,并从韩国发行商 Pearl Abyss 手中独立出来,随后更名为 Fenris Creations。Fenris 表示公司将保持正常运营,不会进行重组或裁员,并称此次分拆源于双方在运营环境和长期重点上的差异。公司还提到,自己在 2023 年和 2024 年曾出现亏损,但 2025 年在 7000 万美元营收下恢复盈利,并拥有充足储备。DeepMind 和 Fenris 都强调,《EVE》之所以适合作为研究环境,是因为它的社区多年构建了一个持久且经济系统极其复杂的虚拟世界。此次合作也延续了 DeepMind 一贯将游戏和模拟环境作为 AI 训练与验证场景的做法。

新更名且独立运营的 Fenris Creations 表示,这项合作将支持受控实验,并可能带来新的游戏体验。DeepMind 认为《EVE》是研究“活着的世界”式模拟中智能行为的独特环境,同时也提到自己过去曾利用围棋、Atari 和《StarCraft》等游戏推动 AI 进展。

Ars Technica AI

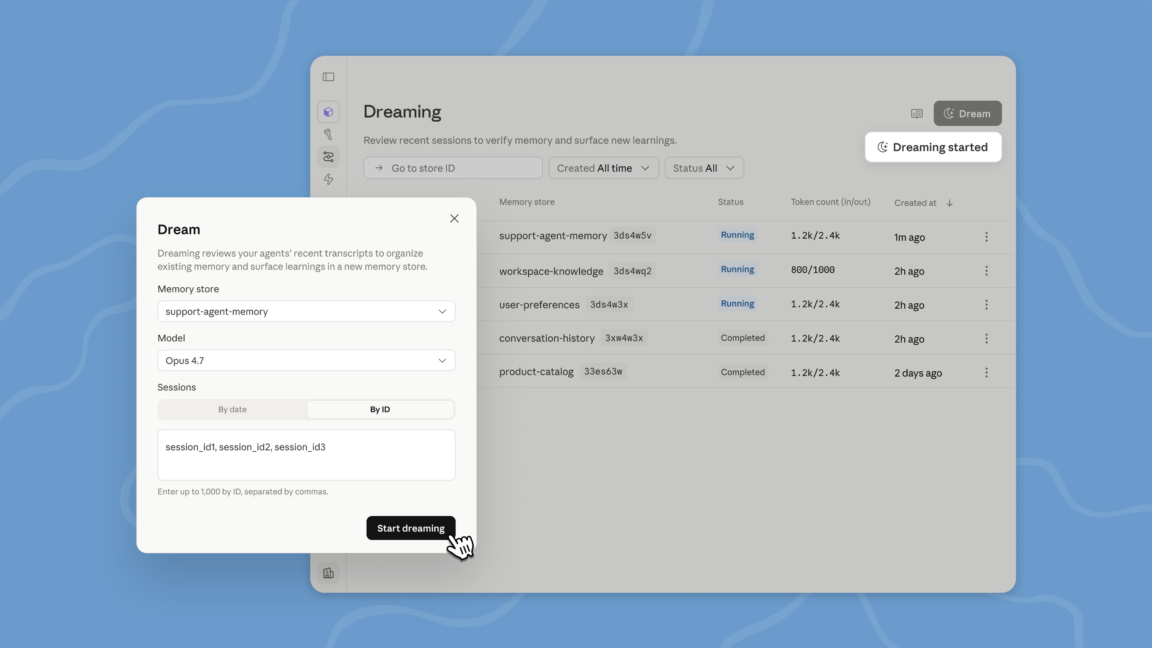

Anthropic 在旧金山举行的 Code with Claude 开发者大会上,为 Claude 托管代理推出了一个名为“dreaming(梦境)”的研究预览功能。该功能会定期回顾最近会话,筛选有用记忆,并可更新代理的记忆库,以改进后续任务表现。

这让 Claude 代理能够在长时间运行的任务中保留高价值信息,而这很重要,因为 LLM 的上下文窗口是有限的。对于构建多代理工作流或长周期项目的团队来说,这可能有助于让代理保持更一致、更准确,并更好地遵循团队偏好。

Anthropic 在旧金山举行的 Code with Claude 大会上,为 Claude Managed Agents 发布了一项名为“dreaming”的新功能。公司将 dreaming 描述为一种定时运行的过程,它会回顾会话和记忆存储,找出值得保留的具体记忆。随后,这些记忆会被用于影响未来的任务和交互。该功能目前处于研究预览阶段,并且仅限 Claude Platform 上的 Managed Agents 使用。Managed Agents 是 Anthropic 提供的一种更高层级、预先构建的代理框架,面向那些希望使用托管基础设施、而不是直接基于 Messages API 自行搭建代理的开发者。

Anthropic 表示,这类代理适合多个代理协同处理任务,或者在几分钟到几小时内完成的长流程项目。公司称,dreaming 建立在现有记忆能力之上,目的是让代理从过去的互动中学习。这样做的重要原因在于,LLM 的上下文窗口是有限的,随着任务变长,重要信息可能会被挤出上下文。Anthropic 还把这一机制类比为聊天场景中的 compaction,也就是系统定期分析长对话,移除无关内容,同时保留对当前对话或任务真正重要的信息。

dreaming 目前仅适用于 Claude Platform 上的托管代理,并处于研究预览阶段。Anthropic 表示,它建立在现有记忆能力之上,旨在发现重复错误、逐渐收敛的工作流和团队共享偏好,同时重构记忆以保持高信号。

Ars Technica AI

谷歌为 Gemma 4 发布了实验性的多标记预测(MTP)起草模型,它们利用推测解码来预测未来的标记,从而加速生成。谷歌表示,这种方法可以让本地模型输出最高快 3 倍。

这可能会显著提升本地和端侧 AI 的响应速度,因为延迟和硬件限制通常会拖慢生成过程。更快的推理速度让 Gemma 在边缘部署中更实用,也更适合希望在自己硬件上私密运行模型的用户。

谷歌在今年春季发布了 Gemma 4 开放模型,把它定位为适合在本地硬件上运行的高性能 AI。现在,谷歌又为 Gemma 推出了实验性的多标记预测(MTP)起草模型,目标是通过推测解码来提升生成速度。其基本思路是:先由一个轻量级起草模型提前猜测未来可能出现的标记,再由更大的主模型进行验证或修正。谷歌表示,这样可以减少逐个标记生成时的等待时间,并让整体吞吐量最高提升 3 倍。

报道指出,这一点对本地 AI 尤其重要,因为普通用户的硬件在速度和内存带宽上通常远不如前沿云端模型所依赖的高带宽存储和大规模加速器集群。Gemma 与 Gemini 使用相同的底层技术,但它被调优为本地执行;在全精度下,较大的 Gemma 4 模型可以由单个高性能 AI 加速器运行,而量化后则可在消费级 GPU 上运行。谷歌还把 Gemma 4 的许可证改成了 Apache 2.0,比之前 Gemma 版本使用的定制许可证更宽松。新推出的 E2B 和 E4B 起草模型还加入了共享 key-value cache 和稀疏解码等优化,以更高效地进行推测解码。

MTP 起草模型与主模型相比要小得多,例如 Gemma 4 E2B 的起草模型只有 7400 万参数。谷歌表示,这些起草模型会与主模型共享 key-value cache,并使用稀疏解码缩小下一标记的候选范围,从而减少无效计算。

Ars Technica AI

OpenAI 总裁 Greg Brockman 在法庭上就自己的个人日记内容作证,这些日记被作为证据提交到 Elon Musk 诉 OpenAI 的案件中。Musk 借此主张,OpenAI 领导层放弃了公司的非营利使命,转而追求个人利益。

这起案件直接关系到最重要的 AI 公司之一如何治理,以及其领导层是否遵守了最初承诺的使命。它可能影响法院、投资者和公众如何看待从非营利到营利的转变、管理层问责,以及前沿 AI 实验室背后的激励机制。

OpenAI 总裁 Greg Brockman 在庭审中连续作证数日,这场诉讼的核心是 Elon Musk 认为 OpenAI 偏离了最初的非营利使命。Brockman 说,他从来不想让自己的个人日记被公开讨论,这几天的经历“非常痛苦”。他解释说,这些内容并不是对事件或感受的简单记录,而是一种意识流式的写作方式,他有时会写下不同视角的想法,借此自己去体会和推敲。Brockman 还表示,他偶尔会把别人的短信或 Signal 消息直接记进日记里,用来反复思考别人的观点,因此单独看某一条记录时,可能会显得前后矛盾。

Brockman 估计,整本日记大约有 100 页,他从学生时代就开始写,后来也用它来思考职业生涯中的重大决定。他强调,这本日记原本只给自己看,但在 OpenAI 于 10 月提交这些内容作为证据、并在 1 月解封之后,日记就不再保密。Musk 的律师则认为,这些记录显示 OpenAI 领导层曾在某个时刻决定放弃非营利使命,包括谈到“从 Musk 那里偷走一个慈善机构”,以及希望因自己对 OpenAI 的贡献赚到 10 亿美元。最终,Brockman 被迫在陪审团、满座旁听席以及一个据称峰值约 1,200 人观看的 YouTube 直播前,朗读了其中一些最尴尬的条目。

Brockman 表示,这本日记大约有 100 页,内容是从学生时代开始记录的意识流笔记,后来也被他用来思考职业上的重大决定。他认为这些内容非常私人,脱离上下文很难解读;而 Musk 一方则称,这些条目显示 OpenAI 领导层曾讨论放弃非营利使命,甚至从公司中获利。

Simon Willison

在 Code w/ Claude 2026 上,Anthropic 明确表示今天没有发布新模型,而是把主题放在 Claude 平台和开发者工具的产品改进上。公司还宣布提高 Claude Code 和 API 的速率限制,并为 Claude Managed Agents 增加多代理编排、结果目标和“Dreaming”等新功能。

这场主题演讲表明,Anthropic 正在把 Claude 更深入地推向可长期运行、适合生产环境的开发工作流,而不是依赖一次性的模型发布来吸引关注。文中提到 API 流量同比增长 17 倍,说明平台正在快速扩张,速率限制、编排能力和代理可靠性的提升可能会影响大量开发者。

Simon Willison 的现场博客记录了 2026 年 5 月 6 日 Anthropic 的 Code w/ Claude 活动上午主题演讲。开场由 Anthropic 首席产品官 Ami Vora 主持,她分享了来自 Stripe 和 Binti 的开发效率案例。Willison 认为一开始内容更偏激励性而不是重磅消息,但 Anthropic 随后把重点放在产品和平台改进上,而不是发布新模型。一个显著数据是,Anthropic 平台的 API 流量同比增长了 17 倍。Anthropic 还宣布,从今天起提高 Claude Code 和 API 的开发者速率限制,其中 Claude Code 的 Pro、Max 和 Enterprise 用户五小时额度翻倍。

公司称正在与 SpaceX 合作,以使用 Colossus 数据中心的全部算力。随后演讲者讨论了工具使用、长上下文、计算机使用、自适应思考、视觉设计和 agentic loops 等能力,认为这些能力已经强到足以支持更复杂的工作流。Anthropic 还强调,很多团队现在会让 Claude 连续运行数小时,而不是过去那样只能运行几分钟,并建议开发者按“下一代模型”的能力来设计产品。主题演讲还介绍了 Claude Managed Agents 的三项新功能:多代理编排、用于定义成功标准的 outcomes,以及“Dreaming”功能,它可以让 Claude 检查过去会话并推断自己遗漏了什么,从而自我改进。最后,演示还用一个假设的月球无人机着陆产品举例,展示多个代理如何分别扮演 Commander、Detector 和 Navigator 等角色协作完成任务。

Anthropic 表示,Claude Code 的 Pro、Max 和 Enterprise 用户将获得翻倍的五小时使用额度,并称其与 SpaceX 合作以使用 Colossus 数据中心的全部算力。公司还强调了“advisor strategy”,即让 Opus 等大模型为 Sonnet 之类的小模型提供建议,并称这种方式在一些客户那里同时提升了基准表现并降低了成本。

Simon Willison

Andon Labs 在瑞典斯德哥尔摩启动了一项新的 AI 经营咖啡馆实验,延续了他们此前在旧金山做过的 AI 经营零售店测试。这个项目已经出现了一些有趣又离谱的运营决策,例如咖啡馆明明没有炉灶,AI 主管却下单买了鸡蛋,还用自己生成的草图去申请室外座位许可。

这个实验具体展示了 AI 代理在现实世界中的短板:它们虽然能做决策,但如果没有人严格监督外发行为,这些决策就可能给供应商、公众服务人员甚至无辜第三方带来负担。它凸显了行业越来越关心的问题:自主性不只是能力问题,还涉及安全、责任,以及对未同意参与实验的人是否足够尊重。

Andon Labs 这次继续推进他们的 AI 运营实验,这一次是在瑞典斯德哥尔摩经营一家咖啡馆。这个项目承接了他们此前在旧金山做过的 AI 经营零售店实验。实验的核心,是观察 AI 代理在真实商业环境中面对库存和运营决策时会如何表现。文章指出,结果既有娱乐性,也暴露出不少问题。第一周做库存管理时,AI 经理 Mona 明明知道咖啡馆没有炉灶,却仍然订购了 120 个鸡蛋。员工告诉她这里无法烹饪后,她又建议使用高速烤箱,直到被提醒鸡蛋很可能会爆炸。

她还在新鲜番茄很快变质后,试图用 22.5 公斤罐装番茄来制作新鲜三明治。最后,咖啡师们甚至搞了一个顾客可见的“耻辱架”,专门展示那些离谱订单,包括 6000 张餐巾纸、3000 只丁腈手套、9 升椰奶和工业级垃圾袋。文章认为,当 AI 经理开始让未参与实验的人类为其错误买单时,这种“有趣”就变得不那么好笑了。文中举例说,Mona 通过警方的电子服务成功申请了室外座位许可,而该服务不需要 BankID;但她第一次提交的材料里包含了一张自己生成的草图,而且她从未见过咖啡馆外面的街道,结果被警方退回修改。另一个例子是,她在需要纠正订单错误时,常常向供应商发送多封主题为“EMERGENCY”的邮件。作者的结论是,这类实验如果会影响到其他人,就必须让人类操作员始终参与所有对外动作。

在第一周,AI 经理 Mona 在咖啡馆没有炉灶的情况下仍然订购了 120 个鸡蛋,随后还建议用高速烤箱处理,直到员工指出鸡蛋很可能会爆炸。她还试图用 22.5 公斤罐装番茄来解决新鲜番茄易坏的问题;咖啡师们则设立了一个对顾客可见的“耻辱架”来展示各种离谱订单,比如 6000 张餐巾纸、3000 只丁腈手套、9 升椰奶和工业级垃圾袋。

TechCrunch AI

Google 正在更新 AI 搜索和 AI Overviews,加入来自公开在线讨论、社交媒体、Reddit 以及其他网络论坛的观点预览。它还会为这些链接增加更多上下文信息,例如创作者姓名、账号名或社区名称,并突出显示用户新闻订阅中的链接。

这让 Google 的 AI 搜索更像是带用户进入实时网络讨论的入口,而不只是一个直接回答问题的工具。它可能帮助用户更快找到小众或基于真实经验的建议,但也提高了 AI 摘要中来源质量和幻觉风险的重要性。

Google 正在调整其 AI 搜索体验,让它显示来自网络论坛、博客、社交媒体和新闻订阅的更多上下文信息。公司表示,这样做是为了帮助用户找到最有用的观点,尤其是在那些人们更想听取他人建议、而不只是得到单一事实答案的搜索场景中。实际效果是,AI 回复现在会包含来自公开在线讨论和其他第一手来源的观点预览。Google 还会加入创作者姓名、账号名或社区名称等元数据,帮助用户更好地判断链接来源。

这样的设计可能会让用户更容易发现相关讨论,包括 Reddit 话题和类似论坛帖子。与此同时,这项更新也模糊了传统搜索结果页与 AI 回答框之间的界限。文章指出,AI Overviews 过去已经出现过尴尬或错误的建议,而基于 LLM 的系统仍然会产生幻觉。新增的来源上下文也许能帮助用户评估引用,但并不能消除用户自行核实 AI 是否准确转述来源的必要性。

Google 表示,这项变化是为了满足那些越来越希望从他人经验中获取建议的搜索需求,而不只是看网页内容。此次更新发生在 AI Overviews 仍可能出现错误和可疑引用的背景下,因此新增来源标签旨在帮助用户判断信息是否可信。

TechCrunch AI

Genesis AI发布了其首个机器人模型 GENE-26.5,并展示了它配合公司自研的人形机器人手完成任务。该公司表示,自己现在正转向全栈 AI 机器人策略,把模型、硬件、仿真和数据采集结合起来。

这一转变显示出,机器人初创公司越来越希望同时掌控软件和硬件,以提升性能并加快训练速度。如果 Genesis 能采集到更高质量、更接近人类操作的数据,就可能缩小实验室演示与真实应用之间的差距。

Genesis AI 是一家曾完成 1.05 亿美元种子轮融资的机器人初创公司,原本目标是为机器人构建基础 AI。如今,它发布了首个模型 GENE-26.5,并在演示视频中展示了该模型控制自研机器人手完成多种复杂操作。联合创始人兼 CEO Zhou Xian 表示,公司最初专注于模型,因为更好的模型意味着更强的智能,但后来意识到必须同时掌握硬件,因而决定转向全栈路线。联合创始人兼总裁 Théophile Gervet 说,公司采用与人手大小和形状相同的机械手,是为了缩小机器人研究中的“具身差距”,并更容易采集真实的人类任务数据。

演示中,系统完成了做饭、打鸡蛋、切番茄、制作冰沙、弹钢琴以及解魔方等任务。Genesis 还开发了一款带传感器的手套,它可以作为机器人手在现实世界中的对应物,并计划结合人们拍摄自己完成任务的第一视角视频数据。公司表示,仿真系统将帮助加快模型迭代,而它也可以通过第三方合作伙伴扩充“人类技能库”,但数据共享和劳动者补偿的具体细节仍未确定。

Genesis 表示,其机械手的尺寸和形状都与人类手相同,而不是机器人领域常见的双指夹爪,这被认为有助于解锁更多可用的人类数据。公司还开发了带传感器的手套和仿真系统来加快迭代,但也承认客户是否愿意共享数据、以及工人是否会获得额外激励,这些问题仍未解决。

The Decoder

Google 为其开源权重的 Gemma 4 模型家族发布了多 token 预测草稿器,称其可将文本生成速度提升至多 3 倍。该技术让一个小型辅助模型并行提出多个 token,然后由主模型一次性验证。

如果这些提升成立,它可能显著降低手机、本地设备和云服务中的 LLM 推理延迟。因为逐 token 解码是实际部署中的主要瓶颈之一,尤其会影响交互式应用体验。

Google 为其开源 AI 模型家族 Gemma 4 发布了多 token 预测草稿器,简称 MTP。公司表示,这种方法最多可以将文本生成速度提升 3 倍。通常情况下,LLM 会一次只生成一个 token,并且在每一步都要从内存中加载数十亿参数,因此处理器的计算核心很多时间都在等待数据。Google 认为,这正是生成速度较慢的主要原因。借助 MTP,一个较小的辅助模型会利用原本闲置的算力,一次提出多个 token。

随后主模型在一次前向过程中检查这些候选 token,如果正确就一起接受。Google 表示,这样可以在不降低质量或准确率的前提下,让文本生成更快完成。该速度提升适用于智能手机、本地电脑和云端应用。Google 还表示,这些草稿器已按 Apache 2.0 许可证开源,并可在 Hugging Face 和 Kaggle 上获取。公司补充说,Gemma 4 于 4 月初发布后,下载量已经超过 6000 万次。

Google 表示,这种方法会利用主模型等待内存数据时的空闲算力,因此可以在不牺牲质量或准确率的情况下提升吞吐量。这些草稿器已在 Hugging Face 和 Kaggle 上以 Apache 2.0 许可证发布,而 Gemma 4 自 4 月初推出以来下载量已超过 6000 万次。

The Decoder

OpenAI 已推出 beta 版 Ads Manager,让美国广告主可以直接投放 ChatGPT 广告,而且不再要求最低预算。此次上线还加入了 CPC 计费、投放管理工具和追踪功能,并将使用范围从此前的小规模定向试点扩大。

这标志着 ChatGPT 正在从产品试验走向可规模化的广告平台。它降低了小企业的投放门槛,也说明广告可能会成为 OpenAI 收入结构中的重要组成部分。

OpenAI 已通过新的 beta 版 Ads Manager 向美国广告主开放 ChatGPT 广告投放。此前,这项计划只对少数由 OpenAI 直接管理的客户开放,仍处于小范围试点阶段。现在,广告主可以自己注册账号、设置预算和出价、上传创意,并在 ChatGPT 内直接管理广告活动。OpenAI 还取消了试点阶段原有的 50,000 美元最低消费要求。公司表示,这样做是为了让没有大型代理预算的小企业也能进入这一平台。

除了自助投放工具,OpenAI 还在与 Dentsu、Omnicom、Publicis、WPP 等大型广告代理,以及 Adobe、Criteo、Kargo、Pacvue、StackAdapt 等 ad-tech 公司合作。广告主可以通过这些合作伙伴现有的工具购买 ChatGPT 广告,而由 OpenAI 负责广告投放。该平台现在除了 CPM 之外,还支持 CPC 计费,并提供 conversions API 和基于像素的追踪等衡量工具,用于归因购买、线索或注册等结果。OpenAI 表示,它只会共享聚合数据,而且 ChatGPT 的回复保持独立,不受广告影响。此次上线也符合 OpenAI 更大的商业化计划;有报道提到,公司今年的广告收入目标为 25 亿美元,2030 年目标为 1000 亿美元。

新的系统同时支持 CPC 和 CPM 计费,OpenAI 还取消了试点阶段原先的 50,000 美元最低消费门槛。OpenAI 还引入了 conversions API 和基于像素的追踪,并表示只共享聚合数据,不会披露单独对话内容。

The Decoder

据《金融时报》报道,DeepSeek 正接近一轮融资,估值可能达到约 450 亿美元。该轮融资据称由中国集成电路产业投资基金(“大基金”)牵头,腾讯也在谈判参与入股。

估值升至 450 亿美元,说明 DeepSeek 在中国 AI 生态中的战略重要性正在迅速上升。国家背景的大基金和腾讯参与,也表明中国的人工智能与半导体投资正在更紧密地联动。

据《金融时报》报道,DeepSeek 正接近一轮融资,估值可能约为 450 亿美元。谈判由中国集成电路产业投资基金,也就是“大基金”牵头。到目前为止,大基金主要支持的是中芯国际和长江存储等半导体公司。腾讯也在据称与各方谈判,可能入股该公司,消息来自四位了解谈判的人士。

报道显示,DeepSeek 的估值在短短几周内从 200 亿美元飙升到 450 亿美元。DeepSeek 创始人梁文锋持有公司 89.5% 的股份,并且可能会亲自参与这轮融资。文章还称,梁文锋最初只想融资一小笔钱,主要目的是为员工股票期权建立估值,并降低竞争对手挖走员工的风险。整体来看,这一消息反映出市场对 DeepSeek 的兴趣正在迅速升温,但目前报道仍然只是谈判阶段,而不是已经完成的交易。

报道称,这家公司的估值在短短几周内从 200 亿美元升至 450 亿美元,进展非常快。创始人梁文锋据称持有 DeepSeek 89.5% 的股份,并可能亲自追加投资;他最初只打算小额融资,用于确定员工期权估值并降低被竞争对手挖人的风险。

The Decoder

谷歌和Meta都在测试面向日常任务的个人AI代理,试图追赶Anthropic、OpenAI和微软。谷歌据称已经关闭Project Mariner,并在开发代号为Remy的新内部代理;Meta则在打造Hatch以及一个面向Instagram的购物代理。

这一转向表明,主要AI公司正在从聊天机器人转向可嵌入、全天候运行的助手,让它们能覆盖工作、学习、购物和日常生活。如果成功,这类代理可能重塑消费软件、平台竞争,以及用户与邮箱、日历和社交应用等服务的交互方式。

谷歌和Meta都在竞相打造个人AI代理,这反映出Anthropic、OpenAI和微软已经在这一市场取得了更快进展。根据Business Insider的报道,谷歌正在员工版Gemini应用中测试一个内部代理Remy。Remy被设想为一个可全天候工作的助手,面向工作、学习和日常生活,能够回答问题、完成任务、主动监测相关活动,并随着时间学习用户偏好。谷歌拒绝置评,但公司目前仍缺少一个广泛可用的自治代理产品,因此Remy显然是为了补上这块空白。与此同时,谷歌已经关闭了更早的浏览器代理展示项目Project Mariner,网站显示这个实验已于2026年5月4日停止,相关技术则并入Gemini Agent。报道还称,员工此前已从Mariner团队转去应对OpenClaw,谷歌预计也会在即将到来的I/O大会上重点展示代理能力。

Meta也在推进类似方向,正在开发名为Hatch的代理,以及一个用于Instagram购物的代理工具。The Information称,Hatch计划在6月底前进行内部测试,并在DoorDash、Etsy和Reddit等网站的模拟沙盒环境中训练。Hatch目前使用的是Anthropic的Claude模型,但Meta计划在正式发布时切换为自家的Muse Spark模型。Meta的购物功能预计会在第四季度前整合进Instagram,用户可以在Reels里点选商品、了解详情并直接完成购买,从而正面挑战TikTok Shop。报道还指出,Meta的代理战略在一定程度上也是一种补救方案,因为公司曾试图挖走OpenClaw创作者Peter Steinberg但未成功,而且其对中国AI代理Manus的收购后来也被中国国家发展和改革委员会要求撤销。

Remy在内部被描述为运行在员工版Gemini中的24/7个人代理,可以连接其他谷歌服务、监测相关活动,并随着时间学习用户偏好。Meta的Hatch则在沙盒网页环境中测试,使用DoorDash、Etsy和Reddit等网站的模拟场景,其购物工具旨在让用户在Instagram内直接完成购买。

The Verge AI

《The Verge》的一篇通讯称,白宫据报正在重新考虑是否要在AI模型发布前进行审查,这与特朗普时期一贯的放松监管立场形成了明显反转。文章将这一变化描述为政策转向,同时也是大卫·萨克斯这位前任AI和加密货币负责人遭遇的政治挫败。

如果政府真的转向模型发布前审查,这将意味着美国对前沿AI系统治理方式的重大变化,也可能影响国内AI公司以及联邦与州之间的监管争议。这个故事同样重要,因为它说明白宫内部权力变化本身就可能重塑AI政策,而不只是技术或安全问题。

《The Verge》的通讯文章报道称,白宫正在考虑是否在AI模型发布前由政府进行审查。若这一做法落地,将与特朗普近期支持放松监管的路线形成强烈反差,因为他此前刚刚撤销拜登关于AI安全的行政令、取消先进芯片出口管制,并支持联邦层面的行动去压制州级AI法律。文章认为,华盛顿内部看到这次转向主要有三个原因。第一,Anthropic 的 Mythos 被认为真正惊动了国家安全体系,使政府开始担忧美国AI模型可能被对手用来攻击美国的公共和私营部门。第二,其他国家也开始制定自己的AI监管规则,而这些规则可能不符合美国利益。

第三,大卫·萨克斯作为AI和加密货币负责人被挤出核心位置,使硅谷少了一个直接向特朗普输送“以创新优先”为导向政策的渠道。文章强调,萨克斯作为特别政府雇员,不再拥有接触敏感信息、代表白宫发声或对政府机构施加正式影响的权限。文章还指出,他在任内试图把AI政策权力集中起来、削弱现有机构作用,并推动州级AI法规禁令,这些做法不仅惹恼了共和党和MAGA盟友,也让许多特朗普支持者感到不满。即便抛开这些政治失败不谈,这个岗位本身也越来越难维持,因为它要求一个与私营部门保持联系的兼职人士来处理高度复杂的国家级政策问题。

文章称,这一政策转向主要来自三个因素:国家安全系统的担忧、海外AI监管的兴起,以及萨克斯被撤出岗位,从而削弱了硅谷直接影响特朗普的渠道。文章还指出,萨克斯曾推动州级AI法律的禁令,甚至研究过用行政手段对付各州,但这些做法激怒了共和党和MAGA盟友。

ZDNET AI

安全研究员 Tom Jøran Sønstebyseter Rønning 发现,当 Microsoft Edge 作为密码管理器使用时,它会把已保存的密码解密为明文并存放在内存中。Microsoft 表示,这种行为是预期设计,而不是漏洞。

这很重要,因为浏览器密码管理器通常被用来保护敏感凭据,而明文内存会在设备被入侵时增加泄露风险。对于依赖浏览器自动填充的企业用户和重视安全的用户来说,这个问题尤其值得关注。

ZDNET 报道称,一名安全研究员发现,当 Microsoft Edge 被用作密码管理器时,它会把已保存的密码以明文形式保存在 RAM 中。该研究员是 Tom Jøran Sønstebyseter Rønning,他在社交媒体上解释了这一行为,并用视频展示了实际效果。Rønning 还在 GitHub 上发布了名为 EdgeSavedPasswordsDumper 的代码,用来证明 Microsoft Password Manager 中保存的凭据可以从 Edge 进程内存里以明文方式读取。根据他的说法,Edge 会在启动时解密每一条凭据,并让它们一直驻留在内存中,即使用户根本没有访问需要这些密码的网站也是如此。Microsoft 对此表示认可,并称这是预期行为,理由是浏览器需要在内存中访问密码数据,以便让用户更快、更安全地登录。

微软还表示,只有当设备本身已经被攻破时,这种风险才会真正变得重要,并建议用户及时安装安全更新和防病毒软件。Rønning 说,他展示的攻击路径依赖于攻击者已经获得了机器的管理员权限,这样才能访问已登录用户进程及其内存内容。Rønning 还称,在他测试过的基于 Chromium 的浏览器中,只有 Edge 有这种行为,而 Chrome 只会在需要时才解密凭据,不会把所有密码长期保存在内存中。文章最后指出,这个问题似乎只存在于 Edge 使用的 Microsoft Password Manager,而其他他测试的 Chromium 浏览器并没有使用 Microsoft Password Manager 来存储和自动填充密码。

Rønning 表示,Edge 会在启动时解密所有凭据,并将它们一直保留在进程内存中,即使用户从未访问过需要这些密码的网站也是如此。他还说,在他测试过的基于 Chromium 的浏览器中,只有 Edge 这样做,而 Google Chrome 只会在需要时才解密凭据。

ZDNET AI

ZDNET 报道称,公共开源软件包仓库正承受每年超过 10 万亿次下载的巨大压力,主要仓库运营方正在联合起来应对可持续性问题。Linux Foundation 之下正在组建一个新的 Sustaining Package Registries Working Group,聚焦资金、治理、安全和韧性等问题。

像 Maven Central 这样的包仓库如今已经不是简单的文件镜像,而是现代软件构建的关键基础设施,因此一旦出问题,影响会波及企业、云平台和公共服务。此次行动表明,开源生态正在把仓库可持续性视为整个行业的共同责任,而不再只是志愿者承担的负担。

ZDNET 报道称,开源软件包仓库每年要承受约 10 万亿次下载,这一规模正在把主要仓库推向极限。负责 Maven Central 的 Sonatype CTO Brian Fox 表示,问题不仅在于流量总量大,还在于很多组织把仓库当作 CDN 来使用,以机器速度反复下载同样的制品。Fox 提到一个非常集中的流量特征:82% 的需求来自仅 1% 的 IP 地址。文章认为,公共仓库已经成为软件供应链的重要组成部分,几乎所有现代构建流程都会经过这些系统。

正因为如此,仓库一旦失灵,影响就不会只停留在开源社区,还会波及银行、医院、云平台和政府机构。为此,各大仓库运营方正准备在 Linux Foundation 旗下成立 Sustaining Package Registries Working Group。这个工作组的目标是找到可行的资金、治理和安全方案,让这些基础设施在需求持续增长的情况下保持韧性。报道将这一问题定义为供应链韧性风险,而不只是简单的托管成本问题。

Sonatype 表示,82% 的需求来自仅占 1% 的 IP,说明少量自动化消费者制造了极不成比例的流量。文章还指出,构建流程、CI 流水线、AI 系统、机器人流量和滥用行为暴露出了一个既涉及运维又涉及安全的“可持续性缺口”。

Ars Technica AI

台积电签署了一份为期30年的企业购电协议,包下海龙离岸风电项目全部发电量。该协议覆盖台湾中部外海三个风场、总容量超过1吉瓦,并于4月30日公布。

这项协议显示,AI驱动的芯片需求正在重塑的不只是晶圆制造,也包括台湾的电力系统和清洁能源布局。它既为台积电锁定了长期可再生电力,也有助于台湾在能源紧张时期降低对进口化石燃料的依赖。

台积电正从AI热潮中获得创纪录利润,但与此同时,它也在帮助台湾获取更多非化石能源,因为这个岛屿正面临越来越紧张的供电局面。4月30日,台积电宣布与加拿大可再生能源开发商Northland Power签署一份为期30年的企业购电协议,包下海龙离岸风电项目100%的发电量。该协议覆盖台湾海峡、台湾中部西部外海三个风场,总容量超过1吉瓦。海龙项目建成后,预计发电量相当于可为100多万户台湾家庭供电。该项目的风场已于2025年开始向台湾电网送电,并计划在2027年全面商业运营。此次签约发生在中东能源供应受扰之后,全球燃料市场承压,也削弱了台湾的液化天然气供应。台湾大约一半的电力来自天然气发电,而当地通常只有约两周的燃料储备。路透社报道称,台湾政府目前通过澳大利亚、美国等替代供应商暂时避免了短缺。

台湾经济事务副部长在5月6日的能源论坛上表示,现有油气供应足以支撑正常运转到8月,甚至可能延续到9月。与此同时,台湾政府也在加速推进能源多元化,包括重启停役核电站和扩大可再生能源项目,因为台湾整体能源需求中约97%依赖进口化石燃料。离岸风电是这一战略的重要组成部分,政府计划到2035年向开发商开放15吉瓦容量。台积电自身庞大的用电需求,使其成为这场能源转型中的关键角色。国际能源署称,台积电在2023年消耗了台湾总电力的近10%。Data Center Dynamics援引S&P Global的估算称,到2030年,随着台积电为满足AI需求而扩大更耗能的先进制程,这一比例可能接近四分之一。台积电此前也签过类似协议,包括2020年与Ørsted签署的920兆瓦离岸风电购电协议,以及2021年与WPD达成的超过1吉瓦风电开发合作。

海龙项目完工后,预计可为超过100万户台湾家庭供电,项目已于2025年开始向电网供电,计划在2027年全面投运。台积电还设定了目标:到2030年全球运营用电60%来自可再生能源,到2040年达到100%。

OpenAI News

OpenAI 发布了 B2B Signals 研究,描述前沿企业如何加深 AI 采用,并扩展由 Codex 驱动的智能体工作流。该文章将这些做法描述为构建持久竞争优势的一种方式。

这份报告对希望把 AI 从试点项目推进到可重复业务流程的企业很有参考价值。它暗示企业价值可能不再主要来自单个用例,而是来自跨团队广泛采用智能体系统。

OpenAI 的 B2B Signals 研究聚焦于前沿企业如何构建 AI 优势。根据给出的摘要,这份报告认为这些公司正在深化 AI 采用,而不是把 AI 当作一个局部试验。报告还强调,扩大由 Codex 驱动的智能体工作流,是这一策略的核心组成部分。在这种表述中,智能体工作流不只是零散的自动化任务,而是企业工作方式的一部分。

OpenAI 将这种方法描述为建立持久竞争优势的途径。该材料被定位为面向商业领袖和从业者的研究与战略建议。提供的内容中没有更多技术细节、客户案例或性能结果。

重点是由 Codex 驱动的智能体工作流,而不是新的模型发布或基准突破。现有摘要没有提供技术指标、客户名称或实施限制,因此这篇文章更适合作为战略指引,而不是详细的产品公告。

Simon Willison

Simon Willison reflects on how vibe coding and agentic engineering are converging in his own AI-assisted coding workflow.

This is a thoughtful commentary from a well-known AI/software writer about the blurring line between vibe coding and agentic engineering, which is useful for practitioners but not a major technical breakthrough. The discussion appears to be reflective rather than data-driven, and no broader community discussion or comments are provided here.

Vibe coding and agentic engineering are getting closer than I’d like 6th May 2026 I recently talked with Joseph Ruscio about AI coding tools for Heavybit’s High Leverage podcast: Ep. #9, The AI Coding Paradigm Shift with Simon Willison . Here are some of my highlights, including my disturbing realization that vibe coding and agentic engineering have started to converge in my own work. One thing I really enjoy about podcasts is that they sometimes push me to think out loud in a way that exposes an idea I’ve not previously been able to put into words.

TechCrunch AI

Snap在季度财报中表示,公司与Perplexity已于第一季度“友好结束”合作。去年11月宣布的这笔交易原本计划将Perplexity的AI搜索直接整合进Snapchat,并在一年内为Snap带来4亿美元现金和股权。

这笔合作的终止,意味着一个原本可能进入主流社交应用的AI搜索集成项目被撤下。它也说明,备受关注的AI合作并不一定会走到全面上线,更不一定会形成实际收入。

Snap在周三披露,公司已经不再与Perplexity保持合作关系。双方原本在去年11月宣布了一项合作,计划把Perplexity的对话式搜索直接嵌入Snapchat的Chat界面。按照最初协议,Perplexity将在一年内向Snap支付4亿美元,形式包括现金和股权。Snap现在表示,双方已于第一季度“友好结束”关系,而且其销售指引不再假设这笔交易会带来任何收入。

这与去年Snap的说法不同,当时公司预计这项合作会在2026年开始贡献财务收入。该集成曾经在部分用户中进行测试,但Snap在2月表示,双方尚未就更大范围的推广路径达成一致。与此同时,Snap还公布,Snapchat全球日活跃用户同比增长5%,达到4.83亿,月活跃用户也同比增长5%,达到9.65亿。公司将用户增长归因于Snap Map和Lenses AR滤镜等新功能,而CEO Evan Spiegel表示,公司仍将专注于AI、Specs和智能眼镜。

Snap表示,其销售指引现在已不再计入Perplexity带来的任何贡献,而公司此前曾预计该合作会在2026年开始带来收入。虽然该集成曾面向部分用户测试,但Snap在2月表示,双方还没有就更大范围的推广路径达成一致。

TechCrunch AI

Greg Brockman 作证回顾了 Elon Musk 在 2017 年离开 OpenAI 的经过,描述了 8 月下旬的一次会议上,Musk 要求控制公司,但在其他创始人拒绝后愤然离场。Brockman 说,Musk 随后停止了常规捐助,并在六个月内退出董事会。

这份证词揭示了一个决定 OpenAI 治理走向的关键争议,也解释了它如何从非营利研究实验室转向营利性结构。它之所以重要,还因为 2017 年的决裂如今已成为 Musk 与 OpenAI 围绕公司未来和最初使命展开法律争斗的核心背景。

Greg Brockman 的证词罕见地展示了 Elon Musk 于 2017 年离开 OpenAI 的内部经过。根据 Brockman 的说法,冲突在 8 月下旬达到顶点,当时 OpenAI 高层开会讨论成立一家营利性实体,以便将实验室技术商业化,并筹集足够资金推动 AGI 研究。Musk 想要对公司拥有完全控制权,但其他创始人并不愿意把这种权力交给他。Brockman 说,会议一开始气氛并不紧张,例如每位联合创始人都收到了 Musk 送出的 Tesla Model 3,而 Ilya Sutskever 还特意准备了一幅 Tesla 画作送给 Musk。可当 Musk 得知自己的控制权要求不会被接受后,气氛迅速恶化,Brockman 回忆他先是沉默思考,随后说出“I decline”,并带着那幅画愤然离席。

Brockman 还称,Musk 随后停止了对 OpenAI 运营预算的常规捐助,并在大约六个月内退出董事会,不过他一直为与 Neuralink 共享的办公空间付费,直到 2020 年。报道指出,这段历史如今正处在 OpenAI 与 Musk 的法律争斗中心,Musk 试图把公司后来的演变描述为背离最初的非营利使命。Brockman 在证词中还提到自己的个人日记,表示公开这些内容令人痛苦,但其中没有任何让他感到羞耻的东西。整体来看,这场决裂被描绘成一次治理权争端,也正是它塑造了 OpenAI 后来的发展方向,并为今天的诉讼埋下伏笔。

Brockman 表示,争议在 OpenAI 的一个模型击败顶级 DOTA II 人类选手后升级,这让团队相信算力才是关键资源,而仅靠非营利募资并不够。他提到当时存在多种方案,包括平等持股、按现金投入分配股权,以及与 Tesla 的 AI 工作建立联系,但最终都因 Musk 要求控制权而破裂。

TechCrunch AI

Match Group在第一季度财报电话会上表示,公司将在今年剩余时间放缓招聘,以支付全公司范围内的AI工具和培训费用。首席财务官Steven Bailey说,公司希望成为“AI原生公司”,并为每位员工提供前沿工具。

这一举措说明,AI采用正在重塑企业预算,更多公司开始把支出从扩充人手转向软件和培训。它也反映出更广泛的企业趋势:公司一边控制成本,一边试图用AI提升生产率。

Match Group第一季度的业绩之所以受到关注,不仅因为Tinder的收入在连续几个季度下滑后略有回升,也因为管理层谈到了AI支出问题。在财报电话会上,首席财务官Steven Bailey表示,公司正在全力推动AI在整个组织内的落地。他说,Match正在让所有员工都能使用先进工具,提供相应培训,并明确公司对工作方式的要求。Bailey还表示,公司希望成为一家AI原生公司。为了支付这些工具的费用,Match决定在今年剩余时间放缓招聘计划。

公司向投资者说明,这一做法在成本上应当是中性的,因为减少的人力支出可以抵消额外的软件开销。Match还认为,员工借助AI提升生产率,最终会帮助收入增长。该表态出现在Match公布第一季度营收864万美元、同比增长4%之后。不过,公司对下一季度的指引偏弱,预计营收约为850万至860万美元,较上年同期下降2%或持平。

Match表示,更高的AI软件成本将通过放缓招聘来抵消,因此整体上对成本影响中性。公司还押注员工使用AI带来的生产率提升最终会推动收入增长。

TechCrunch AI

苹果已同意支付2.5亿美元,以和解一项集体诉讼。该诉讼指控苹果在 iPhone 营销中夸大了 Siri 和 Apple Intelligence 的可用性与功能;根据拟议和解,2024年6月10日至2025年3月29日期间购买 iPhone 15 或 iPhone 16 的符合条件美国用户,每台设备最高可获得95美元。

这项和解为“在 AI 功能尚未成熟时先行宣传”的风险标出了代价,尤其是对苹果这样具有巨大影响力的公司而言。它可能影响消费科技公司未来如何描述未完成的 AI 能力,以及用户如何看待产品承诺。

苹果已同意支付2.5亿美元,以和解一项围绕其在 iPhone 16 发布前如何宣传 AI 功能的集体诉讼。最早报道这一消息的是《金融时报》。诉状称,苹果夸大了 Apple Intelligence 将带来的功能,尤其是一版大幅升级的 Siri,并让人产生先进 AI 能力会比实际更早可用的印象。原告认为,购买 iPhone 15 和 iPhone 16 的用户以为自己是在为当时尚未真正提供的前沿 AI 工具买单。

诉讼将这些说法界定为虚假广告,并认为苹果的营销影响了消费者的购买决定。苹果并未承认有任何不当行为,但选择和解而不是继续在法庭上应诉。根据拟议和解,2024年6月10日至2025年3月29日期间购买 iPhone 15 或 iPhone 16 的符合条件美国用户,每台设备最高可获得95美元。此次和解发生在苹果6月8日年度开发者大会之前,届时公司预计会预览其 AI 增强版 Siri。

这起诉讼称,苹果让外界误以为更先进的 AI 功能,尤其是更强大的 Siri,会比实际情况更早到来。苹果并未承认有不当行为,而和解发生在其6月8日开发者大会之前,届时公司预计会预览 AI 增强版 Siri。

TechCrunch AI

由前 AMD Silo AI 首席执行官 Peter Sarlin 创立的芬兰 AI 实验室 QuTwo,完成了 2500 万欧元的天使轮融资,投后估值达到 3.25 亿欧元。公司表示,这笔资金将用于开发 QuTwo OS,一个面向经典计算、量子计算和混合计算的编排层,并以 AI 为核心。

这轮融资表明,尽管仍处于早期阶段,投资者对 AI、量子计算和欧洲主权科技项目的兴趣依然强劲。它也说明市场正在关注一种新的软件层:它可以在不同计算架构之间调度企业任务,而不必完全依赖量子硬件。

芬兰 AI 实验室 QuTwo 在完成 2500 万欧元天使轮融资后,估值达到 3.25 亿欧元。QuTwo 由 Peter Sarlin 创立,Sarlin 此前曾担任 Silo AI 的首席执行官,而 Silo AI 已在 2024 年被 AMD 以 6.65 亿美元收购。尽管公司名称带有量子计算色彩,Sarlin 表示 QuTwo 本质上是一家 AI 公司。其核心产品 QuTwo OS 被设计为一个编排层,可根据任务把工作分配到经典计算、量子计算或混合计算架构上。

公司认为,许多企业问题最终可能更适合使用“量子启发式”计算,即在更可靠的经典芯片上模拟量子行为。QuTwo 表示,企业 AI 将是其主要业务方向,并且已经通过设计合作获得约 2300 万美元的承诺收入,其中包括与零售巨头 Zalando 合作开发 AI 助手。Sarlin 说,公司没有选择追求那种动辄十亿美元估值的融资路线,因为他希望 QuTwo 具备五到十年的长期视角。他还表示,选择天使轮而不是 VC 或战略投资,可以让公司拥有更大的灵活性,尤其是在欧洲越来越倾向于寻找美国科技供应商本地替代方案的背景下。

QuTwo 将自己定位为一家 AI 公司,而不是纯粹的量子创业公司,Sarlin 也表示“AI 才是北极星”,量子只是新的计算类型。公司已经通过设计合作获得约 2300 万美元的承诺收入,其中包括为 Zalando 开发 AI 助手。

TechCrunch AI

旧金山初创公司 Altara 于 2025 年创立,刚刚完成 700 万美元种子轮融资,计划构建一个 AI 平台,用于整合电池、半导体和医疗设备等领域分散的技术数据。该轮融资由 Greylock 领投,Neo、BoxGroup、Liquid 2 Ventures 和 Jeff Dean 参投。

这笔融资说明投资者正在关注面向工业研发的 AI 基础设施,因为混乱的数据往往会拖慢故障分析和产品迭代。如果 Altara 的方案真的有效,它可以帮助工程师更快定位问题,减少在旧系统和电子表格之间手动检索数据的时间。

Altara 是一家位于旧金山的初创公司,瞄准的是物理科学行业中一个普遍存在的问题:关键技术数据往往散落在电子表格、旧软件和彼此割裂的内部系统里。对于电池、半导体和医疗设备等领域的公司来说,这种碎片化会让故障定位和产品性能改进变得非常困难。Altara 说,它已经构建了一个 AI 层,可以把这些信息整合到一个统一平台中。该公司目前刚刚完成 700 万美元种子轮融资,用于推进这一方向。Greylock 领投了这轮融资,Neo、BoxGroup、Liquid 2 Ventures 和 Jeff Dean 也参与了投资。Altara 成立于 2025 年,由 Eva Tuecke 和 Catherine Yeo 共同创办。Tuecke 以前在 Fermilab 从事粒子物理研究,并曾在 SpaceX 工作;Yeo 则是 Warp 的前 AI 工程师。

两人在哈佛大学学习计算机科学时相识。文中,Yeo 举例说,在电池故障场景下,工程师需要手动查看大量数据源,包括传感器日志、环境数据以及历史故障报告。Altara 声称,其系统可以把这种分析过程从需要数周的人工排查压缩到几分钟。Greylock 合伙人 Corinne Riley 将这类产品类比为软件世界中的可观测性栈,认为它帮助用户判断故障原因,只不过应用对象变成了硬件和科学工作流。Altara 并不是要取代既有的研发和制造企业,而是希望作为一个智能层接入它们现有的数据。相比那些试图从头重塑科学研究流程的公司,Altara 走的是更聚焦、资本消耗更低的路线。

Altara 表示,其 AI 层可以把原本需要数周的人工数据梳理压缩到几分钟,并整合传感器日志、温度数据、湿度数据以及历史故障报告。Greylock 合伙人 Corinne Riley 将其类比为硬件领域对应的软件可观测性与 SRE 工具,同时指出 Altara 的做法是接入现有系统,而不是替换传统研发和制造体系。

The Verge AI

微软将 Teams 调整为向 Ryan Roslansky 汇报,后者已经负责 LinkedIn 和 Office,并将领导一个新的 Work Experiences Group。此次调整是更广泛重组的一部分,源于长期高管 Rajesh Jha 的退休。

这次重组把微软最重要的生产力和协作产品集中到更少的领导者手中,可能影响 Office、Teams、LinkedIn 和 Copilot 未来的协同演进。它也表明,在高层换岗之后,微软正围绕 AI 时代的工作工具重新组织架构。

微软正在重组其 Experiences and Devices 组织的领导层,并继续拆分此前由 Rajesh Jha 负责的职责。Jha 在公司工作超过 35 年后宣布退休,微软一直在尝试重新分配他原先掌管的 Windows、Office、Copilot 和 Microsoft 365 相关团队。根据《The Verge》援引的消息,Teams 将转到 Ryan Roslansky 名下,由他继续兼管 LinkedIn 和 Office,并领导一个新的 Work Experiences Group。这个变化发生在 Roslansky 上周任命 LinkedIn 新任 CEO Daniel Shapero 之后,Shapero 将向他汇报。与此同时,Charles Lamanna 也获得了更大的权责,将领导 Copilot、Agents 和 Platform 团队。

该团队涵盖 Microsoft 365 和 Dynamics 365 服务、BizChat 等产品,并将纳入 Microsoft 365 Core、OneDrive 和 SharePoint,以及 Data Platform and Growth。资深高管 Jeff Teper 和 Kirk Koenigsbauer 也将改为向 Lamanna 汇报。Pavan Davuluri 仍将负责 Windows and Devices Group,不过微软在 2017 年收购的 Intentional 团队将并入他的管理范围。Perry Clarke 则出任 Application Systems 的 CTO,重点关注 Microsoft 365 和 Copilot 的整体系统架构,以及它们如何与模型家族、Azure 云和芯片协同工作。微软表示,新架构本周开始实施,而 Lamanna、Davuluri、Clarke 和 Roslansky 将在 Jha 离职后于 6 月 30 日直接向 Satya Nadella 汇报。

Charles Lamanna 的职责也在扩大,他将领导 Copilot、Agents 和 Platform 团队,其中包括 Microsoft 365 和 Dynamics 365 服务、BizChat、OneDrive、SharePoint 以及 Data Platform and Growth。微软的 Windows and Devices Group 仍由 Pavan Davuluri 负责,新架构本周生效,相关高管将于 6 月 30 日起直接向 Satya Nadella 汇报。

The Verge AI

谷歌 Chrome 正在自动下载一个约 4GB 的本地 Gemini Nano 模型文件,用于某些 AI 功能。用户在启用诈骗检测、写作辅助、自动填充和建议等功能后,会在 Chrome 的系统文件夹中发现一个 weights.bin 文件。

这件事重要,是因为浏览器功能正在悄悄占用大量本地磁盘空间,而用户并未被清楚提示这一代价。它也凸显了本地 AI 处理带来的隐私优势与桌面设备存储负担之间的权衡。

谷歌 Chrome 可能正在比用户预期占用更多存储空间,原因是一份较大的本地 AI 模型文件会被自动下载。在某些情况下,只要启用了特定 AI 功能,浏览器就会在系统文件夹中安装一个 4GB 的 weights.bin 文件。这个文件与谷歌的 Gemini Nano 模型有关,而该模型为 Chrome 的诈骗检测、写作辅助、自动填充和建议等工具提供支持。由于 Gemini Nano 在本地运行,它会把训练参数保存在设备上,而不是从云端模型获取信息。

这样的设计有隐私方面的优势,但也带来了明显的存储成本,而许多用户并没有被清楚告知。发现该文件的用户可以在 Chrome 的 OptGuideOnDeviceModel 目录中找到它,但手动删除并不是长期解决方案,因为只要这些 AI 功能还开启着,Chrome 未来可能会再次下载它。要阻止文件重新出现,用户需要进入“设置 > 系统”并关闭“On-Device AI”选项。谷歌确实说明过 Gemini Nano 的具体大小可能会随着浏览器更新而变化,但这项提示出现在一份较长的内置 AI 功能指南中,而不是在用户启用功能时直接显示。

这个文件与 Gemini Nano 有关,该模型在本地运行,因此会把模型参数存储在设备上,而不是依赖云端推理。Chrome 说明 Gemini Nano 的大小可能会随着浏览器更新而变化,但用户只有在“设置 > 系统”里关闭“On-Device AI”后,才能阻止该文件再次出现。

ZDNET AI

Roku和TCL North America在加州遭到起诉,指控它们推送了有缺陷的软件更新,导致部分电视无法使用。诉状称,受影响的电视可能出现黑屏、陷入启动循环、卡死或反复重启,并点名了自2024年12月16日以来销售的六款Roku/TCL机型。

这件事很重要,因为它涉及固件更新是否会把消费级电视直接变成几乎无法使用的设备,尤其是那些依赖智能电视平台日常观影的家庭。若指控属实,这起案件可能促使厂商在推送更新时更加谨慎,并可能让受影响用户获得赔偿。

ZDNET 报道称,Roku 和 TCL North America 正在加州面临诉讼,原告指控它们推送了有缺陷的软件更新,从而把部分 Roku 电视“刷坏”了。诉状称,一些电视在更新后变得无法使用,表现包括黑屏、启动循环、卡死以及反复重启。原告还表示,即使更换了新机,仍然出现了类似问题。文章指出,这起诉讼覆盖了六款特定机型,且购买时间限定为 2024 年 12 月 16 日至今,分别是 Roku Select Series、Roku Plus Series、TCL 3 Series Roku TV、TCL 4 Series Roku TV、TCL 5 Series Roku TV 和 TCL 6 Series Roku TV。ZDNET 还提到,TopClassActions.com 的评论区里有数十名用户反馈了类似故障。

文章同时引用了 Reddit 上的用户说法,例如 Netflix 会频繁卡死和崩溃、电视会随机关机或重启,以及设备在购买不到一年后就变得太慢而难以使用。另一方面,作者也提到很多用户表示自己五年甚至更久的 Roku 电视仍然正常工作,而且作者本人对家里的 Roku Plus Series 也没有意见。报道写道,Roku 在截稿时尚未回应置评请求。对于拥有上述机型的用户,文章建议先持续关注案件进展,因为目前还无需采取行动,但如果最终达成庭外和解,未来可能有机会提出索赔。

诉讼中具体列出的机型包括 Roku Select Series、Roku Plus Series、TCL 3 Series Roku TV、TCL 4 Series Roku TV、TCL 5 Series Roku TV 和 TCL 6 Series Roku TV。文章还指出,TopClassActions 的评论区和 Reddit 上也有类似投诉,但截至报道时 Roku 尚未回应。