Meta的TRIBE v2模型可预测大脑对感官刺激的反应

The Decoder··作者 Jonathan Kemper

关键信息

TRIBE v2预测的是群体平均脑反应而非个体差异,因此其输出比真实fMRI扫描更少噪声。然而,它受限于fMRI的慢时间分辨率,且仅处理视觉、听觉和语言三种感官模态。

资讯摘要

Meta的FAIR团队发布了TRIBE v2模型,该模型利用fMRI数据预测人类大脑对图像、声音和语言的反应。该模型基于720名受试者的超1000小时数据训练,其准确性优于大多数个体扫描结果——尤其是在高精度数据集(如人类连接组计划)中表现突出。模型首先通过Meta的专用AI模型(Llama 3.2用于文本、Wav2Vec-Bert-2.0用于音频、Video-JEPA-2用于视频)处理输入,再用Transformer融合信息生成包含7万个体素的大脑图谱。

它的预测结果比多数个体扫描更接近群体平均值,从而降低了由心跳或头部移动引起的噪声干扰。更重要的是,TRIBE v2是开源的,研究人员可以免费获取代码、权重和交互式演示。

资讯正文

Meta的新AI模型可预测大脑对图像、声音和语音的反应

关键要点

- Meta的TRIBE v2 AI模型基于fMRI数据训练,能够预测人类大脑对图像、声音和语音的反应,其准确性经常超过单个受试者的实际测量结果。

- 在受控测试中,该模型成功在计算机上复现了神经科学领域已知的重要发现,例如正确识别出专门处理人脸、地点或语言的大脑区域,这可能大幅减少脑科学研究中的昂贵实验室时间。

- 尽管前景广阔,该模型仍存在局限:它将大脑视为被动接收器,仅涵盖三种感官通道,并且受限于fMRI较慢的时间分辨率。Meta已免费提供代码、权重和一个交互式演示。

Meta推出的新AI模型可以预测人类大脑对图像、声音和语音的反应。在测试中,它的预测结果往往比任何单一受试者的扫描更贴近典型的大脑反应。

脑科学研究每次实验都需要重新采集数据,导致研究过程缓慢且成本高昂。Meta FAIR实验室的AI研究人员希望借助一个能预测大脑活动而非直接测量的AI模型,彻底绕过这一瓶颈。

该模型名为TRIBE v2,根据配套论文所述,它使用了来自720名受试者的超过1000小时fMRI数据进行训练。功能性磁共振成像(fMRI)通过追踪血流和氧含量的变化间接测量大脑活动。利用这些数据,TRIBE v2旨在预测大脑对任何视觉、听觉或语言刺激的反应。

三个Meta模型负责预处理

TRIBE v2接受三种输入:视频、音频和文本。每个通道首先经过一个预训练的Meta AI模型处理:文本使用Llama 3.2,音频使用Wav2Vec-Bert-2.0,视频使用Video-JEPA-2。这些模型将原始数据转化为嵌入向量,捕捉图像中的内容、声音中的信息或句子中的语义。

随后,一个Transformer模块将这三种表示一起处理,提取跨不同刺激、任务和人群的共同模式。最后,一个人体特异性层将输出转换为包含7万个体素(voxels)的大脑图谱——这些是构成fMRI扫描的三维像素。

预测结果比实际脑扫描噪声更少

个体fMRI图像本身具有很高的噪声。心跳、头部移动和设备干扰都会扭曲信号。为了确定大脑对特定刺激的典型反应,研究人员必须对多个扫描结果取平均。

TRIBE v2通过直接预测调整后的平均反应来规避这个问题。在测试中,这种预测与实际群体平均值的相关性高于大多数个体受试者的扫描结果。在Human Connectome Project数据集中效果最为显著,该数据集采用7特斯拉扫描仪获取,相比标准的3特斯拉设备提供了更高的信号质量。在此数据集中,TRIBE v2与群体反应的相关性达到了个体受试者中位数的两倍。

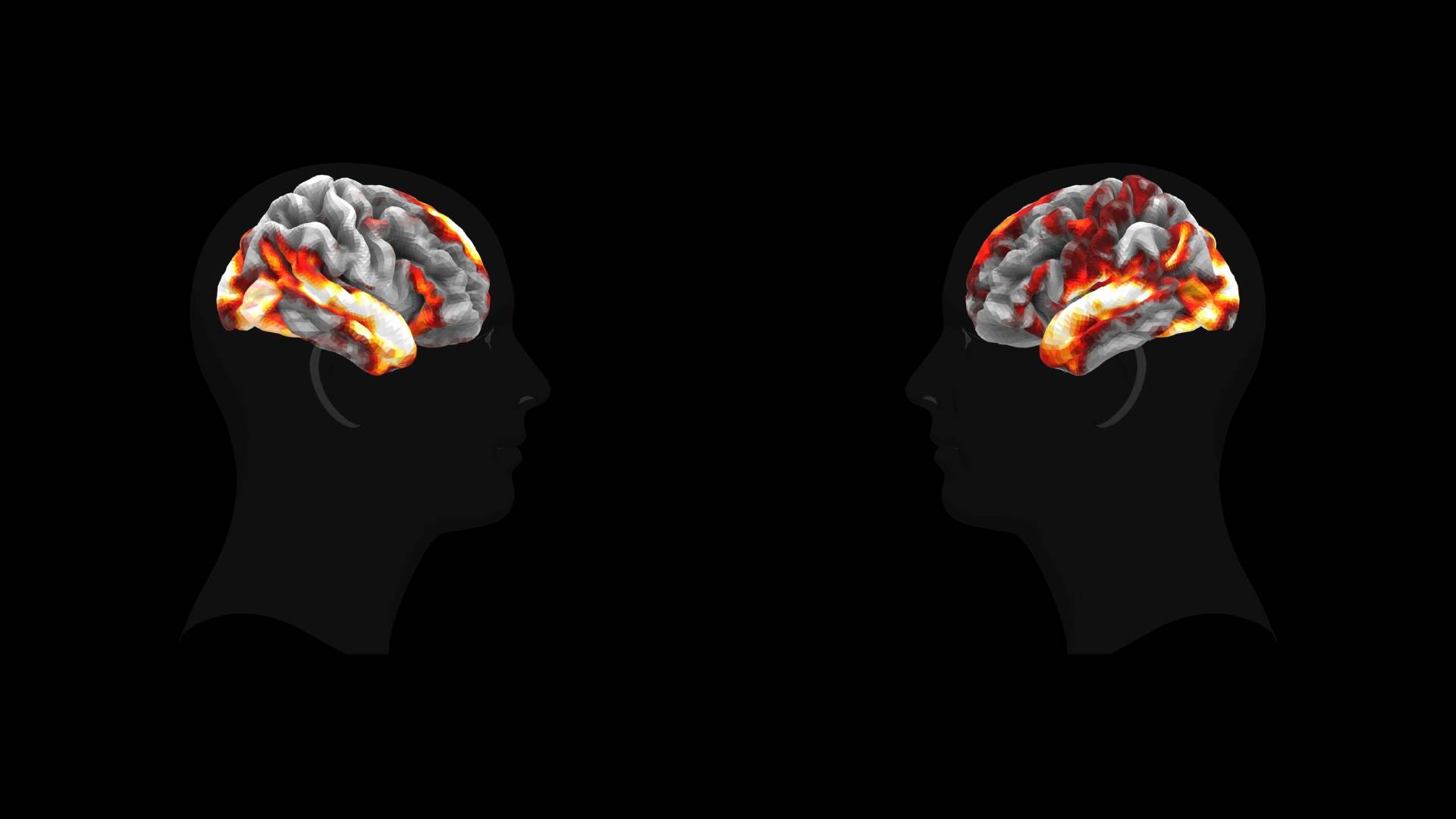

Meta的新AI模型可预测大脑对图像、声音和语言的反应

与此前常用的优化线性模型相比,TRIBE v2在所有数据集上都表现出显著改进,根据论文所述。早期版本TRIBE v1仅基于四位受试者训练,只能预测1000个体素(voxels),而非现在的7万个体素,但仍赢得了Algonauts 2025竞赛,击败了263支其他团队。

TRIBE v2的预测准确率随着训练数据量的增加而稳步提升,尚未达到饱和状态。这表明,随着fMRI数据库的增长,该模型将持续进步——这种趋势与大型语言模型的扩展规律一致,即更多数据能可靠地带来更好的性能。

几十年实验室研究的计算机复现

研究人员用日常刺激测试了TRIBE v2,例如电影和播客,这些刺激同时激活多个感官通道;也使用了经典神经科学中常见的孤立刺激。在后一种受控实验中,屏幕上会短暂呈现单一图像一秒,以测量特定脑区的反应。研究团队采用了Individual Brain Charting数据集中的测试协议,这是一个广受认可的神经科学研究集合,并让模型预测哪些脑区应被激活。

在涉及人脸、场景、身体和角色图像的视觉实验中,TRIBE v2每次都准确识别出已知的专门化脑区。在语言实验中,它定位了语言网络,区分了情绪疼痛与生理疼痛的处理机制,并显示出完整句子比词列表更强烈地激活左半球的现象。

这些结果与数十年来对真实受试者的实证研究发现一致。对于神经科学而言,这意味着未来实验可以在电脑上初步模拟,从而避免昂贵的实验室时间投入。

解析不同感官通道如何激活特定脑区

通过有选择地关闭各个输入通道,TRIBE v2揭示了每种感官对特定脑区活动的影响程度。结果与现有神经科学知识吻合:听觉最能预测听觉皮层附近的活动,视频对应视觉皮层,文本则激活语言区域及额叶部分。

在整合多感官输入的脑区中,同时输入三种通道带来的提升最大。在颞叶、顶叶和枕叶交汇处,预测准确率比单独使用任一通道高出高达50%。

对模型最后一层进行统计分析还发现了五个模式,它们分别对应已知的功能性脑网络:初级听觉皮层、语言网络、运动识别、默认模式网络以及视觉系统。默认模式网络在白日梦和自我反思等状态下活跃。

TRIBE v2的局限性仍然显著。fMRI仅通过血流间接测量大脑活动,存在数秒的延迟。毫秒级神经信号的快速动态变化仍无法捕捉。该模型也仅覆盖三种感官通道——嗅觉、触觉和平衡感均未包含。

更根本的是,TRIBE v2将大脑视为感官输入的被动接收器,未能模拟大脑如何主动做出决策或驱动行为。它也无法捕捉发育变化或临床状况,研究人员表示,这仍是未来版本的重点任务。

Meta认为该模型有三大应用场景:规划神经科学实验、构建更类脑的人工智能架构,以及最终用于诊断脑部疾病。代码、模型权重和一个交互式演示均已公开可用。

Meta的人工智能研究实验室FAIR多年来一直致力于大脑与人工智能交叉领域的研究。去年,该团队展示了仅通过非侵入性脑扫描,AI模型就能以高达80%的准确率重建打字句子。

无炒作的AI新闻——由人类精选

来源与参考

收录于 2026-03-28