通义千问Qwen3.5-Omni无需训练即可从语音和视频中编写代码

The Decoder··作者 Jonathan Kemper

关键信息

该模型基于超过一亿小时的音视频数据原生预训练,采用混合注意力-专家混合(MoE)架构,并引入ARIA(自适应速率交错对齐)技术以提升实时语音合成质量。代码生成能力是在训练扩展过程中自然涌现的‘新兴能力’。

资讯摘要

阿里巴巴发布了Qwen3.5-Omni,这是一个能处理文本、图像、音频和视频的多模态AI模型。它支持高达256,000个token的上下文长度,可处理超过10小时音频或400秒720p视频。最令人惊讶的是,该模型在大规模多模态训练中意外获得了从语音指令和视频片段中编写功能代码的能力——而这种能力从未被专门训练过。

团队称其为“音视频氛围编码”(audio-visual vibe coding)。此外,模型还能从媒体中生成带时间戳、角色描述和声音提示的详细脚本。新推出的ARIA机制通过动态同步文本和音频标记改善了实时语音输出质量。

资讯正文

Qwen3.5-Omni通过语音指令和视频学习编写代码,而无需任何人对其进行专门训练

要点

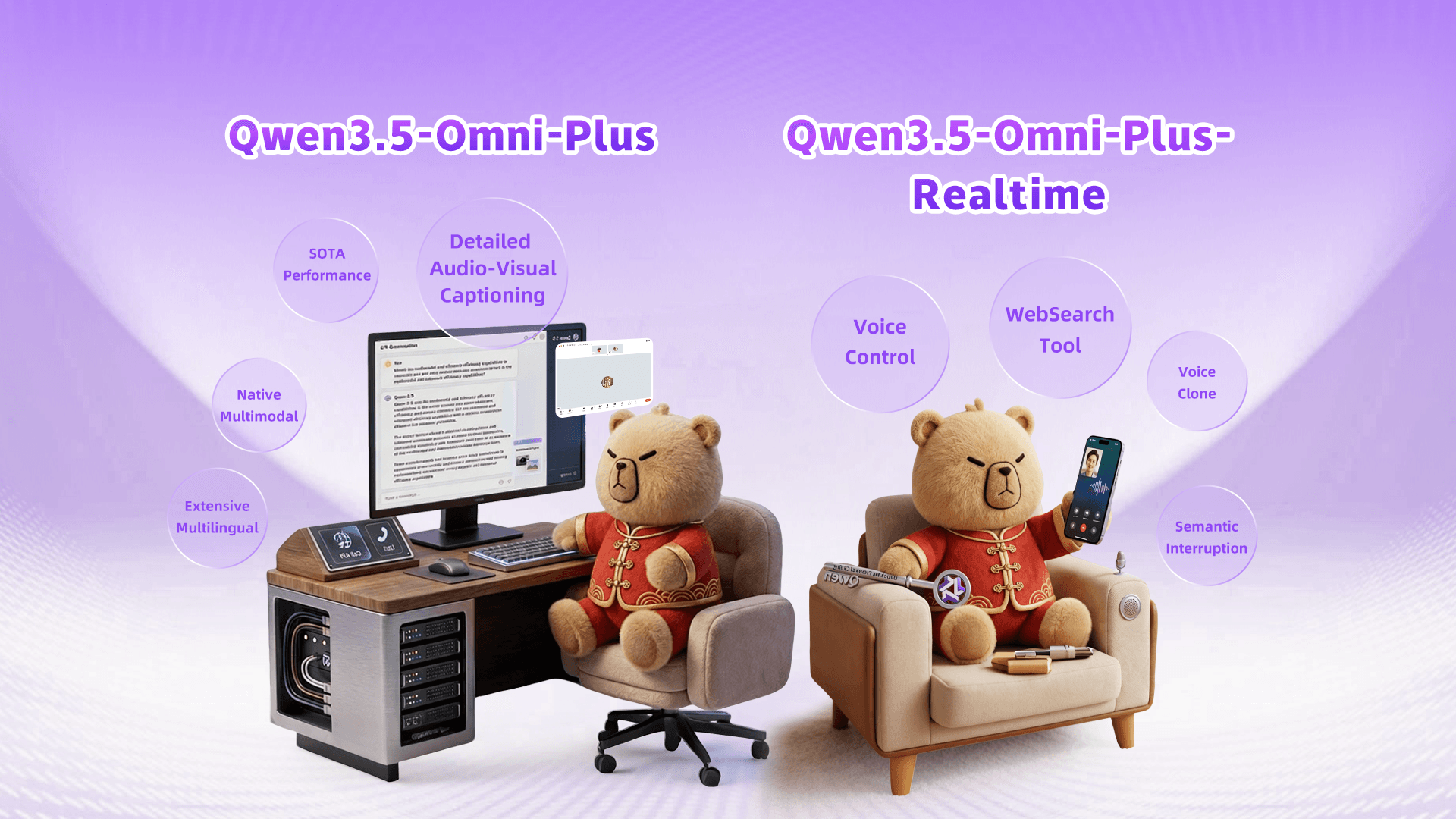

- 阿里巴巴发布了Qwen3.5-Omni,这是一个多模态AI模型,能够处理文本、图像、音频和视频,提供三种不同版本。

- 该模型在音频任务上表现优于谷歌的Gemini 3.1 Pro,语音识别现已支持74种语言,远超前代产品仅支持的11种语言。

- 与以往Qwen版本不同的是,阿里巴巴并未公开模型权重;Qwen3.5-Omni目前仅作为API服务提供。

阿里巴巴发布了Qwen3.5-Omni,这是一个可处理文本、图像、音频和视频的多模态AI模型。据称它在音频任务上超越了Gemini 3.1 Pro,并意外掌握了一项新技能:根据语音指令和视频输入编写代码。

阿里最新一代Qwen系列包含三个Instruct变体(Plus、Flash和Light),支持最多256,000个标记的上下文长度。根据Qwen团队的说法,该模型能一次性处理超过十小时的音频以及超过400秒的720p视频(每秒一帧)。该模型基于超过1亿小时的音视频材料进行原生多模态预训练,并能生成语音输出。

Qwen3.5-Omni-Plus在215项音频基准测试中达到顶尖水平

Qwen团队表示,Plus版本在215项音频及音视频子任务中创下新纪录,涵盖三项音视频基准测试、五项音频基准测试、八项语音识别基准测试、156项特定语言翻译任务和43项特定语言识别任务。Qwen3.5-Omni-Plus reportedly 在整体音频理解、推理、识别、翻译和对话方面胜过谷歌的Gemini 3.1 Pro。在音视频综合理解方面,它与Gemini 3.1 Pro持平。

语音识别语言数量从11种跃升至74种

Qwen团队大幅扩展了前代产品Qwen3-Omni的语言支持范围。语音识别现在覆盖74种语言和39种中文方言,总计113种语言和方言。此前版本仅支持11种语言和8种中文方言。语音输出支持36种语言和方言,提供55种声音选项,包括用户自定义、场景定制、方言及多语言选择。

ARIA架构解决了实时语音输出中的顽固问题

该架构仍采用“思考者-说话者”设计:思考者分析多模态输入并生成文本,说话者将文本转化为情境化语音。两个组件现在均运行于混合注意力-MoE架构之上,取代了前代纯专家混合设置。

最大的技术升级是ARIA(自适应速率交错对齐)。它能动态地对齐和交错文本与语音标记。Qwen团队开发这项技术是为了修复实时语音输出中的一个众所周知的问题:文本和语音标记的编码速率不同,导致流式对话中经常出现漏词、发音错误或数字混乱。ARIA旨在提升语音合成的自然度和鲁棒性,同时不牺牲实时性能。其前身使用的是文本与音频标记之间固定的1:1映射。

“视听氛围编码”作为一种新兴能力浮现出来

据Qwen团队称,在扩大多模态训练规模的过程中,一种意外的能力出现了:模型可以直接从口头指令和视频内容中编写代码,团队将这种能力称为“视听氛围编码”。这项技能并非特意训练所得,而是多模态扩展的自然副产品。在演示中,Qwen3.5-Omni-Plus仅凭一段口头描述和一个视频片段就能构建出一个可运行的贪吃蛇游戏。

该模型还能以足够详细的程度描述音频和视频内容,使输出读起来像脚本一样。它会自动分段,添加精确到秒的时间戳,并提供关于角色、对话、音效及其互动关系的细致信息。在一个演示中,模型按场景拆解了一段三分钟的狮子纪录片,指出每个说话者、每次剪辑和每种声音;另一个案例则展示了它如何识别电子游戏中暴力场景用于内容审核,并以表格形式列出时间戳和风险等级。

实时对话变得更智能,支持即时中断和实时网页搜索

对于实时对话,Qwen3.5-Omni新增了多个前代版本不具备的功能。“语义打断”功能可以判断用户是否真的想发言,从而忽略背景噪音或短暂插话。模型能自主决定是否针对当前问题执行网络搜索,并能处理复杂的函数调用。

用户还可以通过语音命令调整模型的说话方式,包括音量、语速和情感等参数,且可在对话过程中随时调节。语音克隆功能允许用户上传自己的声音并将其设为AI助手的声音。Qwen团队表示,所有这些特性都可通过实时API实现。

该模型也可通过Qwen Chat和阿里云Model Studio访问。与此前发布的Qwen3-Omni及Qwen3.5文本模型不同,阿里尚未公布Qwen3.5-Omni的模型权重,也未明确许可证类型。目前,Qwen3.5-Omni仅作为API服务提供。

发布之际正值团队动荡与快速模型迭代

阿里巴巴正以极快的速度推出新模型。公司仅在2025年4月发布了Qwen3.5-Omni的前代产品Qwen3-Omni,这款拥有300亿参数的模型在36项音视频基准测试中取得了32项第一的成绩,并能在211毫秒内响应纯音频输入。此后,阿里巴巴还进一步扩展了Qwen 3.5文本模型系列,推出了四款型号,其中旗舰版Qwen3.5-397B-A17B采用混合专家架构,总参数达3970亿,活跃参数为170亿。

但这一进展发生在复杂的时间点。阿里巴巴首席AI开发者林俊阳——整个Qwen系列的核心推动者——最近宣布意外离职。其他关键团队成员也相继离开,包括Qwen代码编写、后训练以及Qwen 3.5/VL项目的负责人。

据报道,这些人员的离职是由一次内部重组引发的,该重组计划让一位来自谷歌Gemini团队的研究员担任领导职务。对此,阿里巴巴CEO吴泳铭宣布成立一个新的“基础模型任务组”,强调基础模型开发仍是公司未来的“核心战略优先事项”。

AI新闻去 hype——由人类精选

来源与参考

收录于 2026-04-01