谷歌TurboQuant算法将大语言模型内存减少6倍且不损失质量

Ars Technica AI··作者 Ryan Whitwam

关键信息

TurboQuant通过两个阶段压缩KV缓存:首先使用PolarQuant将向量对映射为极坐标(半径和角度),然后进行量化处理——无需重新训练或微调模型。

资讯摘要

大语言模型因键值缓存占用大量内存,该缓存存储中间注意力计算结果。谷歌的TurboQuant算法通过高效压缩这一缓存来解决瓶颈问题。它采用两步流程:首先用PolarQuant将高维向量映射为极坐标(半径和角度)以减少冗余,再进行精度降低处理,且不影响准确率。

早期测试显示其在Gemma和Mistral等模型上实现最高6倍内存节省和8倍推理加速。关键在于它是后处理步骤,无需重新训练模型,因此可立即应用于现有开源大语言模型。

资讯正文

谷歌的TurboQuant AI压缩算法可将大语言模型内存使用量降低6倍

即使你不太了解生成式AI模型的内部机制,你也应该知道它们需要大量内存。因此,现在几乎不可能以合理价格买到一块普通的内存条。

谷歌研究团队最近发布了名为TurboQuant的压缩算法,该算法能在不牺牲准确性的前提下,减少大型语言模型(LLMs)的内存占用,并提升运行速度。

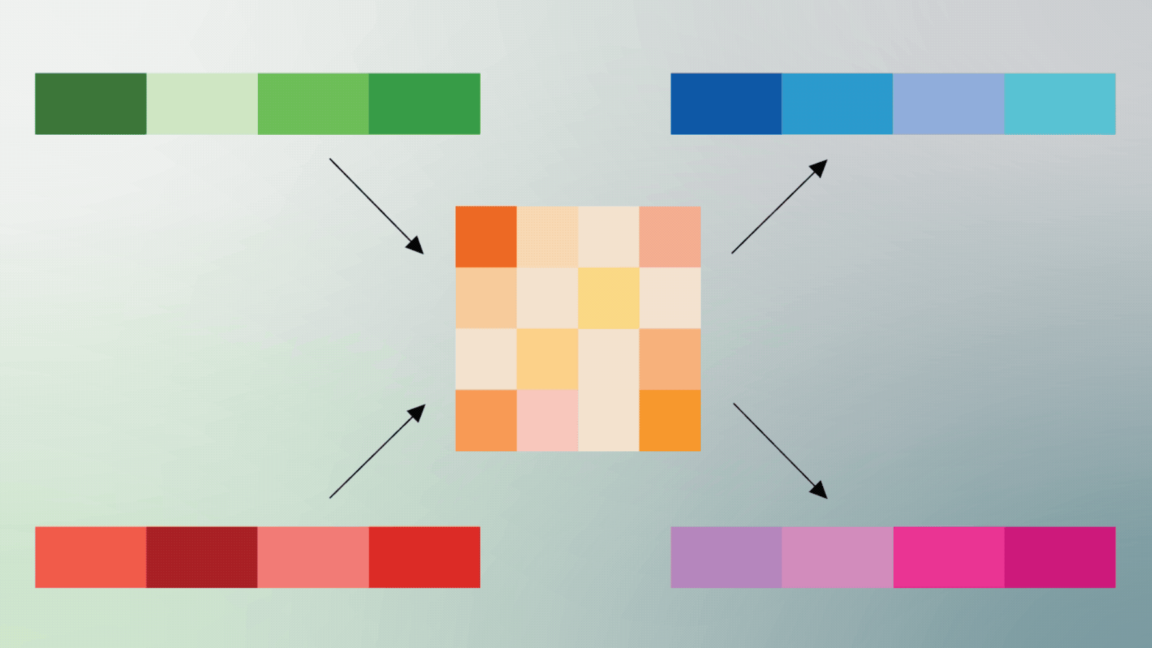

TurboQuant旨在缩小关键值缓存的大小,谷歌将其比作一张‘数字速记表’,用于存储重要信息,避免重复计算。这张速记表之所以必要,是因为我们常说的那样:大语言模型其实并不真正‘知道’任何东西;它们通过向量来模拟知识,这些向量可以映射标记化文本的语义含义。当两个向量相似时,意味着它们具有概念上的相似性。

高维向量可能包含数百甚至数千个嵌入项,能够描述图像像素或大规模数据集等复杂信息,但同时也占据大量内存,导致关键值缓存膨胀,成为性能瓶颈。为了使模型更小、更高效,开发者通常采用量化技术,让模型在更低精度下运行。缺点是输出质量下降——词元估计的准确性降低。

而使用TurboQuant后,谷歌早期测试结果显示,在某些场景下实现了8倍性能提升和6倍内存使用量减少,且未造成质量损失。

来源与参考