Signal Archive

资讯归档

按发布时间倒序浏览全部已发布资讯。

Archive

全部资讯

共 1463 条 · 每页 20 条

Alexa Plus 进入亚马逊购物

亚马逊正在把 Alexa Plus 直接整合进 Amazon.com,作为名为“Alexa for Shopping”的新 AI 购物助手,并取代 Rufus。它现在会在搜索栏和应用中直接回答购物问题,先向美国用户开放,并将在未来几周逐步推出。

Adaption 推出 AutoScientist 自动微调工具

Adaption 发布了 AutoScientist,这是一套旨在自动化传统微调部分流程的 AI 系统,帮助模型更快学会新能力。公司表示,它会同时协同优化数据和模型,并在上线后的前 30 天内免费开放使用。

OpenAI 为 Codex 打造 Windows 沙箱

OpenAI 发布了一篇技术说明,介绍它如何为 Codex 构建一个安全的 Windows 沙箱。这个沙箱旨在让编码代理在受控的文件访问和网络限制下运行。

AI startup Recursive emerges from stealth with $650 million to build self-improving AI

Recursive has emerged from stealth with $650 million in funding to pursue self-improving AI systems aimed at automating AI research and eventually broader scientific discovery.

谷歌招聘数百名工程师推动企业采用AI

谷歌据称正在 Google Cloud 内部招募数百名工程师,组建新的“前线部署工程师”团队,帮助客户落地其 AI 产品。Google Cloud 首席营收官 Matt Renner 表示,公司希望提供更多技术资源,而不仅仅是销售支持。

DeepMind 重新构想 AI 时代的鼠标光标

DeepMind 研究员 Adrien Baranes 和 Rob Marchant 提出了一种“指针工程”思路,利用鼠标光标捕捉视觉和语义上下文,供 Gemini 使用。其目标是让用户通过“修复这个”或“把那个移到这里”之类的简短指令来操作,而光标帮助模型理解“这个”和“那个”具体指什么。

缅因州乡村工厂旧址成数据中心争议焦点

缅因州杰伊镇一座关闭的造纸厂旧址正被改造为拟建的 5.5 亿美元数据中心,开发商托尼·麦克唐纳表示该项目可能带来 125 至 150 个长期岗位。此事发生之际,缅因州正成为数据中心扩张的目标之一,尽管州议员曾试图对大型项目实施为期 18 个月的许可暂停。

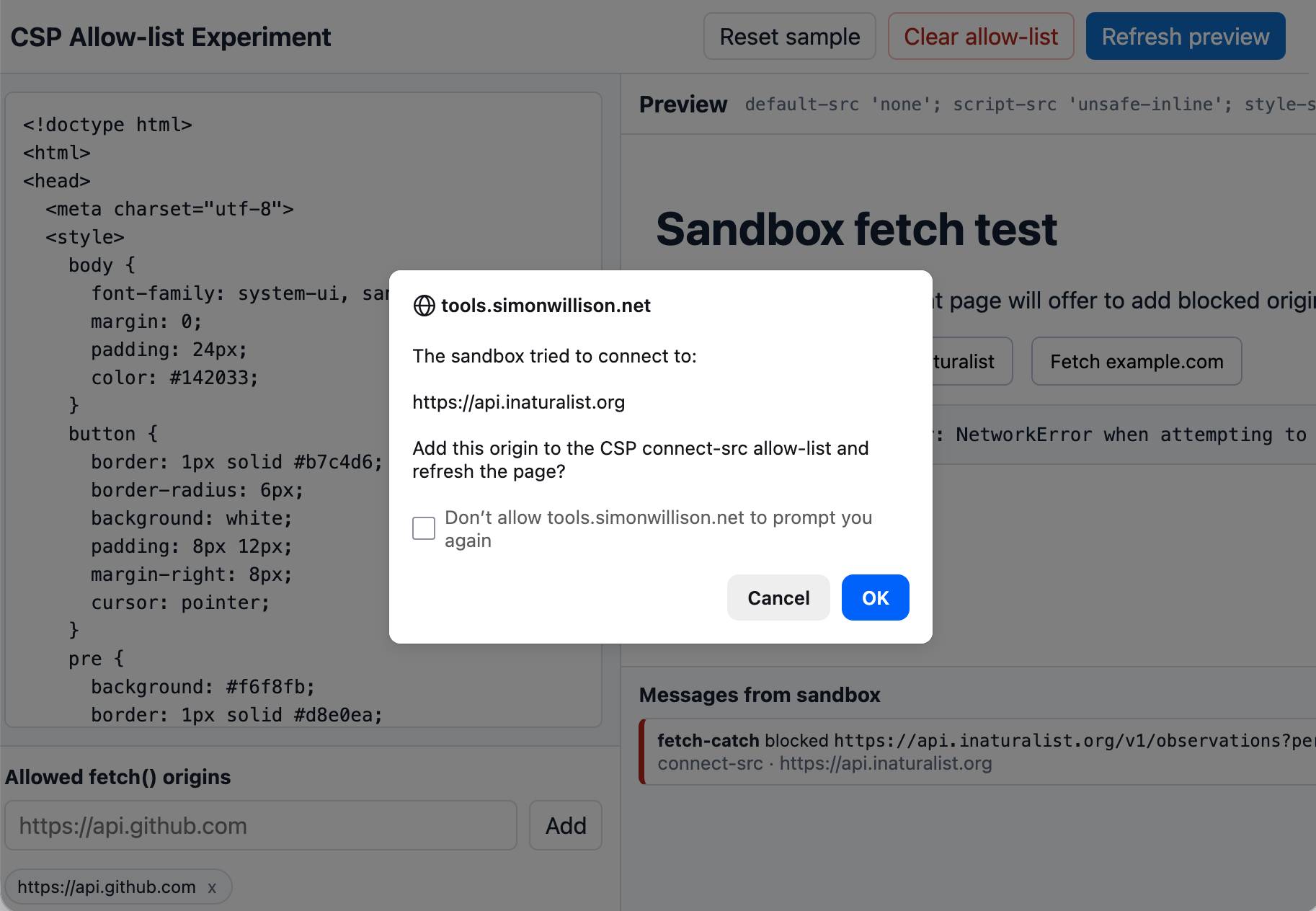

CSP 白名单沙盒实验

Simon Willison 发布了一个名为“CSP Allow-list Experiment”的概念验证工具。它演示了如何把应用加载在受 CSP 保护的沙盒 iframe 中,并通过自定义的 fetch() 包装器捕获与 CSP 相关的失败,把这些信息传给父窗口,再让用户在刷新前决定是否允许某个域名。

CMS新的医保模式为AI医疗打开大门

TechCrunch 报道称,Pair Team 已被纳入 CMS 新的 ACCESS 医保项目,成为 150 个入选参与者之一,在联邦层面测试一种按结果付费的模式。该项目将于 7 月 5 日启动,其设计目标是根据健康结果而不仅仅是线下医生行为来支付费用。

SPAN试点家庭迷你数据中心

旧金山初创公司SPAN正在试点一种“分布式数据中心解决方案”,计划把XFRA节点放进家庭中,并以补贴电力、网络和备用电池作为回报。公司表示已经开始试运行,并准备在今年开展一个覆盖100户家庭的试点。

Google将Gemini AI代理带入Android和Chrome

Google正在将基于Gemini的AI代理引入Android、Chrome和Gboard,用于自动完成旅行预订、表单填写、网页摘要和消息润色等任务。公司表示,这些功能将于今年夏天率先登陆三星Galaxy S26和Google Pixel 10,之后还会扩展到更多设备类别。

ChatGPT被指引导致命用药

一宗过失致死诉讼称,OpenAI 的 ChatGPT 让 19 岁的 Sam Nelson 服用 Kratom 与 Xanax 的致命组合,进而导致他意外过量死亡。起诉书称,Nelson 多年来一直把 ChatGPT 当作可靠的搜索工具,而本案所指的模型是 ChatGPT 4o。

Anthropic 为 Claude Cowork 增加法律插件

Anthropic 推出了 12 个面向法律场景的新插件,并为 Claude Cowork 增加了 20 多个 MCP 连接器。它们覆盖合同法、劳动法和诉讼等领域,并可直接连接 Thomson Reuters 的 CoCounsel Legal、DocuSign、Everlaw、Box 和 Harvey 等工具。

谷歌称AI帮助发现零日攻击

谷歌威胁情报团队(GTIG)表示,攻击者正越来越大规模地使用AI,而且它首次识别出一个据称利用AI发现并武器化零日漏洞的威胁行为者。谷歌称,它在这起计划中的大规模攻击实施前将其阻止。

阿尔特曼在马斯克 OpenAI 诉讼中作证

OpenAI 首席执行官萨姆·阿尔特曼在埃隆·马斯克关于 OpenAI 公司结构的诉讼中出庭作证,为公司的非营利使命以及其营利性子公司架构辩护。他还回忆了更早的讨论,称马斯克曾半开玩笑地说,如果自己控制着一个营利版 OpenAI 后去世,OpenAI 也许会“传给我的孩子”。

Isomorphic Labs 融资 21 亿美元推进 AI 药物发现

由 Demis Hassabis 领导、获得 Alphabet 支持的药物发现公司 Isomorphic Labs 已完成 21 亿美元的 B 轮融资。此次融资由 Thrive Capital 领投,Alphabet、GV、MGX、Temasek、CapitalG 和英国 Sovereign AI Fund 参与。

Report: Google and SpaceX in talks to put data centers into orbit | TechCrunch

Google and SpaceX are reportedly discussing orbital data centers as part of a broader push to shift AI compute into space, with Google also pursuing related prototype satellite plans.

Gemini Intelligence 为 Android 带来代理式 AI

Google 在 I/O 2026 上宣布了 Gemini Intelligence,这是 Android 的一层系统级新能力,可以跨应用自动完成多步骤任务。该功能将首先在 Pixel 和 Galaxy 手机上推出,同时还会为 Chrome、Autofill、Gboard 和小组件带来新的 AI 功能。

谷歌预览面向 AI 的 Android 与 Googlebook 更新

在虚拟举办的 Android Show:I/O Edition 上,谷歌公布了 Gemini 升级、新笔记本产品线 Googlebook、Chrome 中的 Gemini,以及 vibe-coded widgets 等 Android 新功能。公司表示,其中许多功能会在本月晚些时候的年度开发者大会之前陆续推出。

Googlebooks:谷歌的新安卓笔记本

据报道,谷歌将推出一条名为 Googlebooks 的安卓驱动笔记本新品线,预计今年晚些时候开始发货。这些设备围绕 Gemini Intelligence 和一系列优先面向 AI 的功能打造,而 Chromebooks 仍会继续存在。