AI模型在没有人类设计的构建模块时难以控制机器人,但代理支架能缩小差距

The Decoder··作者 Maximilian Schreiner

关键信息

该研究测试了包括GPT-5.2和Gemini-3-Pro在内的12种模型,在7个操作任务上进行评估;直接输入原始摄像头图像会降低性能,而视觉差异模块通过每步后提供结构化的文本反馈来提升表现。

资讯摘要

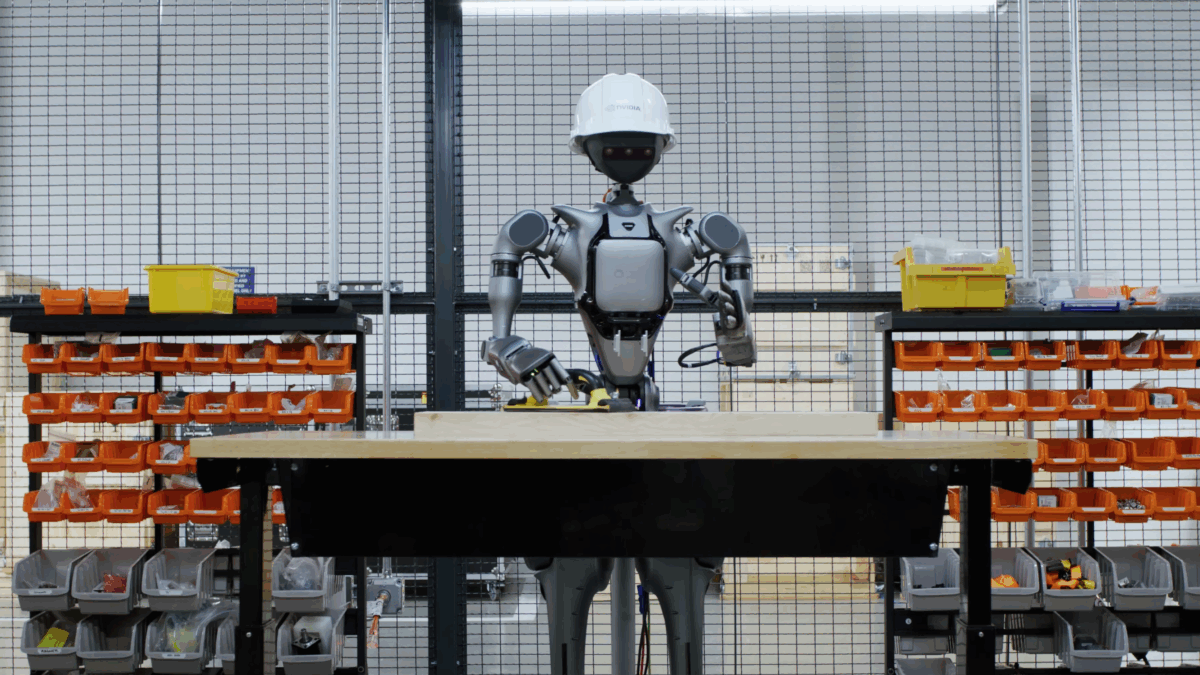

英伟达、加州大学伯克利分校、斯坦福大学和卡内基梅隆大学的研究人员开发了CaP-X框架,用于评估AI代理编写机器人控制代码的能力。他们发现,如果没有人类设计的构建块(如预定义函数“抓取物体X”),即使是顶级模型(如GPT-5.2和Claude Opus 4.5)也会严重失败。

关键洞察是,添加代理支架——如并行代码生成、自动函数库和视觉差异模块——可以让一个无需训练的代理(CaP-Agent0)达到人类级别的可靠性。这种方法通过使用场景变化的结构化文本描述指导下一步动作,优于直接图像输入和控制台输出。

资讯正文

AI模型在机器人控制中缺乏人类设计的构建模块时表现不佳,但代理式支撑结构可缩小差距

Nvidia、加州大学伯克利分校和斯坦福大学提出的新框架系统性测试了AI模型通过代码控制机器人的能力。研究发现:如果没有人类设计的抽象结构,即使是顶级模型也会失败,但像针对性测试时计算资源扩展这样的方法可以缩小差距。

来自Nvidia、加州大学伯克利分校、斯坦福大学和卡内基梅隆大学的研究人员发布了CaP-X,这是一个开放获取的框架,用于系统评估AI编程代理通过自编程序控制机器人的情况。核心结论是:在测试的十二个前沿模型中,没有一个能在单次尝试中达到人类编写程序的可靠性水平。

该论文的核心思想很简单:与其在大规模运动数据集上训练专用机器人模型,不如使用通用语言模型编写控制代码。为了让这一方法奏效,研究人员借鉴了已在语言模型中证明有效的技术,并将其应用于机器人领域——包括基于物理模拟的可验证奖励强化学习、通过并行生成和自我修正实现的测试时计算扩展,以及类似软件工程代理已采用的代理模式,如自动调试和积累可复用函数。

团队测试了包括Gemini-3-Pro、GPT-5.2、Claude Opus 4.5以及Qwen3-235B和DeepSeek-V3.1等开源模型在内的多种模型,在七个操作任务中进行评估,从简单的立方体抓取到双手协调操作不等。

性能差异极大,取决于模型能否访问特定的构建模块。当提供预构建命令(如“抓取物体X并举起它”)时,它们只需排列正确的顺序即可。但一旦这些便利功能被底层低级步骤取代——图像分割、深度处理、抓取规划和逆运动学——成功率会急剧下降。此时,模型必须正确组合数十行代码,而过去仅需一个函数调用就能完成。

直接将摄像头图像输入模型会损害性能

有趣的是,直接将原始摄像头图像输入模型上下文反而使结果更差。研究人员推测这是跨模态对齐存在差距所致——基础模型很少同时训练去推理软件代码和物理机器人执行之间的关系。

更好的做法是一种中间的“视觉差异模块”。一个独立的视觉-语言模型首先以文本形式描述场景,提取与任务相关的属性;每次执行步骤后,报告图像中发生了哪些变化以及任务是否完成。这种结构化的文本随后成为编码代理生成下一轮代码的基础。这种方法始终优于直接输出控制台信息或直接输入图像的方式。

基于这些发现,研究人员开发了CaP-Agent0,这是一个无需训练的系统,包含三个核心组件。首先,是上述的视觉差分模块,它在每一步之后提供文本状态报告。其次,是一个自动生成的功能库:系统会从成功运行中收集辅助函数,比如坐标变换或抓取姿态过滤,并将其用于未来的任务。第三,是并行代码生成:同时生成九个解决方案候选,这些候选可以来自单一模型在不同温度下的输出,也可以分布在Gemini-3-Pro、GPT-5.2和Claude Opus 4.5之间。随后,一个监督代理将这些候选方案整合成最终解决方案。

其中一些想法源自Voyager,这是由共同作者Jim Fan团队开发的一款Minecraft智能体。Jim Fan是Nvidia机器人部门负责人,也是该公司GEAR实验室的联合负责人,该实验室还负责Nvidia的Gr00t模型。

该模型能自动将高层任务(如乘坐电梯下楼)拆解为子任务(如按下按钮、放下手臂、驶入电梯),并利用编程和数学工具执行按钮按压操作。| 视频:https://capgym.github.io/

尽管完全依赖低层构建模块,CaP-Agent0在七个任务中有四个的表现达到或超过人工编写的代码。研究人员还将该系统与经过训练的视觉-语言-动作模型(VLAs)进行了对比测试,后者通过从大规模演示数据集中学习运动模式来控制机器人,而非编写代码。在LIBERO-PRO基准测试中,该测试评估对象位置变化和指令重述的任务,CaP-Agent0在位置变化方面的表现与Physical Intelligence的VLA模型pi0.5相当。

研究团队表示,当任务描述被重新表述时,CaP-Agent0表现出显著更强的鲁棒性,因为它直接解析指令,而不是依赖特定的训练分布。

强化学习让小模型获得显著提升

除了无需训练的CaP-Agent0之外,该框架还引入了CaP-RL方法,通过强化学习提升语言模型在机器人控制中的表现。该模型使用物理模拟中的奖励信号进行训练:当生成的代码产生成功的机器人动作时,模型会获得正向反馈。

通过这种方式训练的一个Qwen2.5-Coder-7B模型,在立方体堆叠任务上的成功率从4%提升至44%(仿真环境)。在真实的Franka机器人上,同一模型无需任何额外微调即可达到76%的成功率,因为其优化的是抽象编程接口,而非摄像头图像。因此,仿真与现实之间的视觉差距几乎不再构成问题。

该团队提出了一种混合系统:编码代理负责高层任务逻辑和故障恢复,而专门的视觉-语言-动作策略则处理精细的运动控制。完整的CaP-X框架——包括CaP-Gym、CaP-Bench、CaP-Agent0和CaP-RL——作为一个开放获取平台供研究社区使用。

AI新闻去伪存真——由人类精选

作为THE DECODER的订阅者,您将获得无广告阅读、每周AI通讯、独家《AI雷达》前沿报告(每年6次)、评论访问权限以及我们的完整档案库。

来源与参考

收录于 2026-04-03