波士顿动力机器人狗现用谷歌Gemini AI读取仪表

Ars Technica AI··作者 Jeremy Hsu

关键信息

该模型在没有代理视觉时准确率达86%,启用后可达93%;它利用多视角推理和视觉画板来解读压力表和观察窗等复杂仪器。

资讯摘要

波士顿动力的Spot机器人狗已通过谷歌DeepMind的Gemini Robotics-ER 1.6人工智能模型升级,可在工业环境中准确读取模拟仪表和温度计。该模型支持“代理视觉”,将图像理解与代码执行结合,创建用于分析的视觉画板。这使得机器人能够解读仪表上的多个指针、刻度、液位和文字——这些都需要复杂的视觉推理能力。

即使不启用代理视觉,该模型也能达到86%的准确率,显示出强大的基础性能。启用代理视觉后,准确率提升至93%。波士顿动力与谷歌DeepMind的合作旨在将更安全、更强大的机器人系统引入工厂,例如现代汽车集团拥有的工厂,Spot正在那里被测试为自动巡检员。

资讯正文

波士顿动力公司的机器人狗现在能用谷歌的AI读取仪表和温度计。

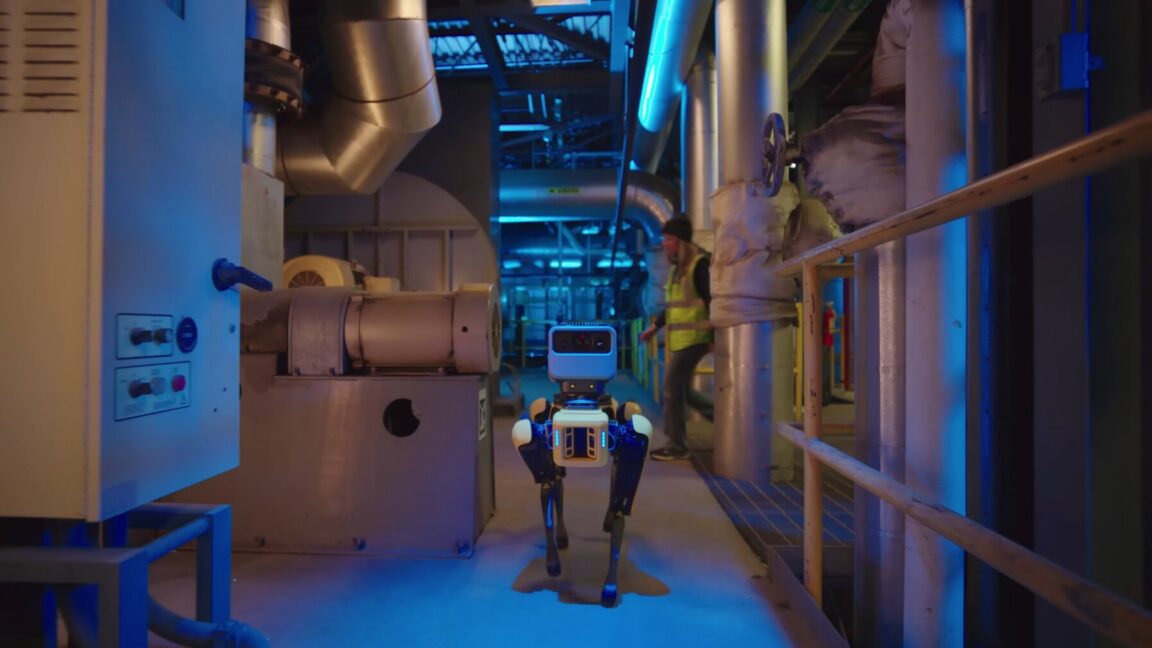

像波士顿动力公司四足机器人Spot这样的设备,如今可以在工厂和仓库中巡逻时准确读取模拟温度计和压力表。这些改进得益于谷歌DeepMind最新推出的机器人AI模型,该模型旨在提升机器人在与物理环境互动时的“具身推理”能力。

谷歌DeepMind于4月14日宣布了新的Gemini Robotics-ER 1.6模型,称其为“机器人的高级推理模型”,能够规划并执行任务。该模型还解锁了准确读取复杂仪表、通过观察窗(sight glasses)进行视觉检查的能力——观察窗提供透明窗口以查看储罐和管道内部情况。这一性能提升源于谷歌DeepMind与机器人公司波士顿动力长期合作的结果。

波士顿动力公司对在各类工业设施中测试四足和人形机器人作业员兴趣浓厚,包括其母公司现代汽车集团旗下的汽车工厂。该公司的人形机器人“狗”Spot正在作为巡检机器人进行试验,它会在工业设施内游走,检查一切细节。这类巡检任务需要“复杂的视觉推理”,以解读各种仪器上的多个指针、液位、容器边界、刻度标记以及文字信息。

驱动它的模型

为了完成此类任务,Gemini Robotics-ER 1.6模型为机器人提供了“代理视觉”功能,将视觉推理与执行代码的能力相结合,创建一个用于检查和操作图像的“视觉草稿板”。这种代理视觉早在2026年1月谷歌发布的Gemini 3.0 Flash模型中就已经引入。

即使不使用代理视觉,基础版的Gemini Robotics-ER 1.6模型仍能达到86%的仪表读取准确率。这是因为该模型采用一种指向图像中不同元素的方法来处理复杂任务,例如计数物品或识别最显著的特征。此外,该模型还声称提升了“多视角推理”能力,使机器人系统能够利用多个摄像头画面更好地理解自身环境。

来源与参考

收录于 2026-04-16