英伟达Lyra 2.0提升机器人仿真能力,实现大规模3D场景生成

The Decoder··作者 Maximilian Schreiner

关键信息

Lyra 2.0会存储每帧的3D几何信息,并在重新访问区域时作为参考;同时通过训练识别自身错误输出来减少漂移,且在基准测试中击败了六种竞争对手方法。

资讯摘要

英伟达推出的Lyra 2.0是一种新的人工智能系统,仅需一张照片即可生成大尺度、连贯的3D场景,使机器人可在模拟环境中训练。它解决了现有模型的两大缺陷:忘记先前看到的区域以及随时间积累错误。通过为每帧存储3D几何信息并在摄像头返回到之前位置时使用该信息作为空间锚点,Lyra 2.0确保即使回到早期区域也能保持一致性。

此外,该系统还专门针对自身质量损失进行训练,以防止长时间视频生成中的漂移现象。基准测试显示,Lyra 2.0在图像质量、风格一致性和摄像机控制方面优于GEN3C、Yume-1.5等六种其他方法。生成的场景可导出至Isaac Sim等物理引擎用于机器人仿真,但目前仅支持静态场景。

资讯正文

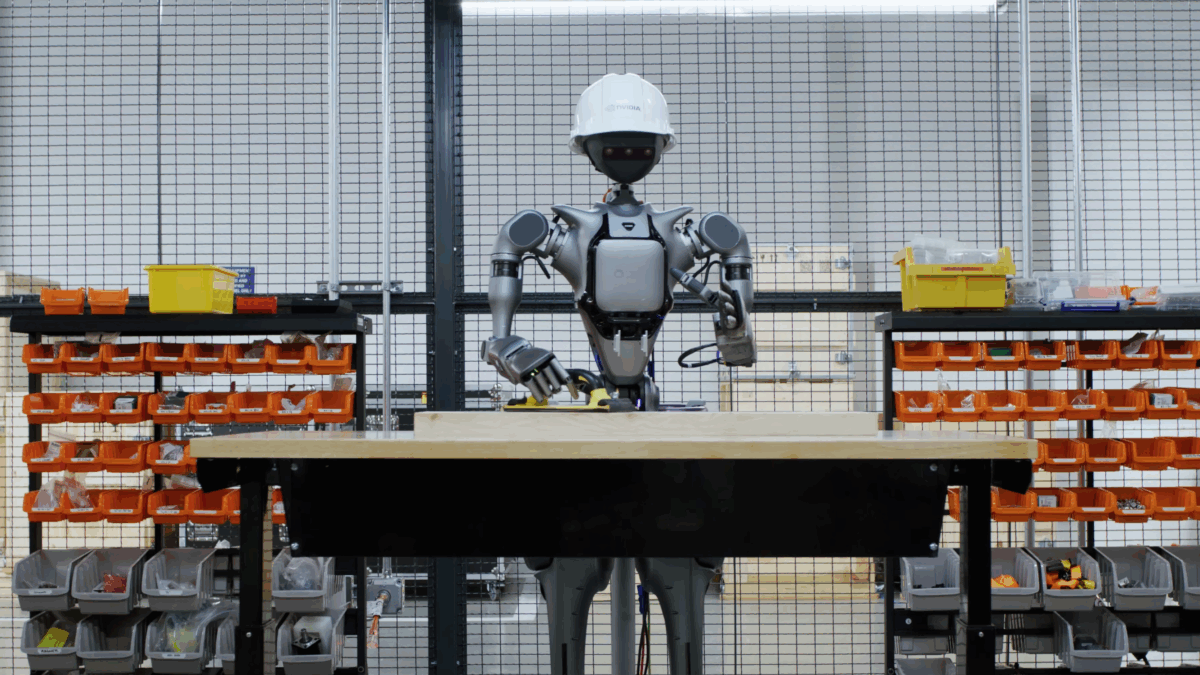

Nvidia希望借助Lyra 2.0扩大机器人模拟训练规模

关键要点

- Nvidia研究人员推出了Lyra 2.0,该系统能从一张照片生成连贯的3D环境,扩展范围可达90米。

- 该系统将已生成的3D几何结构以方向信息形式存储,并专门针对质量损失进行训练,从而解决此前视频模型的两个核心缺陷。

- Nvidia表示,Lyra 2.0在六种竞品中表现更优,且可将生成场景导出至物理引擎(如Isaac Sim),用于机器人在虚拟环境中训练。

Nvidia研究人员发布了Lyra 2.0,这是一种可以从单张照片生成大型、连贯3D环境的系统。生成的场景可实时探索,并直接用于机器人模拟。

现有的3D场景生成AI模型在长距离摄像机路径上存在困难:随着虚拟摄像机远离起始点,颜色和结构会逐渐失真;当摄像机回到之前见过的位置时,模型往往重新构建整个环境。Nvidia研究人员希望通过Lyra 2.0解决这一问题。

该系统输入一张照片后,生成由摄像机控制的视频,模拟虚拟漫游场景。这些视频随后自动转换为可实时查看并用于仿真环境的3D表示。根据研究论文,生成的场景大约可覆盖90米范围。

Lyra 2.0如何解决3D场景生成中的两大难题

研究人员指出,当前视频模型面临两大根本性挑战:首先,一旦某个区域离开画面,模型就会忘记之前看到的内容;其次,在逐帧生成视频的过程中,微小误差会不断累积,最终导致显著失真。

为解决第一个问题,Lyra 2.0会存储每一帧生成的3D几何结构。当摄像机再次移回曾经访问过的区域时,系统会调用早期帧的空间信息作为参考。视频模型仍负责实际图像生成,因此存储的几何结构中的错误不会直接传递到新帧中。

为防止漂移,研究人员在训练过程中故意让模型接触其自身有缺陷的输出。这教会它识别并纠正质量下降,而不是简单地传播错误。

Lyra 2.0优于六种竞争方法

根据Nvidia的说法,在两个数据集上的基准测试中,Lyra 2.0在几乎所有评估指标(包括图像质量、风格一致性及摄像机控制)上均超越了六种其他方法,其中包括GEN3C、Yume-1.5和CaM。该模型的一个更快版本可在保持相近质量的前提下,将视频生成速度提升约13倍。

生成的3D场景可通过交互式界面逐步探索,并以网格形式导出至物理引擎(如Nvidia Isaac Sim)。公司表示,这能让机器人在完全生成的环境中训练,而无需采集真实世界的3D数据。不过目前,Lyra 2.0仅支持静态场景。

Nvidia希望借助Lyra 2.0扩大机器人模拟训练规模。

订阅THE DECODER以获得无广告阅读体验,每周AI通讯,每年六次独家“AI雷达”前沿报告,完整档案访问权限,以及评论区访问权限。

来源与参考

收录于 2026-04-17