AI 可能开始“构建自己的继任者”

Jack Clark 认为,到 2028 年底前出现无人参与的 AI 研发概率已超过 60%,这意味着 AI 研发流程本身可能被自动化重塑。[[1491]]

AI 日报

今天的主线很清晰:AI 正从“更强模型”加速转向“更会自我扩张的系统”和“更深的企业落地”。一边是关于自动化 AI 研发的前瞻判断,另一边是企业部署、代理编排、语音基础设施和算力融资的全面加码。

Overview

从 46 条资讯中筛选出 27 条

今天的主线很清晰:AI 正从“更强模型”加速转向“更会自我扩张的系统”和“更深的企业落地”。一边是关于自动化 AI 研发的前瞻判断,另一边是企业部署、代理编排、语音基础设施和算力融资的全面加码。

Jack Clark 认为,到 2028 年底前出现无人参与的 AI 研发概率已超过 60%,这意味着 AI 研发流程本身可能被自动化重塑。[[1491]]

两家公司都在通过合资企业和服务团队深入企业客户,说明行业竞争正从模型能力转向落地、集成与长期客户关系。[[1492]][[1501]][[1502]]

Cerebras 推进大规模 IPO 的同时,银行却在为 AI 数据中心贷款接近风控上限,显示 AI 扩张正在改写融资逻辑。[[1496]][[1503]][[1510]]

Google 的签名 Webhook 和 OpenAI 的 Symphony 都在解决代理系统如何高效、可靠地协同工作,说明 agentic AI 正从概念走向基础设施层。[[1498]][[1489]][[1516]]

Appfigures 数据显示,图像模型发布带来的下载增长远高于聊天机器人升级,表明用户偏好正在向视觉生成能力倾斜。[[1500]]

一篇曾被广泛引用的“ChatGPT 提升学习效果”研究被撤回,提醒行业在快速迭代中仍需警惕不可靠的研究结论。[[1490]]

AI 行业正在同时发生两件事:前沿能力向“自动化研发”推进,商业化重心则向企业部署、代理管理和基础设施融资下沉。今天的报道显示,头部实验室和基础设施公司都在为一个更复杂的 AI 时代做准备:模型不只是更强,还要更快、更稳、更能嵌入真实工作流。

《Import AI》对无人参与 AI 研发的判断,给整个行业定下了一个更长期、更激进的预期:如果模型真的开始帮助构建下一代模型,技术迭代节奏、研发组织方式和安全边界都会被重新定义。[[1491]]

Anthropic、OpenAI 和 Sierra 的动作都指向同一趋势:企业客户需要的不只是 API,而是部署、集成、工程支持和可持续服务。合资公司、前置部署工程师和客户体验平台,正在成为新的竞争前线。[[1492]][[1501]][[1502]][[1497]]

从 Cerebras 的 IPO 到数据中心融资压力,AI 扩张已经不只是产品问题,而是算力、资本和银行风险管理的联动问题。谁能稳定拿到钱、电力、芯片和市场信心,谁就更可能赢得下一阶段。[[1496]][[1503]][[1510]]

Google 的 webhook、OpenAI 的 Symphony,以及围绕 agent management platform 的讨论,说明行业正在补齐 agentic AI 真正落地所需的调度、可观测性和治理层。未来的瓶颈不只是模型能力,而是如何安全地大规模运行大量代理。[[1498]][[1489]][[1516]]

ChatGPT 教育研究被撤稿提醒行业:生成式 AI 的早期“证据”未必稳固。与此同时,OpenAI 推出更强账户安全选项,说明在功能竞赛之外,用户数据与身份安全也正在成为产品分化点。[[1490]][[1513]]

今天的报道共同指向一个判断:AI 的下一阶段不是单点突破,而是系统化竞争。模型、代理、企业服务、基础设施和治理正在同时加速,真正的赢家将是能把这几层拼起来的公司。

Stories

Import AI

在《Import AI 455》中,Jack Clark 认为,到2028年底之前出现“无人参与的 AI 研发”——即 AI 系统能够自主构建其后继系统——的概率已经超过60%。他指出,从公开研究和已部署产品来看,端到端自动化 AI 研究所需的各个组成部分已经开始拼接起来。

如果 AI 系统能够真正自动化 AI 研究与开发,模型改进的速度可能会显著加快,并改变推动前沿进展的主体。这个变化会影响 AI 实验室、软件工程师、政策制定者和安全研究人员,因为它可能压缩技术迭代周期,并让未来能力更难预测。

在这篇《Import AI》文章中,Jack Clark 认为 AI 研究很快可能会变成端到端自动化。他的核心判断是一个带有犹豫色彩的观点:根据公开可得的信息,他认为到2028年底前,出现“无人参与的 AI 研发”的概率可能超过60%,也就是出现一种足够强的 AI 系统,能够有相当大的把握自主构建自己的后继系统。Clark 认为这将是一个非常重大的转折点,其后果难以被社会消化,也几乎无法准确预测。 他表示自己并不认为这件事会在2026年发生,但他预计在一到两年内,至少在非前沿模型层面,可能会先看到“模型端到端训练其后继者”的概念验证。支撑这一判断的材料主要来自公开研究、基准趋势,以及前沿公司正在部署的产品。

他强调,AI 开发中的工程环节已经越来越容易被自动化,而且如果缩放趋势继续下去,模型最终可能会变得足够“有创造力”,不仅能执行现有研究路径,还能帮助提出新的研究方向。 文章随后开始用多个基准的变化来拼出整体图景,而不是依赖某一个单独指标。Clark 也明确提醒,单个基准往往存在噪声和缺陷,因此他更关注跨多个数据点呈现出的总体趋势。 文章开头首先把软件和代码视为 AI 系统的核心基础,认为代码生成能力和多步编码工作流的进步,是自动化 AI 研发的重要前提。

Clark 表示他不认为这会在2026年发生,但他认为在一到两年内,至少非前沿模型层面,可能会出现“模型端到端训练其后继者”的概念验证。他把这一判断建立在 arXiv、bioRxiv、NBER 的公开资料以及 SWE-Bench 等基准趋势之上,同时提醒说单个基准都有噪声且并不完美。

TechCrunch AI

Anthropic在周一宣布成立一家新的合资企业,专注于部署企业AI服务,Blackstone、Hellman & Friedman和Goldman Sachs将作为创始合作伙伴。就在几个小时之前,Bloomberg报道称OpenAI也在筹备一个类似的项目,名为The Development Company,这显示两家实验室正同步加码资本支持的企业合作。

这标志着AI公司正从“做模型”转向更深入的企业落地,通过定制化集成和长期服务关系来锁定客户。它也表明,头部AI实验室正在借助私募股权和其他另类资产管理机构开辟新的收入渠道,同时继续以极高估值大规模融资。

Anthropic宣布成立一家新的合资企业,目标是部署企业AI服务,并邀请Blackstone、Hellman & Friedman和Goldman Sachs担任创始合作伙伴。该项目还获得一批更广泛投资者支持,包括Apollo Global Management、General Atlantic、GIC、Leonard Green和Sequoia Capital。根据《华尔街日报》的报道,这家新公司估值为15亿美元,其中Anthropic、Blackstone和Hellman & Friedman各自承诺出资3亿美元。这个时点非常关键,因为就在几个小时之前,Bloomberg报道称OpenAI也在为一个类似的项目募集资金,项目名为The Development Company。

Bloomberg称,OpenAI的项目规模更大,计划从19位投资者那里融资40亿美元,对应100亿美元估值,投资者包括TPG、Brookfield Asset Management、Advent和Bain Capital。两家公司的逻辑看起来相同:借助另类资产管理机构,开辟企业AI销售的新通道,并从这些投资者的投资组合公司中获得更多合作机会。这样的合资企业也可能帮助厂商为单个客户投入更多工程资源,强化类似Palantir推广的前置部署工程师模式。Anthropic表示,这类合作可能从其工程团队与临床人员和IT人员并肩工作开始,围绕现有工作流程构建工具,主要面向各行业的中型公司。

《华尔街日报》称,Anthropic这家合资企业估值为15亿美元,其中Anthropic、Blackstone和Hellman & Friedman各承诺出资3亿美元。该交易结构旨在支持前置部署工程师模式,即工程师直接与客户团队合作,把工具嵌入真实工作流程;而OpenAI的竞争性合资项目据报规模更大,计划按100亿美元估值融资40亿美元。

Ars Technica AI

Springer Nature 旗下期刊撤回了一篇被广泛引用的元分析论文,该论文曾声称 ChatGPT 能提升学生学习效果。出版方表示,研究分析存在不一致之处,因此已无法信任其结论。

这篇论文曾影响关于生成式 AI 是否有助于教育的早期公众和学术讨论,因此撤稿是在纠正一个可能误导性的证据基础。它也说明在快速变化的 AI 领域里,质量不足或综合不当的研究会多么快地塑造舆论。

一项声称 OpenAI 的 ChatGPT 能提升学生学习效果的研究,在发表将近一年后被撤稿。Springer Nature 表示,这篇论文的分析存在不一致之处,出版方也因此不再对其结论有信心。该文在撤稿前已经产生了很大影响,获得了数百次引用,并在社交媒体上广泛传播。论文最初发表于 2025 年 5 月 6 日的 Humanities & Social Sciences Communications。它通过对 51 项既有研究做元分析,尝试估算 ChatGPT 对学习表现、学习感知和高阶思维的影响。

作者报告称,ChatGPT 对学习表现有较大的正面作用,对另外两个指标也有中度正面作用。爱丁堡大学的 Ben Williamson 表示,这篇论文被很多人当作生成式 AI 有益于学习的早期“硬证据”。他还指出,这项分析似乎把方法、样本和研究对象差异很大的研究混在了一起,因而无法可靠比较。Williamson 也质疑,从 ChatGPT 于 2022 年 11 月发布算起,仅两年半时间内,是否真能完成、审稿并发表足够多高质量的教育研究。尽管论文已被撤稿,它的影响可能仍会持续,因为它此前已在 Springer Nature 同行评审期刊中被引用 262 次,整体引用达到 504 次,阅读量接近 50 万,关注度评分也进入了全站前 1%。

这篇论文分析了 51 项既有研究,并声称 ChatGPT 对学习表现有显著正面影响,同时对学习感知和高阶思维也有中度提升。报道显示,该文于 2025 年 5 月 6 日发表在 Humanities & Social Sciences Communications 上,之后已在 Springer Nature 的同行评审期刊中被引用 262 次,总引用达到 504 次。

MIT Technology Review AI

马斯克诉奥特曼案的首周审理已在加州奥克兰开庭,马斯克指控 OpenAI 背弃了最初的非营利使命,实际上变成了营利公司。报道重点描述了庭审氛围,包括围绕 AI 安全、OpenAI 重组以及马斯克声称自己直到 2022 年才意识到所谓不当行为的激烈交锋。

此案可能影响 OpenAI 的公司结构,并可能干扰其据称今年的上市计划。更广泛地说,这是一场关于谁应控制先进 AI 发展、以及应由何种治理框架来约束它的最高关注度法律争斗之一。

马斯克诉奥特曼案的首周审理在加州奥克兰开庭,很快就变成了一场备受关注的法庭大戏。埃隆·马斯克起诉 OpenAI,称自己在大约十年前为其早期提供资金时,理解的是一个非营利使命,而不是后来这种更接近营利化的公司形态。报道指出,马斯克主张 Sam Altman 和 OpenAI 总裁 Greg Brockman 违反了 OpenAI 的慈善信托义务,因为他们把组织实质上改造成了营利公司。马斯克要求的救济包括损害赔偿、罢免 Altman,而对他最关键的目标则是撤销 OpenAI 的重组。文章提到,2025 年 OpenAI 与加州和特拉华州总检察长达成了一项妥协,使非营利部分对公司的日常控制权低于最初方案,而马斯克正试图阻止这一进程。

OpenAI 的辩护则是,马斯克从一开始就知道构建 AI 需要一个营利部门,因此并没有被欺骗。案件的一个核心争点,是马斯克究竟何时才知道足以提起诉讼的所谓不当行为,因为慈善信托索赔通常受“发现后约三到四年内必须起诉”的时效限制。报道还描写了庭审现场气氛:当马斯克的一名律师说出“我们都可能因为 AI 而死”时,法官立即反驳,提醒双方这起案件并不是在审理 AI 是否已经伤害了人类。法官还严肃指出,庭审的焦点应当是眼前的法律争议,而不是围绕 AI 灾难或谁更适合掌管 AI 安全的宏大哲学辩论。

马斯克寻求的救济包括撤销 OpenAI 的重组、索赔巨额损害赔偿,甚至要求罢免 Sam Altman,但核心问题是 OpenAI 是否违反了慈善信托义务。争议还取决于诉讼时效,以及马斯克能否说服法庭:他直到 2022 年才发现所谓欺骗,而不是更早。

OpenAI News

OpenAI 表示,它重建了自己的 WebRTC 技术栈,以支持低延迟、全球规模的实时语音 AI,并实现更流畅的对话轮次切换。公司将其描述为更自然、更具交互性的语音体验背后的基础设施升级。

低延迟语音系统是让 AI 听起来像真正对话而不是机械回复的关键。一个可全球扩展的 WebRTC 技术栈很重要,因为它能够提升不同地区用户的响应速度,并为实时 AI 基础设施树立实际参考。

OpenAI 发布了一篇技术说明,介绍它如何重建自己的 WebRTC 技术栈,以支撑实时语音 AI。其目标是在保证低延迟的同时实现全球规模部署,让不同地区的用户都能获得自然的交互体验。公司表示,这套系统专门针对顺畅的对话轮次切换进行了设计,而这正是语音助手能否避免尴尬停顿的关键。WebRTC 是这一方案的核心,因为它承担了以尽可能低的延迟传输音频的任务。

通过重建整个技术栈,OpenAI 也在传达一个信息:现成的实时通信基础设施还不足以满足它对性能和交互质量的要求。这个发布把语音 AI 描绘成一个既是模型问题、也是系统工程问题的领域,因为传输延迟和时序会直接影响用户体验。整体来看,这项工作为更流畅、更快速、可大规模部署的语音交互打下了基础。

重点是 WebRTC,这是一种常用于交互式音视频的实时通信协议。文章强调了对话轮次切换的顺畅性,这说明该技术栈的优化不仅是为了速度,也为了满足对时序非常敏感的对话行为。

TechCrunch AI

Cerebras Systems 表示计划以每股115美元至125美元的价格出售2800万股股票,最多可融资35亿美元,按高端定价估值可达266亿美元。若按区间上端完成发行,这将成为截至目前2026年最大的科技IPO。

如果这次上市成功,将表明投资者对 AI 基础设施公司的需求依然强劲,即使融资环境波动也不例外。它还可能进一步抬高市场对 SpaceX、OpenAI 和 Anthropic 等更大型潜在上市项目的预期。

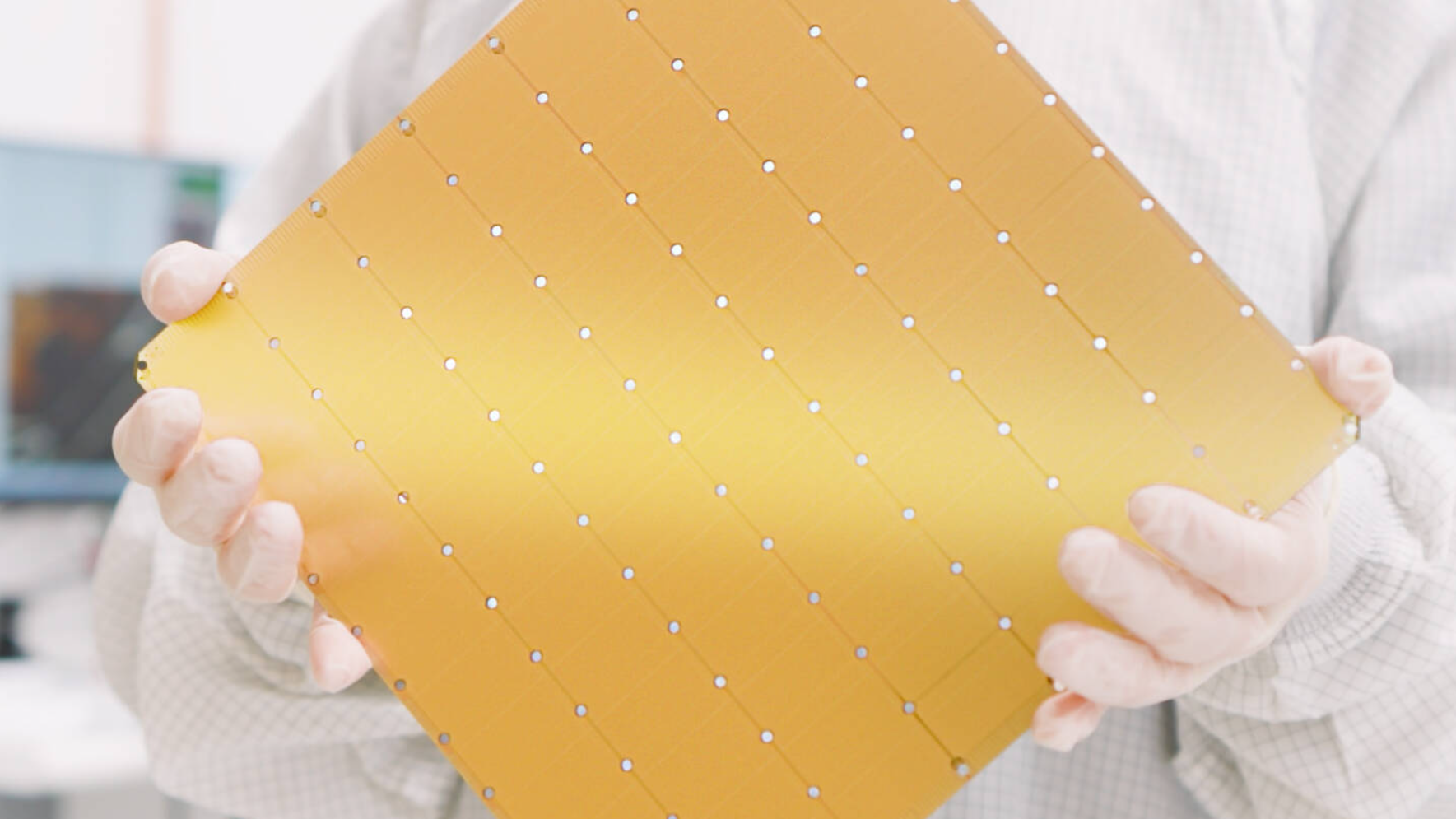

Cerebras Systems 终于接近其漫长 IPO 进程的终点,而这次拟议发行的规模足以重新定义外界对 AI 硬件市场的预期。公司在周一表示,计划以每股115美元至125美元的价格出售2800万股,融资约35亿美元,估值最高可达266亿美元。若按高端定价完成,这将成为截至目前2026年最大的科技IPO。公司过去几个月的估值变化也非常快,因为它在2月刚以230亿美元估值完成了10亿美元的 Series H 融资。若 IPO 定价理想,后期投资者将获得可观的账面收益。Cerebras 最知名的产品是 Wafer-Scale Engine 3,这是一款专门面向 AI 工作负载的芯片,被定位为 GPU 方案的替代选择。公司称,这颗芯片在推理场景下表现尤其出色,推理是处理用户提示词所需的 AI 计算,同时还能降低功耗。

招股文件还凸显了 Cerebras 与 OpenAI 之间的紧密关系,OpenAI 既是其重要客户,也是其融资关系中的关键一方。此前曾有报道称 OpenAI 一度考虑收购 Cerebras,而在12月,OpenAI 又向 Cerebras 提供了10亿美元贷款,并以可购买超过3300万股股票的认股权证作担保。Cerebras 的投资者名单中还包括多家知名风投、主权财富相关基金以及 Sam Altman、Greg Brockman 等知名科技人物。该公司最初计划在2024年上市,但因阿布扎比相关投资受到联邦审查而推迟,后来在又一轮大额融资和与 OpenAI 的多年大单之后重新推进上市。彭博社报道称,承销银行已经收到约100亿美元的认购订单,远高于35亿美元的发行规模,显示市场需求强劲。整体来看,这一事件既反映了投资者对 AI 基础设施的热情,也可能为未来更大规模的明星公司上市铺路。

Cerebras 的 Wafer-Scale Engine 3 是一款面向 AI 的专用芯片,公司称其在推理场景下比基于 GPU 的方案更快、功耗更低。公司文件还披露了与 OpenAI 的特殊关联,包括 OpenAI 在 12 月提供的 10 亿美元贷款,并附带可购买超过3300万股股票的认股权证。

TechCrunch AI

由 Bret Taylor 创办的 AI 初创公司 Sierra 正在进行一轮 9.5 亿美元融资,由 Tiger Global 和 GV 领投。此轮融资将公司的投后估值推高至 150 亿美元以上,并让其可用于扩张企业 AI 客户体验平台的资金超过 10 亿美元。

这笔巨额融资表明,投资者仍然高度看好企业 AI,尤其是用于自动化客户互动和其他业务流程的工具。它也意味着,想成为 AI 驱动服务体验默认平台的厂商之间,竞争正在加速升温。

Sierra 周一宣布正在进行一轮 9.5 亿美元融资,由 Tiger Global 和 GV 领投,融资后估值超过 150 亿美元。公司表示,这笔新资金将使其拥有超过 10 亿美元的可用资本,用于推动其成为“全球标准”的 AI 驱动客户体验平台。Sierra 由 Bret Taylor 创办,他同时还是 OpenAI 董事长,并曾担任 Salesforce 联席 CEO。公司称,自己几年前最初只有 4 个设计合作伙伴,如今已经扩展到服务《财富》50 强中超过 40% 的客户。Sierra 还表示,其平台上的智能体正在处理数十亿次交互,覆盖房贷再融资、保险理赔、退货管理以及非营利筹款等场景。此次融资之前,Sierra 已经历一段极快的营收增长:公司在去年 11 月底称年经常性收入达到 1 亿美元,并在今年 2 月初进一步披露 ARR 达到 1.5 亿美元。

公司认为,这既反映了企业对 AI 的强烈需求,也说明企业在部署 AI 时需要承担不小的前期成本。Taylor 一直强调,agentic AI 的长期回报是降低成本、提高收入,但在收益显现之前,建设和落地阶段可能非常昂贵。TechCrunch 近期 StrictlyVC 活动上的一段对话也印证了这一点,Uber CTO Praveen Neppalli Naga 说,公司在去年底开放 agentic AI 工具后很快就“烧光了”AI 预算,但也开始看见实际效果。Naga 还表示,在 Uber 约 8000 名工程师和技术员工中,约 10% 的代码现在是由系统自主生成的,并举例称一个原本需要一年的酒店预订集成项目,最终只用了 6 个月就完成。除了面向客户的智能体之外,Sierra 还在 4 月推出了 Ghostwriter,这是一个“agent as a service”工具,用户只需用自然语言描述需求,它就能自动创建并部署一个专用智能体。Taylor 认为,这与他对企业软件未来的判断一致:很多软件工具几乎没人真正频繁使用,而未来的方向是让员工不必再面对复杂系统界面。

Sierra 表示,公司已从最初的 4 个设计合作伙伴发展到拥有超过 40% 的《财富》50 强客户,其平台上的智能体已处理了数十亿次交互。公司还披露了快速增长的 ARR:去年 11 月底达到 1 亿美元,随后在今年 2 月初升至 1.5 亿美元,并在 4 月推出了 Ghostwriter,这是一种可根据自然语言指令自动创建并部署专用智能体的“agent as a service”工具。

Google AI Blog

Google 为 Gemini API 引入了事件驱动的 Webhook,长时间运行的任务完成后可以通过实时 HTTP POST 主动通知服务器,而不再需要反复轮询。该功能现已可用,面向 agentic 工作流、Deep Research、长视频生成以及可能持续数分钟或数小时的 Batch API 任务。

这可以降低延迟、服务器负载和集成成本,尤其适合构建异步 AI 系统的开发者,因为轮询在这类场景下既低效又昂贵。它也符合 agentic 应用向事件驱动架构演进的趋势,即工具和模型不再持续检查状态,而是在状态变化时被动响应。

Google 宣布 Gemini API 现在支持事件驱动的 Webhook,以帮助开发者更轻松地构建长时间运行的 agentic 应用。公司表示,这项改动的目标是取代低效的轮询方式,也就是开发者反复调用 GET operations 来检查任务是否完成。随着 Gemini 被用于 Deep Research、长视频生成以及 Batch API 批量处理等场景,这一问题变得更重要,因为这些任务可能持续数分钟甚至数小时。借助新机制,Gemini 可以在任务完成的瞬间向开发者服务器推送实时 HTTP POST 载荷。

Google 还强调,这套 webhook 设计遵循 Standard Webhooks 规范,并通过签名请求来提升安全性和可靠性。具体来说,请求会包含 webhook-signature、webhook-id 和 webhook-timestamp 等头部,用于支持幂等性并降低重放风险。公司同时表示,消息投递保证“至少一次”,并会自动重试最长 24 小时。开发者既可以在项目级别通过 HMAC 全局配置 webhook,也可以按请求使用 JWKS 动态覆盖配置,Google 还提供了文档和 Cookbook 供用户完成端到端集成。

Google 表示,这套 webhook 实现严格遵循 Standard Webhooks 规范,并使用 webhook-signature、webhook-id 和 webhook-timestamp 请求头进行签名,以支持幂等性并帮助防止重放攻击。系统提供“至少一次”投递保证,并会自动重试最长 24 小时;开发者可以在项目级使用 HMAC 配置 webhook,也可以在单次请求中用 JWKS 覆盖配置。

Simon Willison

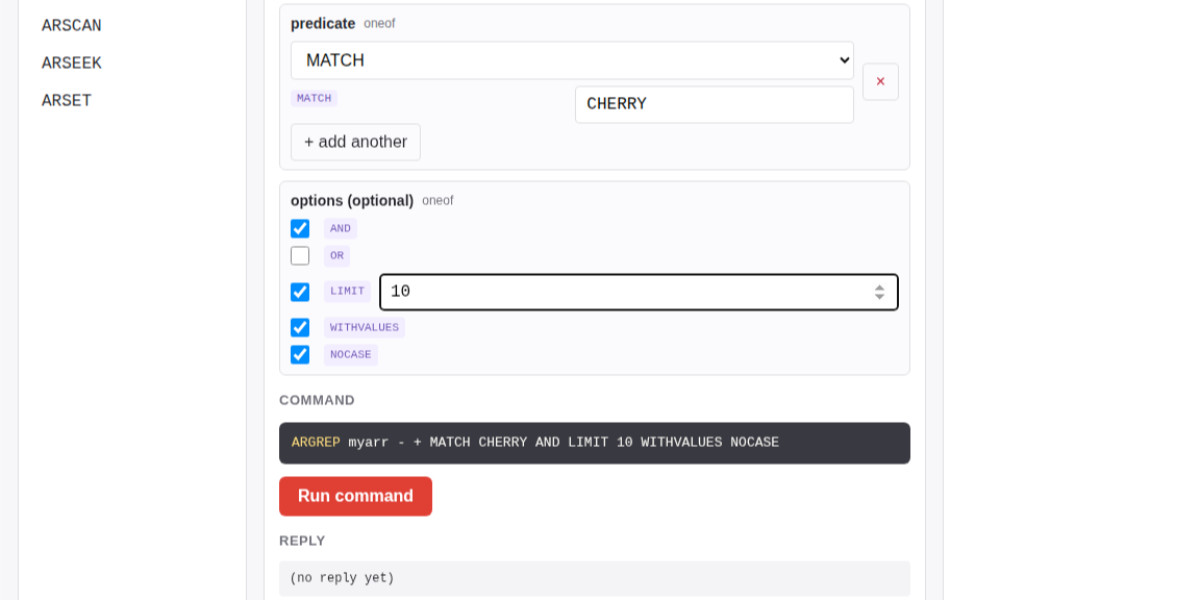

Simon Willison 发布了 Redis Array Playground,这是一个可在浏览器中试用 Redis 提议中新数组数据类型的工具。它在浏览器里运行了一个经过 WASM 编译的 Redis 子集,并把包括 ARGREP 在内的新数组命令做成了可交互测试界面。

这让 Redis 用户和系统开发者可以在最终版本发布前,安全地了解一个仍处于提议阶段的数据类型。它也展示了基于浏览器的 WebAssembly 工具如何通过降低试用门槛,来加速对数据库新特性的反馈与讨论。

Simon Willison 发布了 Redis Array Playground,用户可以直接在浏览器里试验 Redis 提议中的数组数据类型。这个工具是他让 Claude Code for web 生成的交互式界面,底层运行的是一个在浏览器中通过 WASM 编译的 Redis 子集。相关的特性工作来自 Salvatore Sanfilippo,他提交了 Redis 的 PR #15162,为 Redis 增加一种新的数组数据类型。文章列出了这项提议对应的一组新命令,包括 ARCOUNT、ARDEL、ARDELRANGE、ARGET、ARGETRANGE、ARGREP、ARINFO、ARINSERT、ARLASTITEMS、ARLEN、ARMGET、ARMSET、ARNEXT、AROP、ARRING、ARSCAN、ARSEEK 和 ARSET。

作者特别指出,最有意思的是 ARGREP,因为它可以在数组值的某个范围内执行服务端 grep。这个命令使用了新引入的 TRE 正则表达式库。Willison 还链接了 Sanfilippo 关于该数组类型 AI 辅助开发过程的更长说明。整体来看,这是一个让人们在正式发布前就能理解和测试实验性 Redis 特性的实用工具。

这个数组提议来自 Salvatore Sanfilippo,他提交了 PR #15162,向 Redis 添加数组数据类型。试玩工具展示了 ARCOUNT、ARGET、ARINSERT、ARSCAN 等命令,其中最值得注意的是 ARGREP,它使用新引入的 TRE 正则库,对数组值范围执行服务端 grep。

TechCrunch AI

TechCrunch 引述 Appfigures 数据称,AI 移动应用如今从图像模型发布中获得的下载增长,大约是传统聊天机器人模型更新的 6.5 倍。Google 的 Gemini 和 OpenAI 的 ChatGPT 都显示,图像模型上线带来的下载激增,明显大于近期文本模型升级带来的效果。

这说明消费者对 AI 应用的兴趣重心,正在从更强的对话能力转向更强的视觉生成能力,这可能会改变产品路线图和发布策略。对于 AI 应用开发者来说,图像生成可能更容易带来安装量,即便它不一定立刻转化为收入。

TechCrunch 报道称,图像模型发布如今已经成为 AI 移动应用最强的增长引擎。根据 Appfigures 的数据,这类发布带来的下载增长,是传统模型更新的 6.5 倍。文章指出,这一趋势与早期 AI 应用爆发阶段不同,当时推动下载的主要是对话模型能力提升,以及语音聊天等新功能。现在,用户似乎更愿意因为图像生成功能升级而去下载应用并尝试新能力。Appfigures 的分析中,Google 的 Gemini 和 OpenAI 的 ChatGPT 都在推出图像模型后出现了显著的下载激增。对于 Gemini 来说,Nano Banana 的发布带来了 2200 多万次额外下载;在 Gemini 2.5 Flash 图像模型推出后的 28 天内,下载量提升了 4 倍以上。ChatGPT 在去年 3 月推出 GPT-4o 图像模型后,也在 28 天内增加了 1200 多万次增量安装,Appfigures 认为这大约是其后续 GPT-4o、GPT-4.5 和 GPT-5 模型发布所带来下载增幅的 4.5 倍。

Meta AI 的 Vibes 也在 2025 年 9 月发布后带来了约 260 万次额外下载,不过它更接近视觉内容功能,而不是纯文本模型更新。报告同时提醒,下载量增加并不等于收入同步增长。比如 Nano Banana 虽然带来了很大的安装量增长,但在发布后的 28 天内,估计只有 18.1 万美元的消费者总支出。Meta AI 的 Vibes 也带来了额外下载,但没有形成明显收入。三者之中,只有 ChatGPT 把流量转化成了更明显的金钱回报,Appfigures 估计其 GPT-4o 图像模型在发布后的 28 天内带来了约 7000 万美元的消费者总支出。Appfigures 还研究了 DeepSeek,但认为它不符合这一模式,因为 DeepSeek R1 在 2025 年 1 月带来的 2800 万次下载,更像是一次爆发式出圈,而不是图像模型驱动的常规产品更新。

Appfigures 发现,Gemini 的 Nano Banana 上线后,在 Gemini 2.5 Flash 图像模型推出后的 28 天内带来了 2200 多万次额外下载,使该时期下载量提升了 4 倍以上。ChatGPT 在 GPT-4o 图像模型发布后的 28 天内增加了 1200 多万次增量安装,Meta AI 的 Vibes 约增加了 260 万次,而只有 ChatGPT 显示出明显的消费者支出增长。

The Decoder

Anthropic正在推出一家新的AI服务公司,并获得Blackstone、Hellman & Friedman、Goldman Sachs、General Atlantic、Apollo Global Management和Sequoia Capital等机构的支持。该合资项目将帮助中型市场企业把Claude整合进核心业务流程,Anthropic工程师也会与新团队一起参与定制部署。

这表明头部AI实验室已经意识到,企业采用AI不仅是“卖模型”,更是一个服务与集成问题。对于缺乏内部能力去处理实施、变更管理和定制流程的公司来说,这可能会加速AI的实际落地。

Anthropic正在超越单纯的模型研发,推出一家新的AI服务公司,帮助中型市场企业采用Claude。该合资项目得到了Blackstone、Hellman & Friedman、Goldman Sachs、General Atlantic、Apollo Global Management和Sequoia Capital等大型金融机构和投资方的支持。Anthropic表示,这项新业务的重点不是简单提供软件访问权限,而是把Claude嵌入中型组织的核心运营流程。Anthropic工程师将与新的服务团队并肩工作,为客户打造定制化解决方案。首席财务官Krishna Rao表示,Claude的需求增长已经“显著”超过单一交付模式所能承载的范围。

Anthropic还表示,现有的实施合作伙伴Accenture、Deloitte和PwC将继续参与。该项目面向区域性医疗网络和中型制造商等企业,这些公司通常缺乏独立推进AI采用所需的内部资源。此举紧随OpenAI通过“The Deployment Company”推进部署服务的动作,据称该合资项目获得了超过40亿美元的资金支持。整体来看,这说明主要AI实验室越来越依赖合作伙伴来把AI大规模地变成企业内部真正可用的工具。

Anthropic首席财务官Krishna Rao表示,Claude的需求已经“显著”超过单一交付模式所能承载的范围,因此Accenture、Deloitte和PwC等现有合作伙伴仍将继续参与。新公司面向的对象包括区域性医疗网络和中型制造商这类通常难以独立推进AI项目的企业。

The Decoder

据彭博社报道,OpenAI 已为一家名为“The Deployment Company”的新合资企业筹集超过 40 亿美元。该项目旨在帮助企业大规模部署 OpenAI 软件。

这表明 OpenAI 正在更深入地进入企业基础设施层,而不仅仅是模型研发。若进展顺利,该合资企业可能加速大型组织采用 AI,并加剧企业级 AI 部署领域的竞争。

据彭博社报道,OpenAI 已为一家名为 The Deployment Company 的新合资企业筹集超过 40 亿美元。该项目的目标是帮助企业大规模部署 OpenAI 软件。一位知情人士表示,共有 19 家投资者参与其中,包括 TPG、Brookfield Asset Management、Advent 和 Bain Capital。这一交易与此前路透社和《金融时报》关于内部项目 DeployCo 的报道相吻合。此前报道提到,OpenAI 将先投入 5 亿美元,并可选择再追加最多 15 亿美元。

《金融时报》还报道称,私募股权投资者将获得 17.5% 的年化保证回报,同时 OpenAI 将获得超级投票权股份,不过路透社无法独立证实这些条款。该合资企业建立在 OpenAI 的 Frontier 企业平台以及与 BCG、麦肯锡、埃森哲和凯捷等咨询公司的 Frontier Alliances 之上。报道还提到,Anthropic 也在推进一个类似的 15 亿美元合资项目,合作方包括黑石和高盛。整体来看,这些动作表明大型 AI 公司正在把重点从模型本身扩展到企业落地所需的部署和运营基础设施。

一位知情人士称,共有 19 家投资者参与,包括 TPG、Brookfield Asset Management、Advent 和 Bain Capital。报道还称,OpenAI 将先投入 5 亿美元,并可能追加至多 15 亿美元;《金融时报》则称私募股权投资者可获得 17.5% 的年化保证回报,而 OpenAI 将获得超级投票权股份。

The Decoder

Cerebras Systems 正准备第二次冲刺纳斯达克 IPO,股票代码为 CBRS,传出的定价区间为每股 115 美元到 125 美元。路透社和彭博社称,这家公司可能以约 400 亿美元估值募集高达 40 亿美元资金。

Cerebras 是 AI 硬件领域最受关注的 Nvidia 挑战者之一,因此如果这次 IPO 规模成功,将表明投资者对 AI 基础设施标的仍有很强需求。它也说明,专注于大模型训练和推理的芯片公司依然可能获得高溢价的公开市场估值。

Cerebras Systems 正重新向公开市场发起冲击,此前它在 10 月撤回了首次 IPO 申请。该公司总部位于加利福尼亚州 Sunnyvale,计划以代码 CBRS 在纳斯达克上市,IPO 路演将于周一启动。路透社援引知情人士称,此次发行的目标定价区间为每股 115 美元到 125 美元。彭博社则表示,这笔交易最多可能募集 40 亿美元,并将公司估值推高至约 400 亿美元。

公司的业务增长很快,2025 年收入达到 5.1 亿美元,高于前一年的 2.9 亿美元。Cerebras 还表示公司实现了首次盈利,这为其上市叙事增加了支撑。该公司以 wafer-scale engine 芯片闻名,这类芯片用于加速 AI 模型训练和推理,因此它与 Nvidia 形成直接竞争。Morgan Stanley、Citigroup、Barclays 和 UBS 正在牵头此次发行。

这家公司打造的是 wafer-scale engine 芯片,主要用于加速大模型训练,尤其是推理。根据其产品页面及相关报道,Cerebras 称 WSE-3 是有史以来最大的 AI 芯片,面积为 46,225 平方毫米,包含 4 万亿个晶体管。

The Decoder

OpenAI 发布了 Symphony,这是一个开源规范和参考实现,可以把 Linear 这类任务跟踪器变成 Codex 代理的控制平面。开发者不再需要手动同时管理多个会话,未完成的工单可以直接分配给代理处理,最后再由人类进行审查。

这次发布代表了一种工作流转变:由工单系统而不是人来大规模协调编码代理。如果这种方式能广泛落地,就可能减少工程师的上下文切换,并让团队更容易把自主软件开发流程真正运转起来。

OpenAI 发布了 Symphony,这是一个开源规范加参考实现,目标是让 Codex 代理更自主地处理软件任务。这个系统把 Linear 这类任务跟踪器当作工作的调度层,因此开放工单可以直接由代理领取,而不是由开发者手动监督多个会话。OpenAI 表示,这一变化是为了解决他们内部遇到的实际瓶颈:当同时运行超过三到五个 Codex 会话时,人类的上下文切换就成了限制生产力的因素。公司认为,真正的瓶颈不是模型速度,而是人类注意力。使用 Symphony 后,每个开放工单都会对应一个独立的代理和工作区,并一直运行到任务完成。若代理崩溃或卡住,系统可以把它重新拉起;只有未被阻塞的工单才会被选中,这样依赖关系允许时,工作就能并行推进。

OpenAI 还说,代理在发现相关问题时可以自己创建新工单,比如性能问题或重构机会。有些任务可能跨多个 pull request,甚至跨多个仓库;另一些则可能是纯研究或分析工作,并不涉及代码改动。OpenAI 称,在引入该系统后的前三周里,内部团队的合并 pull request 数量增长了六倍。这个项目的核心并不是复杂监控系统,而是一个名为 SPEC.md 的 Markdown 规范文件,参考实现则使用 Elixir 编写。OpenAI 从 Symphony 的实践中得到的一个结论是,代理很难被当作固定节点硬塞进严格的状态机里,因此公司现在更倾向于给它们目标和上下文,而不是逐步操作手册。文章还提到,社区已经开始把这个系统改造到其他模型和平台上。

OpenAI 表示,Symphony 把 Linear 当作一个状态机来使用,工单会在 Todo、In Progress、Review 和 Merging 等状态之间流转,系统会确保每个活跃工单都有代理负责。OpenAI 还说,代理可以自行创建后续工单,而参考实现使用 Elixir 编写,核心行为则主要写在一个 SPEC.md 文件里。

The Verge AI

The Verge 正在直播埃隆·马斯克与山姆·奥特曼围绕 OpenAI 创始使命的庭审,陪审团遴选于 4 月 27 日开始,马斯克则在 4 月 28 日、29 日和 30 日连续作证。案件已进入第二周,斯图尔特·拉塞尔和格雷格·布罗克曼等人物相继出庭,并且首次加入了 YouTube 直播音频。

这起诉讼可能影响 OpenAI 的治理结构、非营利属性以及长期发展方向,而 ChatGPT 目前又是市场上最重要的 AI 产品之一。案件结果还可能影响更广泛的行业讨论:前沿 AI 公司在获得巨额商业投资的同时,是否还能保持对非营利使命的忠诚。

The Verge 的现场报道记录了一场可能重塑 OpenAI 未来、并进一步影响 ChatGPT 走向的高风险庭审。争议起点是马斯克在 2024 年提起诉讼,指控 OpenAI 背离了创始时“开发有益于人类的 AI”的使命。庭审于 4 月 27 日开始陪审团遴选,马斯克在 4 月 28 日率先出庭作证,并在 4 月 29 日和 4 月 30 日继续作证。马斯克之后,其财务经理兼 Neuralink CEO 杰里德·比查尔也出庭,案件进入第二周。按照法庭安排,4 月 4 日星期一将听取斯图尔特·拉塞尔和 OpenAI 联合创始人格雷格·布罗克曼的证词,而且这是首次提供 YouTube 直播音频。

马斯克声称,奥特曼和布罗克曼说服他为 OpenAI 提供资金,随后却转向了偏离非营利初衷的道路。OpenAI 对这种说法予以否认,称此案是竞争对手出于嫉妒而发起的无根据阻挠,因为马斯克自己的 xAI 和 X 也在推动 Grok 等产品与 ChatGPT 竞争。马斯克的诉讼不仅要求更换领导层,还要求 OpenAI 停止以公共利益公司的形式运营,并索赔最高可达 1500 亿美元。现场更新显示,证词内容涵盖公司早期历史、投资细节、风险问题以及创始团队之间的关系。这篇报道把这场官司呈现为一场法律争斗,同时也是对 OpenAI 到底应该是什么的公开审判。

马斯克指控奥特曼和布罗克曼将 OpenAI 从“造福人类”的初衷上带偏,并要求撤换两人、阻止 OpenAI 继续以公共利益公司形式运营,同时为其非营利实体索赔最高 1500 亿美元。OpenAI 则表示,这起诉讼毫无根据,只是竞争对手试图破坏公司,而马斯克自己的 xAI 和 Grok 也正在直接挑战 ChatGPT。

Ars Technica AI

Ars Technica 报道称,阿尔伯塔选举机构 Elections Alberta 使用“诱饵陷阱”(canary trap)——即对选民名单做出细微改动的副本——来锁定与 Centurion Project 选民数据库工具相关的数据泄漏。注入到阿尔伯塔共和党版本名单中的伪造条目,后来也出现在 Centurion 的版本里,从而把泄漏源头指向了那份分发副本。

这是一个在敏感公共部门数据库中实际应用低技术但高效反泄漏手段的案例。它表明,即使在选举系统里,微小的来源标记也能帮助调查人员迅速缩小是谁共享了受限数据。

Ars Technica 报道了一起现代选举数据争议中的经典安全手法:诱饵陷阱(canary trap)。其原理是把同一份敏感信息发给不同接收者,但在每一份副本里加入略有差异的独特内容,这样一旦泄漏,就能通过这些独特细节识别泄漏源。阿尔伯塔的选举名单是一份选民数据库,包含数百万公民的姓名、地址和投票区信息。政党可以依法获取这份名单,但必须遵守不能向第三方共享等限制。

报道称,CBC 将 Centurion Project 描述为一个分离主义团体,它利用这份选举名单搭建了一个在线选民数据库。Elections Alberta 随后诉诸法庭,并获得命令关闭该网站。该机构接着表示,Centurion 使用的数据对应于一份合法发给阿尔伯塔共和党的副本,因为只在该版本中插入的伪造条目也出现在了 Centurion 的工具里。虽然数据在离开共和党之后到底经过了怎样的流转仍未公开查明,但诱饵陷阱已经足以让调查人员迅速锁定可能的泄漏路径,并对相关各方施加公开压力。

阿尔伯塔的选举名单包含数百万公民的姓名、地址和投票区,政党虽然可以依法获取,但受到不得向第三方共享等限制。Elections Alberta 表示,从阿尔伯塔共和党到 Centurion 的具体传播路径仍不清楚,但这一诱饵陷阱已经足以向双方施压,并促使 Centurion 下线该工具。

Ars Technica AI

在OpenAI审判开始前几天,埃隆·马斯克曾试探性寻求和解,但与Greg Brockman的交流很快变得强硬。OpenAI现在希望Brockman就马斯克那句“你们会成为美国最被痛恨的人”作证,把它作为马斯克诉讼动机的证据。

这场争议不仅关乎OpenAI的公司结构,还可能影响法院如何看待一家大型AI实验室的使命与治理。如果法官采纳这条消息,它可能会支持OpenAI的说法:马斯克提起诉讼更多是在施压竞争对手,而不是真正解决政策分歧。

在OpenAI审判开始前几天,埃隆·马斯克曾试图了解和解诉讼的可能性。这起诉讼指控OpenAI在Sam Altman的领导下背离了其“为人类福祉开发AI”的非营利使命。根据OpenAI周日提交的法庭文件,马斯克在开庭前两天给OpenAI总裁Greg Brockman发了消息,Brockman则建议双方撤回各自的主张。马斯克拒绝了这一提议,并回了一句威胁性极强的话:“到本周结束时,你和Sam会成为美国最被痛恨的两个人。如果你坚持,那就会这样。”OpenAI表示,Brockman很可能会就这段交流作证,而法官今天可能会决定这条消息是否可以作为证据使用。

OpenAI认为,这并不是受保护的和解沟通,因为它带有胁迫性,而且有助于说明马斯克的动机和偏见。该公司还指称,马斯克提起这起诉讼更像是一场针对竞争对手及其领导层的攻击行动,尤其是针对他长期不和的Altman。文件还提到马斯克在2022年Twitter诉讼中的做法,当时他的律师团队在试图重新谈判收购价格时也使用了“世界大战”等施压言辞。马斯克在本案中的开局并不顺利:上周他作为首位证人出庭时,据称多次失误、作出让步,并收回了自己关于AI风险可能迅速变成生存级威胁的一些强硬说法。如果这条消息最终被采纳,随着Brockman继续作证,它可能会成为马斯克在本案中的又一次挫折。

OpenAI认为,这段交流属于一种例外情况:当和解谈判带有胁迫性而非善意时,相关内容可以被采纳。该公司还把这条消息与马斯克在2022年试图退出收购Twitter时发出的“世界大战”式威胁联系起来。

Google AI Blog

谷歌发布了2026年4月AI公告汇总,重点介绍了 Gemini Enterprise Agent Platform、第八代 TPUs、Gemma 4、Deep Research Max、Google Vids 视频生成以及 Colab Learn Mode。文章将这些发布归入 Cloud Next ’26,并视为谷歌推进智能体 AI 的一部分。

这些公告显示谷歌正在把 AI 能力扩展到企业工作流、模型开发、芯片基础设施、研究工具和开发者教育等多个层面。这很重要,因为它可能加速企业、学生和开发者对智能体 AI 的采用,同时增强 Google Cloud 的竞争力。

谷歌发布了2026年4月 AI 新闻月度汇总,把这个月描述为其长期投入机器学习、AI 研究和基础设施建设的重要阶段。公司表示,这些工作旨在把 AI 的好处带到医疗、危机响应和教育等领域。谷歌特别强调,4 月之所以重要,是因为 Cloud Next ’26 聚焦于帮助企业使用智能体 AI。会上,谷歌推出了 Gemini Enterprise Agent Platform 和第八代 TPUs,并把它们定位为智能体时代的核心基础设施。

公司还提到与 Wiz 的安全合作,帮助组织应对新的 AI 相关威胁。在模型方面,谷歌发布了 Gemma 4,并称其为“按字节计算最强大的开源模型”,同时表示自第一代发布以来,Gemma 的下载量已经超过 5 亿次。谷歌还推出了 Deep Research Max,用于高级数据分析,并把它描述为减少深度研究中大量人工整理工作的工具。对于创作者和学习者,汇总中还提到了 Google Vids 的免费视频生成能力,以及 Colab 中新增的 Learn Mode,它旨在充当个人编程导师。

谷歌表示,Cloud Next ’26 吸引了超过 32,000 名参会者,并发布了 260 多项公告;近 75% 的云客户已经在使用 Google Cloud AI,过去一年有 330 家机构每家处理了超过一万亿个 token。汇总还提到,Gemma 的下载量已超过 5 亿次,并且拥有 Google 账号的用户现在可以在 Google Vids 中每月免费生成最多 10 个视频。

Simon Willison

Simon Willison 发布了一篇研究笔记,介绍一个面向 TRE 正则表达式引擎的实验性 Python 绑定。这个绑定使用 ctypes,并由 Claude Code 协助构建;在测试恶意正则模式时,TRE 的表现比 Python 标准库更稳健,主要原因是它不支持回溯。

ReDoS 攻击会利用正则表达式的灾难性回溯让服务变慢甚至失去响应,因此行为更可预测的引擎对安全敏感代码很重要。这个演示说明 TRE 可能适合某些 Python 场景作为更安全的选择,尽管它目前仍只是实验性质的细分绑定,而不是可直接替代生产方案的成熟发布。

Simon Willison 发布了一篇题为《TRE Python binding — ReDoS robustness demo》的研究文章。他表示,既然 antirez 都觉得 TRE 足够好并把它加入 Redis,那么进一步了解它就很有必要。为此,他让 Claude Code 用 ctypes 构建了一个面向 TRE 正则表达式引擎的实验性 Python 绑定。随后,他用恶意正则表达式攻击对这个库进行了测试。

结果显示,TRE 处理这些攻击的能力明显优于 Python 标准库中的正则实现。文章指出,这种鲁棒性主要来自 TRE 不支持回溯。整体来看,这更像是一个小型研究演示,而不是重大产品发布,也不是在宣称 TRE 已经可以全面取代 Python 的正则引擎。

关键技术差异在于 TRE 是一种不进行回溯的正则引擎,因此比 Python 默认实现更能抵御恶意输入。这个绑定仍然是实验性的,并且是通过 ctypes 创建的,所以应把它看作研究演示,而不是受支持的正式库。

The Decoder

包括摩根大通、摩根士丹利和三井住友银行在内的多家大型银行,据称正在接近内部风险集中度上限,因为它们正在为数十亿美元级别的 AI 数据中心项目提供融资。现在,这些银行正试图通过出售贷款或进行重大风险转移,把部分敞口转给其他投资者。

这说明 AI 基础设施热潮已经不只是技术问题,也正在变成金融体系的资产负债表和信用风险问题。如果银行无法顺利分散这些贷款风险,新数据中心的融资成本和融资可得性都可能收紧,从而影响云计算扩张和 AI 基建推进。

建设 AI 数据中心正在成为对银行的一次压力测试,因为所需资本已经大到让单个放贷机构接近其内部敞口上限。根据《金融时报》的说法,包括摩根大通、摩根士丹利、SMBC 和 MUFG 在内的机构,正在努力降低自己在 AI 基础设施贷款中承担的违约风险。问题的核心不是融资需求不足,而是交易规模太大、集中度太高。一个典型例子是为甲骨文相关的德州和威斯康星州数据中心提供融资的 380 亿美元贷款包,这笔交易大到银行据称已经花了数月时间试图把其中一部分分销给市场上的其他投资者。一些放贷方甚至试图向非银行买家折价出售部分贷款。银行还在使用所谓的重大风险转移结构,也就是贷款名义上仍留在银行账上,但一部分违约风险转移给信贷基金、保险公司或其他投资者。

文章援引的市场人士表示,这些数字大到让银行几乎“喘不过气”,而且一些投资者认为这类交易比普通风险转移更危险,因为参与者很少,而且建设项目很容易超支或失败。与此同时,风险并不只是金融层面的。缅因州也出现了围绕大型数据中心的政治阻力,其中包括一项针对 20 兆瓦及以上设施的暂停法案,但该法案随后被州长 Janet Mills 否决。Mills 认为,这项法案会阻止位于 Jay 的一个 5.5 亿美元项目,而她预计该项目将创造 800 多个建筑岗位和至少 100 个永久岗位。否决后,她签署了一项行政令,成立一个咨询委员会,负责研究大型数据中心的影响,并在 2027 年 1 月前提交建议。

一个典型例子是支持甲骨文相关德州和威斯康星州数据中心的 380 亿美元贷款包,银行已花费数月尝试将其更广泛地分销出去。文章还指出,这类交易可能比常见的风险转移结构更危险,因为它们集中度很高、参与者很少,而且施工超支或项目失败都可能让放贷方继续承受损失。

The Verge AI

Roomba的创始人、iRobot前掌门人Colin Angle推出了新公司Familiar Machines & Magic,以及它的首款产品——一款名为“Familiar”的狗大小四足陪伴机器人。该机器人计划使用端侧生成式AI模型与用户建立情感连接,最早要到明年才会上市。

这标志着机器人应用从家务清洁转向面向消费者的社交陪伴,说明业界正在尝试把AI商业化为可交互的实体产品。若能成功,它可能影响陪伴、养老和家庭支持等场景,在这些领域里,情感互动的重要性甚至不亚于机械功能。

Colin Angle 是 Roomba 和 iRobot 背后的关键人物,他这次回归机器人领域,但产品方向与扫地机器人完全不同:不是清洁,而是陪伴。由他创办的新公司 Familiar Machines & Magic 推出的首款产品叫做 Familiar,是一款四足机器人,体型接近狗,外形像熊、谷仓猫头鹰和金毛寻回犬的混合体。它有一张表情丰富的脸,眉毛、耳朵和眼睛都可以活动。根据 The Verge 在 WSJ Future of Everything 大会前看到的演示视频,这台机器人可以像宠物一样在家中用四条腿自主移动。Angle 将其描述为一种“具身AI系统”,会使用端侧生成式AI与主人互动,并努力建立情感连接。

公司希望它能服务于“高人类连接”场景,包括陪伴、娱乐、酒店接待、智能家居、老年照护和育儿支持。内部代号 Ami 的这款产品最早也要到明年才会发售,价格大致会“和养宠物差不多”。Angle 还强调,他们不是在做玩具,也不是把聊天机器人塞进塑料壳里,而是想做一个真正能建立长期关系的机器人。团队一开始就排除了类人机器人方案,也决定不让机器人说话,而是通过非语言声音和刻意模糊的外形来避免用户先入为主地给它设定功能预期。

Angle表示,这是一种“具身AI系统”,目标是发展出独特性格,因此公司刻意避开类人设计,也不打算让它开口说话。首款原型的具体功能仍未公开,但公司称其初期重点面向有年幼孩子的家庭、老年陪伴,以及缓解孤独感等场景。

ZDNET AI

·#iot

ZDNET 评测了 Ugreen 的 Finder Pro 蓝牙追踪器,认为它是苹果 AirTag 的一个明显更耐用的替代品,尤其是在包括被汽车碾压在内的耐久性测试之后。它还可以通过 Google 的 Find My Device 网络与 Android 手机配合使用,因此对苹果生态之外的用户更实用。

像 AirTag 这样的追踪器只有在能承受日常磨损时才真正有用,而这篇评测表明 Ugreen 解决了第三方追踪器最主要的短板之一。尤其对 Android 用户来说,它提供了一个更耐用的追踪方案,而不必加入苹果生态。

ZDNET 这篇评测的核心结论是,Ugreen Finder Pro 最大的优势在于耐用性。作者指出,许多第三方追踪标签在钥匙圈这种高磨损场景下容易开裂、损坏,甚至直接散开,而苹果 AirTag 虽然更结实,但对 Android 用户并不友好。相比之下,Finder Pro 被形容为作者测试过“最耐打”的追踪标签。它采用方形聚合物外壳,而不是常见的圆形设计,并在一角预留了钥匙扣孔。产品内置 90 mAh 可充电电池,底部通过 USB-C 充电,并配有一个小橡胶盖用于防尘防潮。

Ugreen 宣称其续航可达一年,因此用户无需频繁充电。评测还提到,Finder Pro 的蜂鸣声比 AirTag 更大,测试中约为 90 dB,而苹果产品大约是 80 dB。兼容性方面,它既支持苹果的 Find My 网络,也支持谷歌的 Find My Device 网络,但设置时只能二选一,不能同时连接。作者还测试了其蓝牙范围,结果与官方标称的 30 到 65 英尺基本一致,适合常见的近距离寻找场景。随后文章进入耐久性测试部分,包括把追踪器装在旧钥匙上并反复施加粗暴使用场景,整体暗示它的抗造能力明显优于常见同类产品。

Finder Pro 采用 1.25 x 1.25 x 0.6 英寸的方形聚合物机身,内置可充电的 90 mAh 电池,通过 USB-C 充电,预计续航约一年。它在设置时只能选择接入苹果的 Find My 网络或谷歌的 Find My Device 网络之一,不能同时连接两者,而且扬声器标称约 80 到 100 dB,实测接近 90 dB。

ZDNET AI

ChatGPT为个人用户推出了可选的“高级账户安全”功能。它增加了通行密钥或安全密钥登录、更强的账户恢复方式、更短的登录会话,并默认关闭AI训练。

这次更新能帮助ChatGPT用户更好地防范账户被盗和数据泄露,尤其适合处理敏感对话或文件的人。它也反映出消费级AI产品正在向通行密钥和更注重隐私的默认设置转变。

ZDNET报道称,ChatGPT为个人用户新增了一项名为“高级账户安全”的可选功能。该功能旨在保护账户访问和聊天中共享的数据,因为这些内容可能包含敏感的个人或职业信息。OpenAI将其定位为面向更重视安全的用户,例如记者、政治异见人士、民选官员和研究人员,但任何ChatGPT用户都可以选择启用。这个功能包含四项保护:使用通行密钥或实体安全密钥登录、更强的账户恢复方式、更短的活跃会话时间,以及自动关闭AI训练。

启用时,用户会被引导到一个注册页面,并且必须先登录账户。开启后,用户原来的密码将不再被接受用于登录,而且需要设置至少两种认证方式。账户恢复方面,ChatGPT会禁用邮箱和短信恢复,改为依赖备用通行密钥、安全密钥或恢复密钥,系统会提示用户保存这些密钥。ZDNET还提到,OpenAI推荐使用安全密钥,并与Yubico合作提供两把YubiKey的折扣套装,但同时也支持其他密钥和通行密钥。

用户需要先在注册页面登录并完成启用流程,之后原来的密码将不再用于登录。账户恢复也会被加强:邮箱和短信恢复将被禁用,改为使用备用通行密钥、安全密钥或恢复密钥,同时登录会话时长也会缩短,以降低风险。

ZDNET AI

ZDNET 报道称,Booking.com 通过一次 agentic AI 上线,将客户满意度提升了 73%,并把这次实践总结成适合其他企业参考的五步方法。该公司的首个 agentic 应用是一个“酒店合作方到住客”的沟通系统,用来加快酒店相关问题的回复速度。

这个案例说明,当 agentic AI 与明确的业务痛点绑定时,就有机会从试验阶段走向可衡量的商业价值。对于旅游、酒店和其他高度依赖客户服务的行业来说,它尤其有参考意义,因为这些行业都希望在不完全依赖人工流程的情况下实现更快响应。

ZDNET 表示,关于 agentic AI 的讨论很多,但真正把 agents 投入生产环境的公司仍然不多。文章认为,企业不能长期停留在试点阶段,而是需要找到能够创造实际价值的具体用例。Booking.com 被用作一个实践案例,展示了如何把这类技术落地。公司数据与机器学习平台总监 Huy Dao 表示,团队通过“connected trip”思路来释放 AI 价值,也就是把旅行中的不同环节连接成一个整体体验。在这个框架下,Booking.com 打造了首个 agentic 应用:一个酒店合作方到住客的沟通系统,帮助酒店合作伙伴更快、更准确地回应客户问题。

文章指出,原来的问题在于,酒店员工往往需要先收集信息,而且并不总能在客户提问时及时在线,所以回复可能要等几个小时。Dao 说,团队首先识别业务挑战,然后搭建数据平台和集成技术栈来支持 AI 落地。这个技术栈包括 Snowflake、ThoughtSpot、Astronomer、Airflow、Immuta、Arize 和 AWS,同时还测试了 OpenAI、Amazon Bedrock 和 Google Gemini 的模型。Booking.com 的内部系统使用 Python 开发,并借助开源框架 LangGraph 来支持 agentic 工作流。

Booking.com 团队围绕“connected trip”理念展开工作,把航班、酒店和景点视为一个整体的客户体验。公司还围绕 Snowflake、ThoughtSpot、Astronomer、Airflow、Immuta、Arize 和 AWS 搭建了支撑性数据栈,并测试了来自 OpenAI、Amazon Bedrock 和 Google Gemini 的模型。

ZDNET AI

ZDNET 认为,企业应当谨慎采用 agentic AI,把重点放在可衡量的业务成果上,而不是被炒作驱动的承诺所左右。文章强调了不可靠提示词、失控智能体、厂商“agent washing”以及不断上升的成本等失败风险。

agentic AI 正被包装成重要的生产力和转型工具,但文章提醒,如果不把项目绑定到真实价值和风险控制上,很多项目可能会失败。这对正在决定是试点、规模化还是等待市场成熟的企业管理者来说很重要。

ZDNET 将 agentic AI 的讨论描述为一种战略抉择:是追求稳健、渐进的收益,还是押注高风险、高回报的转型。文章用一个假设性的董事会场景,对比了两种方案:一种是把管理开支降低 10% 的保守方案,另一种是理论上能带来 10 倍增长的激进方案。文章认为,围绕 agentic AI 的巨大承诺需要谨慎看待,尽管分析机构和厂商都在给出非常乐观的经济预测。文中引用 KPMG 对其每年可释放 3 万亿美元生产力增益的估计,以及 Accenture 认为 agentic AI 是一种“新的资本形态”、代表经济史上的转折;同时 Gartner 则称企业只有很短的窗口期来定义自己的产品战略。文章也强调,许多早期项目仍只是实验或概念验证,因此不应默认它们一定会成功。

它警告说,如果没有防护措施,不可靠的提示词和自主智能体可能会连锁引发失败。另一个主要风险是“agent washing”,即厂商把现有软件如助手、RPA、基于脚本的服务和聊天机器人重新包装成 agentic 产品。文章还指出成本可能失控,因为许多 AI 系统依赖 OpenAI、Google、Anthropic 等提供的大模型 API,按 token 计费。总体而言,文章的核心建议是:企业应把重点放在可衡量的成果、现实的预期和严格的风险管理上,而不是追逐炒作。

文章引用了 Gartner 的估计:到 2027 年底,超过 40% 的 agentic AI 项目将因成本上升、业务价值不清晰或风险控制不足而被取消。文章还提到,Gartner 认为数千家所谓的 agentic AI 厂商中,真正提供智能体产品的不到 13%,许多只是把助手、RPA、脚本或聊天机器人重新包装成“agentic”。

ZDNET AI

ZDNET 报道称,企业中的 AI 代理数量正在快速增长,文中援引 Statista 的数据指出,全球目前有 2860 万个活跃代理,预计到 2030 年将超过 22 亿个。为应对这一趋势,一类新的代理管理平台正在出现,用于管理、协调和治理这些代理。

随着企业在销售、软件开发和其他工作流中部署越来越多的代理,风险重点正从“构建代理”转向“如何安全地规模化管理代理”。这类平台有望成为 AI 治理、可观测性和访问控制的核心层,类似于此前 MLOps 和平台工程在企业自动化浪潮中的作用。

ZDNET 认为,AI 代理的快速增长正在制造一个新的企业问题:代理泛滥。随着目前已有数百万个代理上线,未来几年还会继续大幅增加,企业开始寻找能够管理这些系统的工具,而不是把每个代理都当作独立项目来处理。文章把代理管理平台描述为一种新兴技术类别,目的是协调 AI 代理网络。Shelly Palmer 将未受管理的代理比作影子 IT,并警告说,一旦发生故障,企业可能没有审计记录、版本控制或治理机制可追溯。CrowdStrike 的 Diptamay Sanyal 认为,企业应把代理视为基础设施而不是功能,因为否则就会出现大量缺乏共享上下文、可复用模式和一致监督的代理。

他指出,一个合适的平台应提供可组合原语、多租户隔离、跨 LLM 提供商的模型路由,以及对代理行为的可观测性。文章还强调,许多代理都需要访问同一批数据,这会带来治理问题,GitLab 的 CIO Manu Narayan 将其称为 AI 治理挑战。其他专家提醒说,如果内部团队或供应商各自独立部署代理,就会产生重复建设、行为不一致、隐性成本和安全暴露。Info-Tech Research Group 的 Brian Jackson 进一步指出,面向消费者的自动化工具可能让企业更难追踪已部署的代理,尤其是在发现能力受身份管理层限制时。

文章指出,未纳入管理框架的代理很像影子 IT:它们可能短期内能运行,但一旦出问题,就可能没有审计记录、版本控制或治理机制可供追溯。文中还提到,当前市场上的相关产品包括 Google Vertex AI Agent Builder、Amazon Bedrock Agents、Microsoft 365 Copilot、Decagon AI 和 Sierra AI,它们的能力从编排到多代理自动化不等,但仍可能受身份管理层限制。

ZDNET AI

ZDNET 认为,围绕代理式编码的最大恐惧和最大承诺都被夸大了。文章转而聚焦于当开发者让 AI 代理编写代码时,现实中会出现的维护和可持续性问题。

随着 AI 编码工具能力提升,最难的问题正从“写代码”转向“长期维护代码”。这篇文章的重要性在于,它把代理式 AI 视为治理和软件工程问题,而不只是生产力提升或末日威胁。

ZDNET 这篇文章直接质疑了围绕 vibe coding 和 agentic AI 的两种极端叙事。第一种说法认为,只要一句提示词,AI 就能神奇地生成一个高价值应用;第二种说法则认为,AI 写出的代码因为不可见、不可控,最终一定会走向灾难。作者认为这两种观点都过于夸张,真正的问题其实是维护性和可持续性。文章结合作者此前对多个 vibe-coded 项目的经验指出,这类系统虽然很惊艳,但后续往往需要大量持续工作。作者用一家融合餐厅的类比来说明,agentic coding 常常会交付你没有直接选择、也一时难以完全理解的代码。

更具体地说,文章把 AI 编码比作管理承包商或下属:输出质量高度依赖你给出的指令、监督和标准。作者强调,如果提示不够清晰,或者对话过程缺乏持续的约束,拿回来的代码就会很难处理。文章给出的实用建议是建立质量标准、把任务拆小、每一步都验证结果,再继续下一步。与其预言“末日”,作者更想说明的是:真正的挑战是学会有效地监督 AI,让生成的软件保持可理解、可维护。

作者将代理式编码比作雇佣承包商:你可能得到有用的产出,但只有经过测试和审查后才知道结果。一个核心建议是一次只让 AI 处理一个小任务,而不是丢给它一大份需求文档,因为模型可能会误解其中某个细节并偏离方向。