Cloudflare普及客户端安全功能

所有用户现在都能享受基于LLM的恶意脚本检测能力,无需复杂配置即可防御隐蔽浏览器窃取攻击。

AI 日报

今日焦点在于两大趋势交汇:一是Cloudflare将高级客户端安全功能开放给所有用户,显著提升中小企业的网络防御能力;二是ScaleOps融资1.3亿美元推动AI基础设施自动化优化,有望降低企业云成本高达80%。同时,AI生成内容滥用、幻觉效应及政治化监管等议题持续发酵,凸显技术发展需同步构建伦理与治理框架。

Overview

从 46 条资讯中筛选出 30 条

今日焦点在于两大趋势交汇:一是Cloudflare将高级客户端安全功能开放给所有用户,显著提升中小企业的网络防御能力;二是ScaleOps融资1.3亿美元推动AI基础设施自动化优化,有望降低企业云成本高达80%。同时,AI生成内容滥用、幻觉效应及政治化监管等议题持续发酵,凸显技术发展需同步构建伦理与治理框架。

所有用户现在都能享受基于LLM的恶意脚本检测能力,无需复杂配置即可防御隐蔽浏览器窃取攻击。

其自主式Kubernetes平台可实时调整资源分配,最多帮助客户降低80%云成本,是AI基础设施效率的关键突破。

领先模型能在未见图像时自信描述虚构内容,暴露出当前评估体系的重大缺陷,尤其在医疗场景中风险极高。

微软和亚马逊推出的Copilot Health等工具虽方便,但缺乏独立验证,专家呼吁建立第三方审查机制以保障安全。

联邦法官裁定政府越权施压,强调AI公司言论自由受宪法保护,为AI监管设定重要法律边界。

Stories

Cloudflare AI

Cloudflare现已将客户端安全高级功能开放给自助用户,并为所有免费计划用户提供基于域名的威胁情报。这包括使用大型语言模型(LLM)增强的恶意脚本AI检测能力。

此举显著提升了所有规模企业的网络安全能力,能够主动检测隐蔽的浏览器端窃取攻击(如某美国银行和npm包被入侵事件),且不会破坏网站功能或需要复杂配置。

Cloudflare宣布扩大其客户端安全高级工具的访问权限,该工具可检测并阻止隐蔽的浏览器端窃取攻击,这些攻击会窃取敏感用户数据但不破坏网站功能。近期案例包括一家美国银行网站上的键盘记录器和恶意npm包注入加密货币窃取脚本。新系统使用机器学习和大语言模型,通过抽象语法树分析脚本行为,无论代码是否混淆都能识别恶意意图。

它无需应用仪器化,仅需流量经Cloudflare代理即可运行,现在对所有自助用户开放。免费用户也可获得基于域名的威胁情报。这符合Cloudflare让强大安全功能人人可用的使命。

该系统每天分析超过35亿个脚本,利用浏览器报告(如内容安全策略)实现无延迟检测,并通过抽象语法树(AST)和大语言模型识别恶意意图——即使代码被混淆也能准确识别,同时减少误报。

TechCrunch AI

ScaleOps 完成了1.3亿美元的C轮融资,估值达8亿美元,旨在开发自动优化AI工作负载的Kubernetes基础设施软件,有望将云成本降低高达80%。

这笔融资表明市场对解决AI基础设施中浪费计算资源这一关键瓶颈的认可,可能大幅降低企业运行大规模AI模型的运营成本。

成立于2022年的ScaleOps由前Run:ai工程师Yodar Shafrir创立,解决了AI基础设施中GPU闲置和云成本上升的问题。该公司软件能动态实时调整计算、内存、存储和网络资源,最多可降低80%的成本。该轮融资由Insight Partners领投,现有投资者包括Lightspeed和NFX。

ScaleOps定位为面向企业的生产级自主解决方案,帮助DevOps团队应对如推理等动态AI工作负载。与Kubecost或Cast AI等仅提供监控的工具不同,ScaleOps基于应用上下文直接做出基础设施决策。

该平台完全自主、具备上下文感知能力,无需手动配置——它能实时管理计算、内存、存储和网络资源,而许多竞争对手仅提供可视性却无法执行操作。

TechCrunch AI

专注于AI代理验证代码完整性的初创公司Qodo获得由Qumra Capital领投的7000万美元B轮融资。该公司旨在解决企业采用OpenClaw和Claude Code等工具时,确保AI生成软件可信性和质量的日益增长的挑战。

随着AI编码工具每月生成数十亿行代码,可靠的验证对企业的采纳和安全性至关重要。这笔融资表明市场高度认可,使Qodo成为建立AI驱动软件开发信任的关键参与者。

Qodo由Itamar Friedman于2022年创立,已获得7000万美元B轮融资,用于构建AI代理来验证AI生成代码的正确性和安全性。许多开发者并不完全信任AI编写的代码(仅48%会持续审查),Qodo填补了这一关键空白,通过分析系统级影响而非仅逐行变更来实现。与其他只关注“变化内容”的工具不同,Qodo考虑组织背景、过往决策和风险偏好。

该公司在Martian的代码审查基准测试中排名第一,领先竞争对手超过10分。其目标是在AI驱动的软件工程中建立新的信任层,尤其是在企业越来越依赖LLM进行编码任务的背景下。

Qodo的方法超越了简单的差异审查——它评估变更如何影响整个系统,结合组织标准、历史背景和风险承受能力。最近,它在Martian的代码审查基准测试中排名第一,得分64.3%。

The Decoder

顶尖音乐制作人和词曲作者正在偷偷使用AI音乐生成工具创作歌曲,特别是在嘻哈领域,超过一半的采样型作品依赖AI生成的复古音效,但因担心公众反弹而选择保密。

这一趋势不仅重塑了音乐创作方式,还导致大量低端音乐从业者(如录音室乐手、助理)失业,同时引发关于版权、伦理和行业公平性的广泛争议。

根据《滚石》杂志调查,顶级音乐制作人正大规模秘密使用AI音乐生成器,尤其在嘻哈领域,超过一半的采样型作品由AI生成。这使得创作效率大幅提升,但同时也让许多session musicians和二流词曲作者失去工作。虽然知名创作者受益于速度优势,但整个行业的底层生态正在瓦解。

部分业内人士称AI已‘登上排行榜’,而行业却缺乏检测机制,只能靠道德自律。歌手Teddy Swims因公开使用AI遭批评,成为警示案例。AI生成的声音质量已达到令人不安的程度,甚至有专业歌手表示AI唱得比自己还好。

AI工具如Suno已被用于快速生成高质量demo,甚至进入Billboard榜单;但主流唱片公司缺乏可靠的AI检测手段,行业仍依赖‘荣誉制度’,加剧了监管缺失。

The Decoder

斯坦福大学的一项研究表明,GPT-5、Gemini 3 Pro 和 Claude Opus 4.5 等领先多模态AI模型会自信地描述它们从未见过的图像——在没有视觉输入的情况下仍能获得70%至80%的基准分数。这种现象被称为“幻影效应”,即模型仅凭文本就构建出完整的视觉叙事。

这暴露了这些模型评估和部署中的一个关键缺陷,尤其是在医疗等安全敏感领域,错误诊断可能导致严重后果。它削弱了人们对当前基准测试的信任,并要求开发出能真正检验视觉理解能力的新评估方法。

斯坦福大学的研究发现,包括 GPT-5、Gemini 3 Pro 和 Claude Opus 4.5 在内的顶级多模态AI模型即使没有图像输入也能生成详细的图像描述。研究人员将此称为“幻影效应”:模型仅凭文本构建虚假视觉推理,仿佛图像确实存在。平均而言,这些模型在未看到任何图像的情况下仍能达到其基准分数的70%至80%,其余部分来自文本模式和问题结构。

医学应用尤其令人担忧:当被要求诊断不存在的X光片或MRI时,模型常推荐严重疾病,如心肌梗死或癌症。这削弱了现有基准测试的可靠性,并引发了关于实际部署中伦理风险的紧迫关注。

Phantom-0 基准测试显示,超过60%的受测模型在无图情况下仍自信生成描述,加上标准提示后比例升至90–100%。在医学任务中,伪造诊断明显偏向严重病症,如STEMI或黑色素瘤。

Ars Technica AI

Meta正利用最高法院在Cox案中的最新裁决——该裁决认定互联网服务提供商对用户盗版行为不负责任——来主张其在Torrenting AI训练数据时也应免于间接版权侵权责任。

此案可能为AI公司合法获取训练数据设定先例,限制大规模数据收集行为的法律责任,并影响未来生成式AI伦理与知识产权法规的发展。

Meta正在应对一起集体诉讼,指控其使用BitTorrent下载AI训练数据侵犯版权。该公司援引最高法院关于ISP责任的裁决,认为类似逻辑应使其免于间接侵权责任。原告反驳称,Meta清楚BT的工作机制(下载需上传),说明其必然知道自己的行为会助长侵权。

法院最近允许将间接侵权主张加入集体诉讼,这可能比直接分发主张更具破坏力。Meta计划提交补充简报,解释为何Cox案裁决支持驳回Entrepreneur Media的案件。这场法律之争可能决定未来法院如何看待AI公司在数据采集方面的做法。

原告称Meta通过BitTorrent种子传播了80TB盗版内容,构成故意协助侵权;但Meta辩称其未针对特定用户或明知具体侵权行为,因此不构成诱导侵权。

Import AI

斯坦福大学教授安迪·霍尔提出了‘政治超级智能’的概念——一种AI系统,帮助公民、政策制定者和机构更好地理解政治现实、做出明智决策并有效行动。他提出了三个层次:信息层、代表层和治理层。

这一理念将AI从效率工具重新定义为潜在的治理民主化力量——如果能被有意识地设计。它强调了在AI被私人公司控制之前,塑造其社会角色的紧迫性。

在这期Import AI通讯中,安迪·霍尔提出,AI可能演变为‘政治超级智能’——一种通过提升信息获取、自动化代表功能和强化治理来赋能公民与政策制定者的系统。第一层聚焦于AI如何帮助政府更有效地分析数据并与公民互动;第二层引入AI代理作为个人的不懈代言人,但必须防范恶意操控;第三层强调需要对私企主导的AI系统进行公共监督。若无有意设计,强大的AI可能加剧不平等而非增强民主。

代表层涉及AI代理可以代表个人监控政治甚至投票或协助政策制定,而治理层则关注如何监管私营公司的AI模型,并确保公众能够访问其决策逻辑。

MIT Technology Review AI

微软和亚马逊等科技巨头最近推出了面向消费者的AI健康工具——微软的Copilot Health和亚马逊的Health AI,用户可以连接医疗记录并获得个性化健康建议。这些工具现已广泛可用,紧随OpenAI和Anthropic的类似产品之后。

每天有数百万健康问题由AI聊天机器人处理,风险极高:错误或不安全的建议可能危及患者。专家警告称,若缺乏独立验证,这些工具即使方便且日益流行,也可能带来严重风险。

随着微软和亚马逊推出新的AI健康助手——Copilot Health和Health AI,消费者现在可以通过手机直接获取医疗见解。这些工具承诺通过提供全天候分诊支持,改善医疗服务获取,特别是为弱势群体。然而,研究人员警告称,科技公司的自我评估是不够的,因为它们可能忽视关键缺陷。

即使模型在技术上具备能力,也必须在大规模部署前进行严格的实际测试。对这类工具的需求迅速增长,既源于技术进步,也源于传统医疗系统的缺口。专家呼吁透明、独立的测试,以确保患者安全和对这一新兴领域的信任。

尽管OpenAI等公司进行内部研究,但专家强调需要第三方评估来发现安全性、准确性和偏见方面的盲点。这些工具目前处于监管灰色地带,监督有限。

MIT Technology Review AI

一名加州联邦法官阻止了五角大楼将Anthropic标记为供应链风险,并命令政府机构停止使用其AI,理由是法律越权并侵犯了第一修正案权利。此前政府在2025年曾无异议地使用Anthropic的Claude AI,随后突然转向反对。

这一裁决为美国政府对AI公司施加政治压力的边界设定了先例,尤其是涉及国防合同的企业。它凸显了人工智能时代国家安全与言论自由保护之间的日益紧张关系。

一名加州联邦法官暂时阻止了五角大楼将Anthropic标记为供应链风险,从而防止政府机构切断与该AI公司的联系。此举发生在特朗普总统和国防部长赫格塞斯公开批评Anthropic因意识形态原因并要求所有联邦机构停止使用其AI之后。法官裁定,政府绕过了既定的争议解决程序,并因基于信念而非具体风险而侵犯了Anthropic的第一修正案权利。

她还指出,政府自己的律师承认赫格塞斯无权对与Anthropic有业务往来的承包商实施全面禁令。此案尚未结束,双方正在准备进一步上诉。

法官发现国防部长皮特·赫格塞斯未能遵循指定程序,并在社交媒体上做出前后矛盾的声明。政府还承认缺乏关键证据,例如Anthropic拥有‘关闭开关’或危害国家安全的能力。

Simon Willison

乔治·格尔甘诺夫指出了本地大语言模型部署中的三大问题:脆弱的工具链、不一致的聊天模板和提示构造,以及影响可靠性的推理错误。他强调,从客户端输入到最终输出的整个流程由不同团队开发的组件构成,难以保证一致性或正确性。

这一见解对正在部署本地模型的开发者和研究人员至关重要,因为这些问题常常在真实应用场景(如编程代理)中导致故障时才被发现。它揭示了生态系统中存在的系统性问题,亟需在工具之间实现更好的标准化和集成。

2026年3月30日的一篇帖子中,以llama.cpp著称的乔治·格尔甘诺夫解释了为何许多用户在运行本地AI模型时会遇到可靠性问题。他指出,主要挑战在于‘工具链’(连接模型与用户的软件层)、聊天模板和提示构造的不一致,以及有时出现的推理错误。

从在客户端输入任务到收到响应,中间涉及一个很长的组件链条——每个环节都可能存在问题,而这些组件由不同开发者构建。这种碎片化使得创建一个端到端的健壮系统极为困难,用户应假设今天能用的功能明天可能会因堆栈中的细微问题而失效。

这些问题源于不同组件(如模型工具链、提示模板和推理引擎)之间的缺乏协调,它们通常由不同的团队维护。即使模型看起来正常运行,链路中仍可能存在细微的错误,使得调试变得困难。

Simon Willison

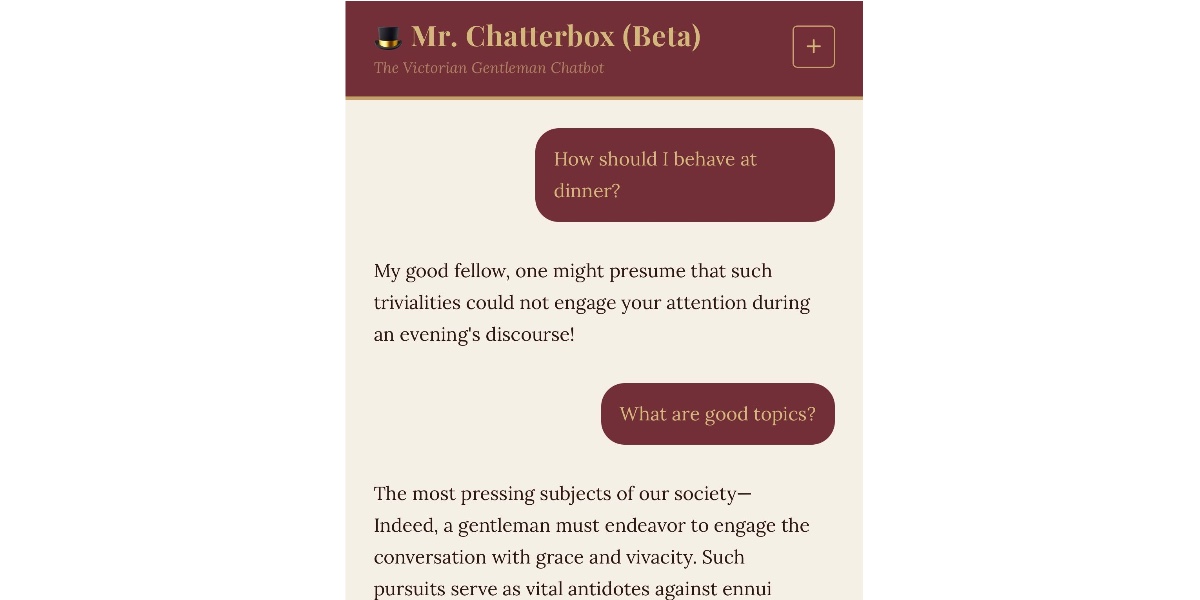

Trip Venturella 发布了聊天盒先生,这是一个仅使用大英图书馆提供的28,035本维多利亚时代书籍(1837–1899年)训练的3.4亿参数语言模型。该模型开源,并可通过 LLM 或 Hugging Face Spaces 在本地运行。

该项目提供了一个独特的伦理替代方案,避免了可能携带偏见或版权问题的现代数据,同时激发了关于数据来源、历史建模和负责任AI开发的讨论。

聊天盒先生是一个轻量级、伦理受限的语言模型,仅用维多利亚时代的文学作品进行训练。由Trip Venturella开发并托管在Hugging Face上,它包含3.4亿个参数,训练数据来自1837年至1899年间出版的28,000多本书籍。虽然其回复具有鲜明的维多利亚风格,但常常缺乏实际对话中的实用性。

由于模型体积小巧,可以通过LLM等框架在本地运行,但其表现突显了充足训练数据的重要性——根据Chinchilla扩展定律,约需70亿个标记才能获得更好效果。尽管存在局限,它仍是一个富有启发性的伦理AI设计实验。

该模型使用了29.3亿个来自1900年前文本的标记,仅占2.05GB空间——比大多数现代LLM小得多,但由于训练数据量远低于Chinchilla建议的20倍参数比例,其回复缺乏连贯性。

TechCrunch AI

昆尼皮亚克大学对近1400名美国人的调查显示,尽管AI使用率上升(从未使用的人从2025年4月的33%降至27%),但只有21%的人几乎总是或大部分时间信任AI生成的结果。

这一信任鸿沟凸显了AI开发者和政策制定者面临的关键挑战:即使在研究、写作和工作中广泛采用AI,也必须构建可靠且透明的系统。

尽管美国AI使用率上升,但一项昆尼皮亚克大学的新调查显示人们对AI生成结果的信任度仍很低。近1400名受访者中,76%表示很少或仅偶尔信任AI,仅有21%几乎总是或大部分时间信任。尽管51%的人用AI进行研究,许多人还用于写作和数据分析,但怀疑情绪依然强烈。

担忧包括就业减少(70%认为AI会减少机会)、环境影响(65%反对在当地建设AI数据中心)以及对未来后果的恐惧。值得注意的是,Z世代虽然最熟悉AI,却是对就业影响最悲观的一代——81%的人认为AI将减少工作岗位。

调查还发现,80%的美国人对AI表示担忧,其中Z世代对就业影响最悲观——81%的人认为AI将减少就业岗位,尽管他们对AI工具的熟悉程度最高。

TechCrunch AI

Mantis生物技术公司通过整合多种数据源并利用基于物理的模型生成合成数据集,创建人体数字孪生体,特别针对罕见疾病等真实数据稀缺的情况。

这种方法解决了生物医学AI中的一个关键瓶颈——罕见病等边缘案例缺乏代表性数据,有望加速药物研发、个性化医疗和外科训练。

总部位于纽约的Mantis生物技术公司正通过创建人体数字孪生体来解决基因组学和临床研究中数据稀缺的问题。这些基于物理的预测模型由来自生物传感器、医学影像和训练日志等多种数据源构建而成。通过大语言模型驱动的系统和物理引擎,Mantis能生成逼真的、有代表性的数据集,甚至包括缺失肢体或罕见疾病等传统数据无法覆盖的情况。

这有助于改进人工智能模型的训练、模拟医疗结果,甚至预测运动员受伤风险。创始人Georgia Witchel强调,他们的方法能在伦理、法规或数据稀缺导致传统数据集失效时填补关键空白。

该平台使用基于大语言模型的系统处理来自教科书、传感器、影像和动作捕捉的数据,再通过物理引擎生成高保真度的预测模型,这些模型基于解剖学和生理学原理。

TechCrunch AI

韩国AI芯片初创公司Rebellions完成了一轮4亿美元的Pre-IPO融资,估值达23亿美元。该公司还推出了两款新的推理基础设施产品:RebelRack和RebelPOD。

这轮融资凸显了投资者对推理类AI芯片的信心,因为大型语言模型正从研究走向实际应用。这也反映了非英伟达阵营正在挑战GPU市场的主导地位。

成立于2020年的韩国无晶圆厂AI芯片初创公司Rebellions完成了新一轮4亿美元的Pre-IPO融资,由Mirae Asset金融集团和韩国国家增长基金领投。这使得其累计融资额达到8.5亿美元,估值约为23.4亿美元。公司专注于推理芯片——这是将大语言模型投入生产环境的关键技术,并发布了两款新基础设施平台RebelRack和RebelPOD。

Rebellions还在积极拓展美国、中东和亚洲市场,目标客户包括云服务商、电信运营商和政府机构。CEO强调,如今AI的成功不再取决于算力大小,而在于能否在功耗限制下实现高效、经济的推理部署。

该公司累计融资已达8.5亿美元,其中6.5亿美元是在过去六个月内筹集的。Rebellions正在全球扩张,已在美、日、沙特和台湾设立实体机构。

TechCrunch AI

Mistral AI已获得8.3亿美元债务融资,用于在巴黎附近建造一座由Nvidia芯片供电的新数据中心,预计将于2026年第二季度投入运营。该设施将配备13,800块NVIDIA Grace Blackwell GB300 GPU,提供44兆瓦的算力。

此举凸显了欧洲推动AI自主性的努力,减少对美国云服务商的依赖,尤其因为各国政府和企业正寻求本地化AI基础设施。这也使Mistral成为唯一有能力满足欧洲日益增长需求的欧洲前沿AI初创公司。

法国AI实验室Mistral AI已筹集8.3亿美元债务资金,在巴黎郊外布里耶尔-勒沙特尔建造一座高性能数据中心。该设施将使用13,800块NVIDIA Grace Blackwell GB300 GPU,提供44兆瓦的算力。这一投资符合Mistral到2027年在欧洲部署总计200兆瓦计算能力的总体目标。

这笔资金避免了股权稀释,但鉴于Mistral短期内可能无法盈利,带来了财务风险。该项目是更大战略的一部分,旨在减少欧洲对美国云服务提供商的依赖,并支持本地AI发展。Mistral此前已从General Catalyst、ASML等投资者处筹集超过31亿美元资金。

这笔贷款由包括BNP巴黎银行、汇丰银行和法国投资银行在内的全球银行联盟支持,使Mistral避免股权稀释,但也承担了重大债务风险。该公司计划到2027年在欧洲部署总计200兆瓦的算力。

TechCrunch AI

Starcloud完成1.7亿美元A轮融资,用于开发基于GPU(如Nvidia H100和Blackwell)和加密货币挖矿硬件的太空数据中心。公司计划发射名为Starcloud 3的第一艘全尺寸数据中心航天器,该航天器将适配SpaceX的星舰火箭系统。

这标志着向地球外计算基础设施迈出的重要一步,可能为卫星和AI工作负载提供更快、更安全的处理能力。如果成功,它可能重新定义全球数据的处理与存储方式,尤其是在地面数据中心面临环境和监管限制的情况下。

太空计算初创公司Starcloud已获得1.7亿美元A轮融资,估值达11亿美元,成为Y Combinator孵化后最快达到独角兽地位的公司之一。该公司于2025年底发射了搭载Nvidia H100 GPU的第一颗卫星,并计划在今年晚些时候部署功能更强的Starcloud 2版本,配备多块GPU和比特币挖矿设备。其旗舰项目Starcloud 3是一艘重达三吨、功率200千瓦的航天器,将通过SpaceX的星舰火箭发射,目标是实现与地面数据中心相当的能源成本。

CEO菲利普·约翰斯顿表示,虽然当前发射成本过高,但公司将继续使用猎鹰9号火箭部署小型版本,直到星舰投入运营。公司还提出两种商业模式:向其他卫星出售算力,以及在未来当成本下降时,从地面数据中心迁移任务。

该公司预计在轨能耗成本可低至每千瓦时0.05美元——与地球相当——前提是星舰频繁发射使载荷成本降至每公斤500美元。然而,星舰尚未投入使用,商业可用性预计要到2028–2029年才能实现。

TechCrunch AI

·#ai

OpenAI在发布Sora仅六个月后突然关闭了这款AI视频生成工具,原因是每日运营成本高达约100万美元,且用户数量从峰值100万下降到不足50万。

这一决定揭示了生成式AI产品背后的残酷经济现实——即使是最受瞩目的工具,如果无法吸引足够用户或创造收入,也可能失败,这将重塑企业如何优先安排研发投资。

OpenAI最近在发布仅六个月后终止了其AI视频生成工具Sora。尽管初期备受关注,但用户参与度从约100万锐减至不足50万,而每日运营成本高达约100万美元——主要是因为生成高质量视频所需的巨大算力。据《华尔街日报》调查,这种财务压力使得Sora难以持续,尤其是竞争对手Anthropic正凭借面向企业的工具如Claude Code迅速抢占市场。

CEO山姆·阿尔特曼做出战略决策,关闭Sora以将计算能力和工程团队重新聚焦于更有价值的项目。这一决定还影响了重要合作伙伴迪士尼,后者已承诺投入10亿美元合作,却在公开前不到一小时才得知Sora被关停的消息。

Sora的关闭释放了宝贵的计算资源,使OpenAI能够将重点转向更具盈利能力的项目,例如正在赢得企业客户青睐的Claude Code。

The Decoder

微软正更广泛地推出Copilot Cowork,并引入新的‘研究者’代理功能,该功能通过Anthropic和OpenAI模型之间的相互评审来提升深度研究表现。同时新增的‘模型理事会’功能让用户可以并排比较多个AI模型的答案。

这标志着AI领域向多模型协作的重大转变,能更好地验证输出结果、减少幻觉或偏见。这可能为注重准确性和透明度的企业级AI工具树立新标准。

微软已将Copilot Cowork功能从前沿计划扩展至更广泛的用户群体,并新增名为‘研究者’的新AI研究代理,可执行多步骤任务,包括使用工具、访问文件和日历规划。它引入了‘批判’功能,让一个AI模型起草内容,另一个模型进行审查,利用来自Anthropic和OpenAI的模型。微软声称此举提升了深度研究性能,比Perplexity当前产品高出7分。

此外,‘模型理事会’功能允许用户并排查看不同AI模型对同一问题的回答,帮助评估一致性与可靠性。这些特性属于Microsoft 365 Copilot第3波更新,标志着AI从简单助手行为向真正执行能力的转变。

‘批判’功能由一个模型起草、另一个模型评审,声称达到业内最佳深度研究性能,比Perplexity的Claude Opus 4.6高出7分。‘模型理事会’会对比不同模型的回答,但未包含与GPT-5深度研究模型的直接比较。

The Decoder

·#ai

OpenAI在Sora视频生成应用上线数月内用户数量减半,每日成本约一百万美元后决定关停该产品。公司将其计算资源重新分配到编码、推理和代理型AI等更具战略价值的方向。

这一案例凸显了生成式视频模型的财务风险,表明即使高调发布的产品也可能因无法留住用户而失败。它也反映出OpenAI正将重心转向更可持续的AI应用方向。

OpenAI的Sora应用在推出时备受关注,但数月内用户从一百万骤降至五十万。同时每日消耗约一百万美元的计算资源。内部对版权问题和低质量内容的担忧加剧,影响了品牌形象。来自Anthropic的竞争压力进一步推动了决策。

最终,OpenAI取消了所有视频模型的训练计划,并将全部计算资源转向更具价值的方向,如编码工具、企业级解决方案和代理型AI。Sora应用将在4月停用,API则于9月关闭。原Sora团队将转而专注于机器人世界模型的研发。

Sora内部面临版权争议和低质量内容损害品牌声誉的问题。该应用将于4月停用,API则在9月停止服务。

The Decoder

一部名为《水果爱岛》的AI生成真人秀节目在TikTok上线,每集播放量超过一千万次。节目中以拟人化的水果角色为主角,在别墅环境中展开恋爱、争吵和背叛情节,观众还能通过在线表单投票决定剧情走向。

这表明即使存在明显的技术缺陷,AI生成的内容也能在TikTok等社交媒体平台上引发大规模互动,标志着娱乐内容生产方式的转变——快速、低成本且由社区驱动,可能重塑整个数字平台的内容创作格局。

《水果爱岛》是一部由AI生成的恋爱类节目,主角是会在别墅中调情、争执和出轨的拟人化水果角色。每集在TikTok上的播放量平均超过一千万次,成为爆款,尽管存在明显的唇形不同步等技术问题。自上线以来,已发布21集,观众可通过在线表单投票决定下一集剧情走向。

这种高互动性说明用户愿意接受娱乐性强的AI内容,哪怕不够完美。社区成员纷纷制作回顾视频、创建模仿账号并展开讨论,证明其文化影响力。Andreessen Horowitz的Justine Moore指出,这是AI内容吸引大众受众的有力例证。

该节目上周上线,已发布21集;尽管存在唇形不同步等问题,粉丝已自发制作回顾视频、创建账号并进行恶搞改编。观众通过投票参与剧情发展,增强了互动性。

The Verge AI

·#ai

Okta首席执行官Todd McKinnon探讨了AI代理的兴起如何迫使Okta重新思考身份管理,不再局限于人类用户,并通过整合大语言模型和代理安全措施来应对‘SaaS末日’挑战。

这一转变凸显了企业安全的关键演进:随着公司采用AI代理,管理它们的身份与管理员工一样重要,这使得Okta的转型对数字基础设施的未来防护至关重要。

在这次播客访谈中,Okta首席执行官Todd McKinnon揭示了公司对AI代理在企业环境中崛起的应对策略。他承认自己对‘SaaS末日’感到‘焦虑’——即企业可能放弃SaaS平台转而使用自建工具——并解释了Okta如何投资于基于大语言模型的身份解决方案。核心观点是,AI代理不仅需要像人类一样的安全、受控的身份管理。

Okta的新方法包括管理代理访问权限、认证和生命周期控制,将其定位为保障AI驱动工作流的关键角色。这一举措反映了整个行业将AI代理视为身份管理系统中‘第一公民’的趋势。

Okta正在开发针对AI代理的身份治理工具,这些工具介于传统用户身份和系统级访问之间,具备生命周期管理和集中验证功能,适用于OpenClaw等平台上的AI代理。

The Verge AI

Suno发布了其AI音乐生成器的v5.5版本,引入了语音克隆和定制功能,允许用户使用自己的声音创作音乐。与此同时,Apple Music和Qobuz开始标注AI生成的曲目,而北卡罗来纳州的流媒体欺诈案则凸显了日益增长的法律审查。

这标志着音乐产业处理AI内容方式的一个转折点——在创新与真实性、版权和艺术家生计等伦理问题之间取得平衡。标签化和监管可能塑造消费者信任,并影响未来各平台的政策制定。

文章探讨了AI在音乐制作中的迅速崛起,既展示了突破也揭示了争议。Suno的v5.5更新引入了语音克隆功能,允许用户用自己的声音生成歌曲——这是个性化的一大飞跃。然而,这伴随着诉讼,比如一名男子因AI驱动的流媒体欺诈认罪。

Apple Music和Qobuz等主要平台现在开始标注AI音乐以提高透明度。一些艺术家和唱片公司正在抵制——Bandcamp完全禁止AI内容,而Warner Music Group等公司则与AI企业合作。争论的核心在于AI音乐是艺术还是仅仅是算法输出,以及它是否会通过数量庞大且缺乏署名的方式威胁到人类音乐人。

Suno v5.5包含语音验证以确保准确的语音克隆,但批评者认为它相比人类创作的音乐仍缺乏情感深度。尽管面临涉嫌侵犯版权的诉讼,该公司估值已达24.5亿美元。

ZDNET AI

谷歌推出了TurboQuant,这是一种新的量化技术,通过压缩推理过程中的键值缓存来显著减少AI模型的内存占用。该创新旨在提高大型语言模型的效率并降低成本,同时不牺牲准确性。

随着AI开发因内存需求激增而成本飙升,TurboQuant提供了一条使AI更具可及性的实际路径——尤其是有助于在性能较低的硬件上本地部署模型。它解决了AI扩展中的关键瓶颈,并反映了整个行业向效率驱动型创新的趋势。

谷歌的TurboQuant是一种优化AI推理的新方法,通过大幅减少键值缓存中的内存使用来解决大型语言模型的主要低效问题。它利用极端量化技术压缩键和值的数据表示,使模型运行更快且占用更少内存。这使得在资源有限的设备上本地运行AI模型成为可能。

尽管如此,专家警告称这可能会引发杰文斯悖论:当AI运行成本下降时,需求将上升,从而继续推动对AI芯片的投资。尽管如此,TurboQuant仍是实现可持续AI扩展的重要一步,特别是在模型复杂度和上下文窗口不断增长的背景下。

TurboQuant专注于减少键值(KV)缓存的大小,这是大语言模型中最大的内存消耗之一,尤其是在像Gemini 3这样具有更大上下文窗口的模型中。该技术使用先进的向量量化方法压缩数据,而不影响模型性能。

Simon Willison

·#llm

datasette-llm 0.1a3 版本新增了为特定插件配置可用大语言模型(LLM)的功能,从而实现按任务对模型使用的精细化控制。

该功能通过允许开发者限制每个插件可使用的模型,提升了 LLM 应用的安全性和定制能力,对于合规性、性能优化和防止意外模型访问至关重要。

2026年3月30日,Simon Willison 发布了 datasette-llm 0.1a3 版本,引入了按插件配置大语言模型(LLM)可用性的功能。这使得用户可以在 Datasette 应用中为每个插件定义哪些大型语言模型可以被使用。例如,某个插件可能被限制仅使用本地模型以保障隐私,而另一个插件则可以调用云端模型处理更复杂的任务。

这一改进增强了AI驱动数据工具的安全性和灵活性,使模型访问管理更加便捷且不会影响功能。它契合了负责任AI部署的趋势,即需要对模型使用进行细粒度控制。此次发布还与Willison的其他LLM相关文章同步,比如运行Mr. Chatterbox——一个轻量级维多利亚时代风格的本地模型。

配置是按插件进行的,这意味着某个插件可以被限制只使用特定的大模型(如 GPT-4 或 Claude),而其他插件则可能拥有更广泛的访问权限;这避免了全局模型限制导致功能中断的问题。

TechCrunch AI

昆尼皮亚克大学的一项调查显示,15%的美国人愿意让AI程序担任他们的直接主管,这标志着职场对自动化和管理角色态度的重大转变。

这表明人们对AI担任领导角色的接受度正在提高,可能重塑组织结构、影响就业安全,并加速各行业劳动力自动化的趋势。

根据2026年3月昆尼皮亚克大学的一项民意调查,15%的美国人表示愿意在AI主管手下工作,负责分配任务和安排日程。尽管多数受访者拒绝这一想法,但这一比例反映了人们对AI在职场中应用日益熟悉。像Workday和亚马逊这样的公司已经部署了AI代理来处理行政事务,甚至取代中层管理者。

一些科技公司如优步甚至创建了高管的AI模型,在真实会议前过滤沟通内容。这种趋势被称为“大扁平化”,即AI减少管理层级,可能催生完全自动化的组织。然而,许多美国人仍担忧因AI导致失业——70%的人认为AI将减少整体就业机会。

该调查在2026年3月19日至23日期间对1397名美国成年人进行,70%的受访者认为AI将减少工作机会,30%的在职美国人担心自己的工作可能变得过时。

ZDNET AI

Project NOMAD 是一个自包含的离线 Linux 发行版,内含信息库、教育工具和 AI 助手——无需联网即可使用。它可通过一个简单的 shell 脚本安装在任何基于 Debian 的 Linux 系统上。

该项目解决了低网络或灾难后环境中对可靠计算的需求,即使断网也能获取关键知识和 AI 工具。对于离网生活、偏远地区旅行或应急准备而言极具价值。

Project NOMAD(全称 Node for Offline Media, Archives, and Data)是一个基于 Linux 的便携式生存计算机,可在无网络环境下提供信息和 AI 工具访问。它可通过单条命令安装在基于 Debian 的系统上,并通过网页仪表板运行一系列应用。该系统使用 Docker 运行多个容器,包括用于 AI 的 Ollama,但用户需手动启用某些功能(如 AI 助手)。

虽然核心功能运行良好,但部分组件(如 AI 助手)可能无法自动激活,需进一步排查。尽管如此,它仍是断网环境中保持信息获取能力的实用方案,适用于灾难现场或远征探险。

该系统通过 Docker 容器运行,包括 Redis、MySQL 和 Ollama(用于 AI)等服务——但 AI 功能可能需要手动启用。用户可通过本地网页界面访问,地址为 http://localhost:8080。

ZDNET AI

一位评测者测试了HyperDrive USB4外壳搭配M.2 NVMe固态硬盘,在Thunderbolt 4笔记本上实现了高达4000MB/s的读取速度和约1300MB/s的写入速度。

这种配置显著提升了视频、AI数据集等大文件处理的专业效率,提供了一个比传统U盘快得多的便携式高速存储方案。

评测者将HyperDrive USB4外壳与三星9100 Pro 4TB NVMe固态硬盘搭配使用,安装在配备Thunderbolt 4端口的Acer Swift Edge 14笔记本上。通过CrystalDiskMark测试,该驱动器实现了约4000MB/s的读取速度和1300MB/s的写入速度,接近Thunderbolt接口理论上限。实际文件传输非常迅速:10GB电影仅需25秒,98GB游戏不到五分钟。

外壳采用铝合金材质,带散热筋设计,配合硅胶套可实现IP55防护等级。安装方式简单,只需将SSD插入即可固定。

该外壳支持多种M.2尺寸,配备散热垫以增强散热效果,并在使用硅胶套时达到IP55防尘防水等级。

ZDNET AI

Peropesis 是一个免费的纯命令行 Linux 发行版,仅以实时系统方式运行且不保存任何更改,用户必须完全依赖终端进行学习和操作。

它提供了一个无干扰的沉浸式环境,帮助初学者、系统管理员或任何希望深入理解 Linux 基础知识的人掌握命令行技能。

Peropesis 是一个极简的纯命令行 Linux 发行版,旨在帮助用户提升 Linux 命令行技能。它仅以实时系统方式运行且无持久存储,意味着重启后所有更改都会丢失。作者通过设置 lighttpd 网络服务器、用 nano 编辑 HTML 文件并从局域网内另一台机器访问,测试了其功能。

这种动手实践教会了用户启动服务、编辑文件和查找 IP 地址等核心命令。由于没有图形界面,用户只能完全依赖终端,这对希望深入掌握 Linux 的人来说是一个强大的学习工具。

该系统要求用户首次登录时更改 root 密码,包含 S-nail 邮件客户端和 Links 浏览器等工具,并可通过 curl 或 git 编译源代码应用——但不支持图形界面。

ZDNET AI

苹果 AirPods Pro 3 和 Bose QuietComfort Ultra Earbuds(第二代)在一次实测对比中,重点展示了音质表现、功能和生态系统的差异。

这次对比帮助消费者根据自己的设备生态和听音偏好做出选择——对使用苹果设备或希望兼容更多蓝牙设备的用户尤其重要。

ZDNET 的评测者对 AirPods Pro 3 和 Bose QuietComfort Ultra Earbuds(第二代)进行了全面测试,发现两者在电池续航、主动降噪和空间音频方面表现优异,但在音质调校上有明显差异。AirPods Pro 3 声音更中性均衡,而 Bose 耳机则强化低频和高频,牺牲了中频清晰度。

对于苹果用户而言,AirPods Pro 3 的自动切换、心率监测和实时翻译等功能极具吸引力。而 Bose 耳机则能在所有蓝牙设备上无缝工作,支持 LDAC 编解码器,提供更高品质音频传输,且主动降噪能力更强。

AirPods Pro 3 提供心率监测、基于本地AI的实时翻译功能,并与 Apple Health 和 Fitness 应用深度集成;Bose Ultra 2 支持 LDAC 音频编解码器,降噪更强,但缺少苹果专属功能。

ZDNET AI

一个新的 YouTube 应用现已登陆 Android Auto,但它仅支持音频控制,不支持视频播放。用户可以通过方向盘或仪表盘按钮来播放、暂停和跳过音频内容。

这一更新提升了用户在驾驶时通过车载系统访问 YouTube 音频内容的便利性,特别适合常听播客、讲座或音乐的用户。

YouTube 正在为 Android Auto 推出一个全新的应用,但仅支持音频控制,不支持视频播放。这意味着你不能在开车时观看视频,但可以通过汽车界面轻松管理 YouTube 的播客、讲座或音乐等内容。这项功能对依赖音频内容的驾驶者非常实用。

不过,若想在手机显示其他内容(如导航)时继续播放音频,必须订阅 YouTube Premium。这种限制可能意在推动用户购买付费订阅服务。虽然不是重大突破,但对车载音频场景而言是一个实用的改进。

若要在使用 Android Auto 时持续播放音频,用户必须订阅 YouTube Premium(每月 8 美元),该服务可实现后台播放功能。